No contexto atual marcado por uma adoção rápida e generalizada da inteligência artificial nas empresas francesas, os benefícios são inegáveis: melhoria da produtividade, transformação digital acelerada e automação de inúmeras tarefas. Contudo, esse desenvolvimento vem acompanhado de riscos significativos, às vezes desconhecidos ou minimizados, que podem fragilizar a segurança, a confidencialidade e até mesmo a sustentabilidade das organizações. A Direção-Geral de Segurança Interna (DGSI) publicou recentemente um Flash interferência destacando essas fragilidades através de três casos reais vividos por empresas francesas, reveladores dos perigos que espreitam quando não se domina plenamente as ferramentas de inteligência artificial empregadas.

Estes exemplos expõem diversas facetas dos desafios tecnológicos e organizacionais: por um lado, a manipulação de dados sensíveis através de ferramentas externas não controladas, por outro, a confiança excessiva concedida a sistemas de decisão autónomos, e, por fim, o aumento de ataques sofisticados que utilizam tecnologias deepfake. Este artigo mergulha nestas três ilustrações concretas para aprofundar os principais desafios enfrentados pelas empresas francesas na sua exploração e uso da inteligência artificial, tratando dos riscos éticos, dos vieses algorítmicos, das questões de proteção de dados e dos imperativos de segurança informática. Também será avaliado como uma regulamentação adequada da IA, aliada a uma governança rigorosa, pode prevenir erros onerosos e preservar a integridade das estruturas económicas nacionais.

- 1 Uso inadequado da IA generativa: um exemplo alarmante para as empresas francesas

- 2 Perigos da dependência da IA para a tomada de decisão estratégica nas empresas francesas

- 3 Fraudes sofisticadas por deepfake, uma ameaça crescente para as empresas francesas

- 4 Recomendações chave para enquadrar o uso da inteligência artificial nas empresas francesas

- 5 Estatísticas e impactos económicos da inteligência artificial nas empresas francesas

- 6 Riscos éticos e vieses algorítmicos: desafios para as empresas francesas face à inteligência artificial

- 7 Transformação digital e desafios de proteção de dados nas empresas francesas

- 8 Abordagem estratégica para uma integração bem-sucedida da IA nas empresas francesas

Uso inadequado da IA generativa: um exemplo alarmante para as empresas francesas

O primeiro caso destacado pela DGSI concerne uma empresa estratégica que utiliza uma ferramenta pública de inteligência artificial generativa, desenvolvida no estrangeiro, para a tradução de documentos internos sensíveis. O uso dessa ferramenta havia sido adotado de forma espontânea por alguns colaboradores, seduzidos pela eficiência e rapidez que ela oferecia na gestão diária dos conteúdos. Essa prática, iniciada sem validação hierárquica ou controlo prévio, revelou rapidamente os seus limites quando a direção informática detectou uma possível fuga através de uma auditoria interna.

O recurso a serviços gratuitos ou internacionais apresenta um perigo particular, pois os dados inseridos podem ser usados para treinar os modelos de inteligência artificial em segundo plano, muitas vezes sem que o utilizador seja explicitamente informado. Este fenómeno representa uma ameaça importante à confidencialidade das informações, especialmente quando os servidores dessas empresas estão localizados fora do território francês ou mesmo europeu, expondo estes dados a legislações estrangeiras cujo regulamento é por vezes menos rigoroso.

Perante esta constatação, a empresa cessou o uso deste serviço em favor de uma solução interna e paga, oferecendo um ambiente seguro conforme às normas nacionais. Além disso, foi criado um grupo de trabalho específico para elaborar uma doutrina de uso rigorosa das ferramentas de IA. Esta abordagem ilustra a necessidade crucial das empresas estruturarem a utilização de tecnologias avançadas para evitar falhas de segurança. De facto, as ameaças relacionadas com a interconexão com interfaces externas ou plugins não controlados aumentam o vetor de ataque e a vulnerabilidade a infiltrações.

Olhando para o conjunto deste primeiro exemplo, fica claro que a tentação de recorrer a ferramentas simples e gratuitas pode ocultar riscos consideráveis. Para todas as empresas francesas que se empenham na transformação digital, é imperativo adotar uma política de segurança informática proativa e integrar a proteção dos dados nos critérios de avaliação das ferramentas de IA desde as fases iniciais.

Perigos da dependência da IA para a tomada de decisão estratégica nas empresas francesas

O segundo caso destacado pelos serviços de inteligência evoca um cenário no qual uma empresa francesa em plena expansão internacional terceirizou uma parte crítica do seu processo decisório, a due diligence, a um sistema de inteligência artificial concebido no estrangeiro. Esta abordagem tinha como objetivo ganhar rapidez e eficiência na avaliação de parceiros comerciais potenciais em mercados desconhecidos.

A curto prazo, este automatismo revelou-se atraente, pois gerava relatórios detalhados e instantâneos. No entanto, devido ao volume de trabalho e à falta de recursos humanos especializados para verificar os resultados, as equipas tendem a aceitar cegamente os resultados fornecidos sem recorrer a uma validação especialista adicional. Porém, estes sistemas algorítmicos fornecem respostas probabilísticas, que correspondem à resposta estatisticamente mais provável, em vez de uma resposta isenta de vieses ou perfeitamente adequada ao contexto.

Os vieses algorítmicos, introduzidos desde a conceção do modelo ou através dos dados de treino, podem direcionar incorretamente os resultados. Além disso, as famosas “alucinações” – que geram informações erradas, imprecisas ou inventadas – colocam em risco a fiabilidade destas ferramentas. Este fenómeno aumenta os riscos de tomadas de decisões estratégicas baseadas em análises enviesadas, podendo conduzir a perdas comerciais, conflitos contratuais ou ruptura de confiança.

O exemplo mostra assim a necessidade crucial de integrar um controlo humano especialista nos ciclos decisórios, por exemplo nomeando responsáveis IA encarregados de reformular, verificar e ponderar as recomendações geradas por estas máquinas. A vigilância humana continua a ser uma salvaguarda indispensável contra a redução da diversidade de pensamento e decisões automatizadas desconectadas do contexto real das empresas francesas.

Este caso ilustra também outro grande desafio tecnológico: como conjugar a otimização trazida pela automação e transformação digital com a manutenção de um controlo estratégico rigoroso? Os programas de formação e a sensibilização para os riscos inerentes ao uso da inteligência artificial tornam-se essenciais para preservar a agilidade e resiliência das empresas num mercado internacional competitivo.

Fraudes sofisticadas por deepfake, uma ameaça crescente para as empresas francesas

O terceiro caso mencionado pela DGSI revela uma tentativa de fraude particularmente sofisticada envolvendo o uso de tecnologias deepfake. Um responsável de um sítio industrial recebeu uma chamada de vídeo de um interlocutor que imitava perfeitamente a aparência e a voz do dirigente do grupo, solicitando uma transferência financeira no âmbito de um projeto de aquisição. Esta fraude só foi detetada graças à vigilância e instinto do responsável, que rapidamente interrompeu a comunicação e alertou a direção.

As tecnologias de manipulação de áudio e vídeo tornaram-se de facto redutivelmente convincentes. Entre 2023 e 2025, o volume de conteúdos deepfake na internet multiplicou-se por mais de dez, e vários milhões destes vídeos, imagens ou gravações circulam diariamente. Este desenvolvimento teve uma aceleração espetacular também devido à popularização das ferramentas de IA generativa e das técnicas de síntese de voz.

Estes ataques baseiam-se frequentemente na recolha e análise minuciosa de dados públicos e privados de uma empresa para personalizar as mensagens fraudulentas, reforçando assim a sua credibilidade e potencial de manipulação. Quase metade das empresas afirmam ter sido alvo deste tipo de tentativas, revelando a dimensão do problema no panorama francês. O setor industrial, pela sua elevada importância económica, está particularmente exposto.

Torna-se assim primordial para as empresas francesas implementar dispositivos de segurança informática adequados: formação dos colaboradores para reconhecer deepfakes, implementação de protocolos rigorosos de verificação nas solicitações financeiras e recurso a soluções tecnológicas capazes de detetar conteúdos falsificados. Estas medidas devem acompanhar obrigatoriamente a transformação digital para evitar que essas inovações se tornem alavancas de fraude e desinformação.

Recomendações chave para enquadrar o uso da inteligência artificial nas empresas francesas

Os retornos da DGSI insistem na necessidade de um enquadramento rigoroso para evitar os perigos identificados, ao mesmo tempo que favorece a adoção da inteligência artificial e seus numerosos benefícios. Um primeiro imperativo é a definição clara de uma política interna dedicada, que regule os usos e os tipos de dados que podem ser tratados via ferramentas de IA.

As empresas francesas são encorajadas a privilegiar soluções locais ou europeias para limitar os riscos relacionados à soberania dos dados e à proteção jurídica. Por outro lado, a formação contínua dos empregados aparece como outro pilar fundamental, permitindo-lhes compreender os desafios, identificar os riscos e adotar comportamentos conformes às regras.

A DGSI recomenda também a implementação de dispositivos de transparência interna, nomeadamente através de um canal de denúncia para qualquer incidente suspeito, e a instauração de uma revisão regular das práticas associadas à inteligência artificial. A integração de validações humanas especializadas deve ser sistemática, sobretudo para decisões estratégicas ou sensíveis.

Finalmente, a colaboração entre os atores públicos e privados, incluindo as autoridades reguladoras da IA, é essencial para definir um quadro claro e evolutivo, susceptível de acompanhar as mutações tecnológicas sem comprometer os valores éticos e a segurança das empresas francesas.

- Definir uma política interna clara sobre o uso da IA

- Preferir soluções locais ou europeias

- Formar regularmente os colaboradores

- Implementar um canal de denúncia de incidentes

- Garantir uma validação humana sistemática para decisões críticas

- Assegurar a transparência e revisão regular das práticas

- Colaborar com as autoridades para um quadro regulatório adequado

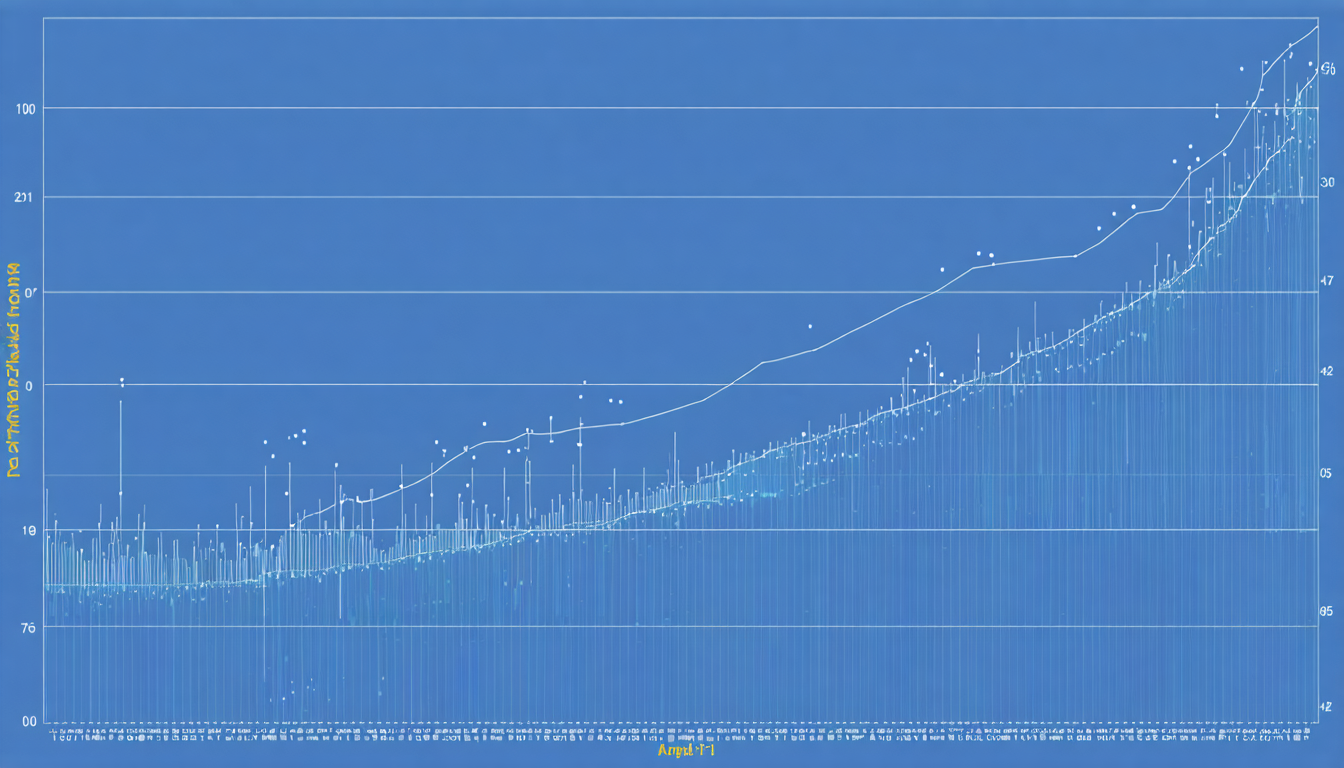

Estatísticas e impactos económicos da inteligência artificial nas empresas francesas

Os números revelam um panorama contrastante entre benefícios económicos e vulnerabilidades potenciais. Quase 78% das empresas mundiais já integram a inteligência artificial em pelo menos uma das suas funções. Em França, esta tendência está em constante progressão, graças em particular à transformação digital impulsionada em numerosos setores.

Segundo vários estudos, os ganhos de produtividade vinculados à IA podem atingir picos de até 55%. A rentabilidade financeira média é estimada em cerca de 3,70 dólares gerados por dólar investido. Estas perspetivas económicas seduzem os dirigentes, mas por vezes ocultam os riscos intrínsecos, nomeadamente em termos de segurança informática e respeito pela privacidade.

Esta tabela sintetiza alguns indicadores chave:

| Indicador | Valor | Comentários |

|---|---|---|

| Taxa de adoção da IA nas empresas (França) | 70% | Em forte aumento desde 2023 |

| Ganhos de produtividade relacionados à IA | Até 55% | Variabilidade segundo o setor e uso |

| Retorno financeiro médio | 3,70 $ por dólar investido | Vantagem significativa sobre investimentos tradicionais |

| Empresas sem política formal de IA | 1/3 | Falta de governança expondo a riscos |

| Empresas visadas por deepfakes | 46% | Propagação rápida desta ameaça |

Riscos éticos e vieses algorítmicos: desafios para as empresas francesas face à inteligência artificial

Para além das questões de segurança e proteção de dados, as empresas francesas enfrentam um desafio fundamental relacionado com os vieses algorítmicos. Estes vieses surgem quando os dados usados para treinar os modelos são parcialmente representativos ou quando preconceitos implícitos se inserem nos programas. Isso pode gerar discriminações, falsear os resultados de análise ou comprometer a tomada de decisão automatizada.

Os riscos éticos ligados a estes vieses são cruciais, especialmente para empresas que atuam em setores sensíveis, como finanças, saúde ou recursos humanos. Por exemplo, uma IA enviesada pode influenciar injustamente as decisões de recrutamento, penalizar certos perfis de clientes ou favorecer escolhas comerciais contestáveis.

Para enfrentar estes desafios, as empresas devem implementar auditorias regulares dos algoritmos, realizar testes de conformidade ética e reforçar a diversidade das equipas de desenvolvimento, para limitar os pontos cegos. A sensibilização dos decisores para estes riscos e a integração de mecanismos corretivos são também essenciais.

Por fim, a regulamentação da IA a nível europeu impõe agora exigências rigorosas em matéria de avaliação dos vieses e de transparência, o que obriga as empresas francesas a cumprir estes padrões sob pena de sanções legais e impacto negativo na sua imagem.

Medidas práticas para reduzir os vieses algorítmicos

- Realizar auditorias independentes nos modelos usados

- Envolver especialistas multidisciplinares no desenvolvimento dos algoritmos

- Utilizar conjuntos de dados representativos e diversificados

- Implementar mecanismos de explicabilidade das decisões algorítmicas

- Formar as equipas sobre os riscos éticos ligados às IAs

Transformação digital e desafios de proteção de dados nas empresas francesas

A transformação digital, acelerada pelo uso intensivo da inteligência artificial, impõe um reforço das políticas de proteção de dados. Neste contexto, as empresas francesas devem respeitar não só as normas europeias do RGPD, mas também antecipar as exigências específicas relativas à confidencialidade e integridade dos dados tratados por sistemas de IA.

A manipulação de dados sensíveis através de interfaces automatizadas pode agravar os riscos de fuga e utilização abusiva. Por conseguinte, uma política de cibersegurança reforçada deve combinar o uso de ferramentas técnicas com uma governança rigorosa, incluindo a definição de papéis claros e a responsabilização dos atores.

A segurança dos dados passa também pelo controlo dos fluxos com o exterior. As empresas francesas são incentivadas a limitar as trocas com plataformas externas não certificadas ou localizadas fora da União Europeia, privilegiando soluções soberanas que garantam um controlo acrescido sobre os dados. Esta abordagem contribui para preservar a confiança dos clientes e parceiros, fator chave na consolidação das relações comerciais a longo prazo.

Abordagem estratégica para uma integração bem-sucedida da IA nas empresas francesas

Finalmente, para maximizar as hipóteses de sucesso da transformação digital e minimizar os riscos, as empresas francesas devem adotar uma abordagem estratégica global e integrada. Esta mobiliza não só as tecnologias de inteligência artificial, mas também a formação das equipas, a revisão dos processos de negócio, bem como a implementação de uma gestão da segurança e conformidade.

Uma governança adaptada da IA inclui a nomeação de responsáveis dedicados, a implementação de cartas de ética e a colaboração estreita com as autoridades regulatórias. Este quadro deve também favorecer a inovação, garantindo um uso responsável e transparente.

A história destas três empresas ilustra que a inovação não prescinde de vigilância. O desenvolvimento de competências internas, a sensibilização para os riscos e a transparência nas práticas autorizadas asseguram um equilíbrio entre a exploração dos potenciais da IA e o domínio dos perigos inerentes.