Na era da inteligência artificial, a percepção visual das máquinas nunca foi tão avançada. A Meta, gigante das tecnologias digitais, acabou de ultrapassar um estágio crucial com seus modelos SAM3 e SAM3D, que redefinem o reconhecimento de imagem e a visão computacional. Esses novos sistemas incorporam técnicas avançadas de deep learning e processamento de imagens, expandindo os limites do possível na análise visual. Muito mais do que uma simples segmentação de objetos, é uma capacidade de compreender, isolar e até reconstruir em três dimensões os elementos de uma cena que abre amplos horizontes.

Em 2025, essas tecnologias se posicionam como ferramentas revolucionárias, capazes de transformar o mundo digital e físico. Seus desempenhos superiores na identificação de objetos a partir de uma simples descrição textual, sua aptidão para manter a continuidade visual em sequências de vídeo complexas e sua capacidade de reconstrução 3D a partir de imagens fazem do SAM3 e SAM3D inovações importantes. Esses modelos treinados em uma base de mais de 11 milhões de imagens ilustram perfeitamente o potencial espetacular da interseção entre inteligência artificial e visão computacional.

Essa virada tecnológica impactará não apenas pesquisadores e desenvolvedores, mas também as indústrias criativas, comerciais e científicas. À medida que o processamento de imagens se torna mais intuitivo, eficiente e preciso, o crescimento dos modelos avançados de IA como SAM3 e SAM3D promete reinventar domínios tão diversos quanto vigilância, comércio online, robótica e conservação da biodiversidade. Descubra um panorama detalhado dessas inovações e suas implicações concretas no reconhecimento de imagem.

- 1 Como o Meta SAM3 revoluciona o reconhecimento de imagem graças à segmentação inteligente

- 2 SAM3D: a tecnologia de visão tridimensional que transforma uma simples foto em objeto 3D

- 3 Principais funcionalidades detalhadas do Meta SAM3 e SAM3D para visão computacional avançada

- 4 Desenvolvimento sustentado por um gigantesco Data Engine e o impacto na precisão

- 5 Aplicações concretas do Meta SAM3 / SAM3D na indústria, ciência e lazer

- 6 Restrições e limitações atuais do Meta SAM3 / SAM3D a considerar

- 7 Comparativo entre Meta SAM3 / SAM3D e outras tecnologias IA de reconhecimento de imagem

- 8 Acessibilidade, custos e modelos de uso do Meta SAM3 / SAM3D no cenário tecnológico atual

Como o Meta SAM3 revoluciona o reconhecimento de imagem graças à segmentação inteligente

O modelo Meta SAM3 se impõe como um verdadeiro avanço no campo do reconhecimento de imagem por inteligência artificial. Diferentemente das gerações anteriores, esse sistema não se limita a analisar pixels isolados: ele segmenta com uma precisão excepcional cada objeto presente em uma imagem ou vídeo. Essa segmentação é obtida a partir de um simples clique ou até mesmo de uma descrição textual fornecida pelo usuário, o que simplifica radicalmente a interação entre humano e máquina.

Uma das forças do SAM3 reside em sua capacidade de funcionar sem treinamento prévio específico. Em outras palavras, o modelo pode isolar instantaneamente um objeto nunca antes encontrado, independentemente de sua forma ou características. Para ilustrar, um fotógrafo amador que queira extrair todas as bicicletas vermelhas de uma cena urbana só precisa escrever a descrição “todas as bicicletas vermelhas”. O SAM3 identificará e traçará os contornos dos objetos correspondentes sem a necessidade de intervenção trabalhosa ou preparação específica dos dados. Essa funcionalidade, chamada Promptable Concept Segmentation (PCS), combina a compreensão da linguagem natural com o poder visual do deep learning, uma combinação possível graças à arquitetura sofisticada desenvolvida pela Meta.

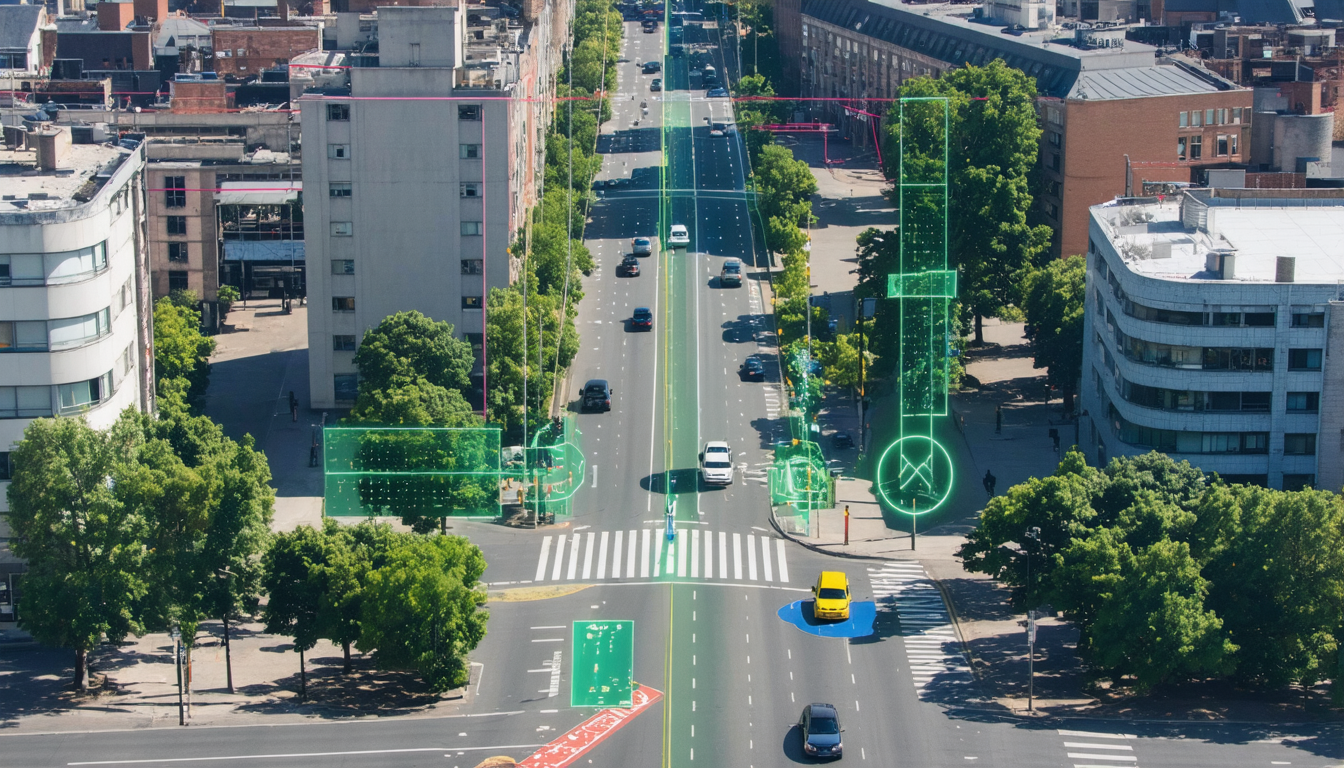

A segmentação inteligente não se limita à imagem estática: os fluxos de vídeo também beneficiam desse processamento avançado de imagens. O SAM3 utiliza “masklets” para seguir precisamente os objetos, mesmo quando estão parcialmente ocultos ou evoluem em cenas dinâmicas. Por exemplo, em um vídeo de vigilância, se uma pessoa se move atrás de um obstáculo, o modelo continua a manter seu rastreamento sem confusão. Essa capacidade garante um rastreamento temporal confiável e abre caminho para aplicações como a videoproteção automática ou ferramentas criativas de edição instantânea de vídeo.

A arquitetura unificada do SAM3 também se destaca por sua espinha dorsal única que trata de forma uniforme imagens e vídeos. Essa organização interna reduz o consumo de recursos e aumenta a velocidade de execução, fornecendo desempenho ótimo mesmo em contextos exigentes. Graças a essa engenharia, o SAM3 transforma o reconhecimento de imagem em uma experiência fluida e acessível, emblemática dos avanços em inteligência artificial que marcam profundamente a visão computacional em 2025.

SAM3D: a tecnologia de visão tridimensional que transforma uma simples foto em objeto 3D

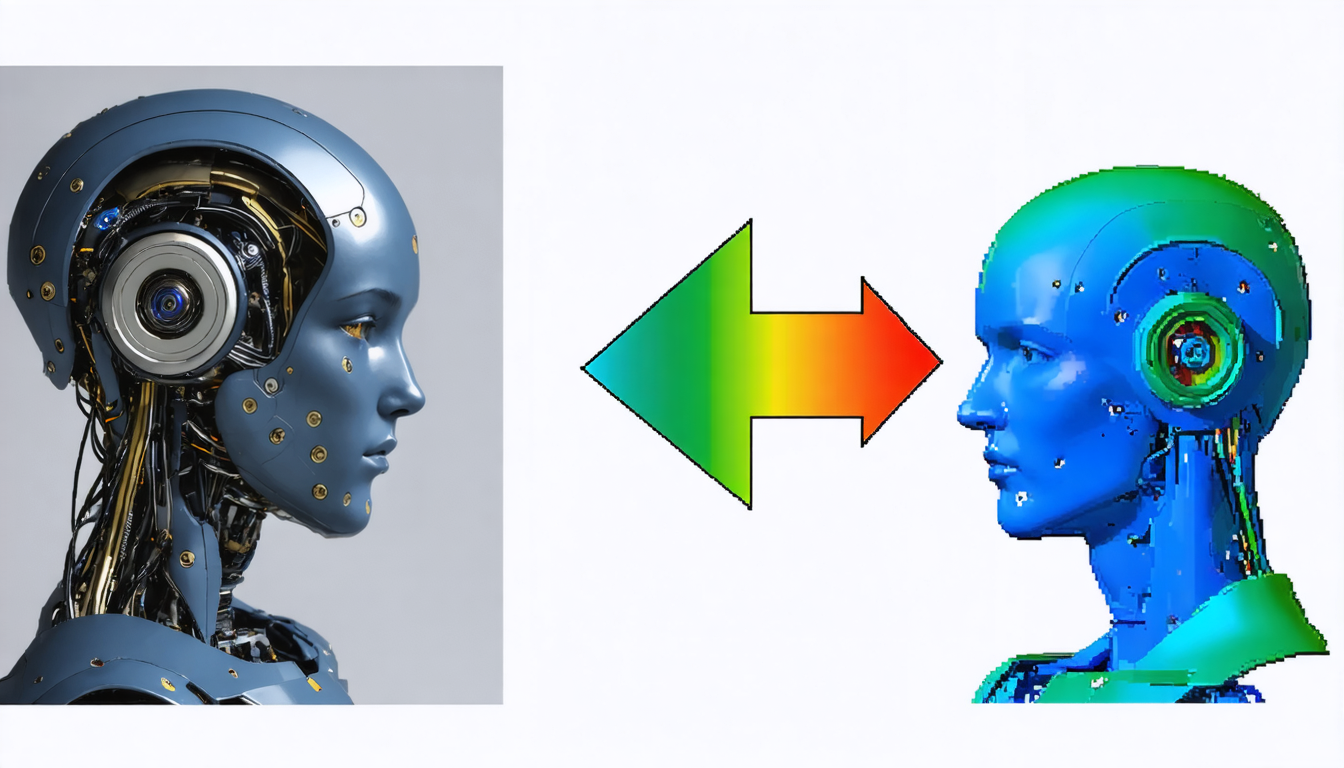

Além da segmentação clássica, a Meta inova com o SAM3D, um modelo que eleva o reconhecimento de imagem ao nível espacial tridimensional. Utilizando dados de referência provenientes da visão computacional multi-câmeras e de scans LiDAR, o SAM3D consegue reconstruir objetos em 3D a partir de imagens comuns, abrindo uma nova era na interpretação visual automática.

Essa tecnologia baseia-se em dois módulos especializados. SAM 3D Objects destina-se a objetos inanimados do cotidiano. A partir de uma simples foto, ele gera uma malha texturizada manipulável em três dimensões, capaz de lidar com ocultações parciais. Assim, se um objeto estiver parcialmente escondido atrás de outro, o SAM3D pode prever a forma ausente graças a um raciocínio lógico e contextual intenso. Por exemplo, em uma imagem onde uma xícara cobre parcialmente um vaso, o recipiente será reconstruído em sua totalidade, um feito que ultrapassa amplamente as capacidades dos modelos tradicionais.

Para os seres vivos, especialmente os humanos, o SAM 3D Body implementa um modelo inédito de representação corporal. Ele distingue entre esqueleto, carne e até mesmo roupas, permitindo uma análise detalhada das poses e dos movimentos complexos. Essa inovação oferece aos avatares digitais uma fluidez e naturalidade nunca vistas, abrindo caminho para aplicações em realidade virtual, animação ou ergonomia.

Assim, o SAM3D constitui um avanço significativo no processamento de imagens pois transforma não apenas a percepção, mas também a modelagem dos objetos. Essa imersão na terceira dimensão levanta o debate sobre a possibilidade de introduzir um “sentido” físico real às imagens, servindo de base para interações mais naturais entre humanos e máquinas.

Principais funcionalidades detalhadas do Meta SAM3 e SAM3D para visão computacional avançada

Meta SAM3 e SAM3D não se resumem somente à segmentação e reconstrução de objetos: esses modelos introduzem um conjunto de funcionalidades inovadoras que revolucionam a abordagem padrão do deep learning aplicado ao reconhecimento de imagem.

A funcionalidade principal, Promptable Concept Segmentation (PCS), permite segmentar com grande precisão conceitos expressos em linguagem natural. Essa capacidade funde compreensão linguística e interpretação visual em tempo real. Essa aliança oferece uma dupla vantagem: de um lado, elimina a necessidade de anotações manuais caras e, de outro, aumenta a acessibilidade das ferramentas de IA para um público amplo, seja ele especialista ou leigo.

Entre outras funcionalidades notáveis, podemos citar:

- Rastreamento temporal inteligente em vídeos, que utiliza masklets para manter a identidade dos objetos mesmo em caso de ocultação

- Gestão de ocultações parciais em 3D, permitindo a reconstrução coerente de objetos escondidos

- Capacidade de generalização “Zero-Shot”, oferecendo reconhecimento de objetos nunca encontrados na fase de treinamento

- Um mecanismo de validação por presence token, evitando erros de interpretação e limitando alucinações visuais

- Uma arquitetura unificada otimizada para execução rápida em imagens estáticas e fluxos de vídeo

Essas tecnologias avançadas têm o efeito direto de multiplicar as possibilidades de usos reais em muitos domínios, facilitando a criação, automação e análise precisa de elementos visuais complexos.

Desenvolvimento sustentado por um gigantesco Data Engine e o impacto na precisão

O poder do Meta SAM3 / SAM3D também se deve à imensa base de dados na qual os modelos foram treinados. Mais de 11 milhões de imagens anotadas foram usadas para dotar a IA de uma compreensão fina e diversificada do mundo visual.

Essa base massiva é complementada pelo benchmark SA-Co, uma coleção científica que inclui quase quatro milhões de conceitos distintos anotados. Essa riqueza permite à IA captar nuances extremamente sutis entre objetos próximos, como diferenciar uma “roda dianteira” de uma “roda traseira” em um veículo. Um exemplo que testemunha a sofisticação do modelo e sua capacidade de refinar a análise visual em contexto.

O processo de anotação baseia-se em um ciclo de trabalho híbrido inovador: a IA realiza uma pré-anotação automática acelerando o trabalho humano, depois os especialistas validam e corrigem em tempo real. Esse processo rápido, cerca de cinco vezes mais eficiente que a anotação manual tradicional, permitiu criar um Data Engine colossal e de altíssima qualidade.

Essa abordagem metódica garante ao Meta SAM3 / SAM3D uma robustez e confiabilidade importantes, minimizando erros e as “alucinações” que afetavam os sistemas anteriores. O resultado é um sistema ao mesmo tempo poderoso e preciso que promete transformar de maneira duradoura o processamento de imagens em grande escala.

Aplicações concretas do Meta SAM3 / SAM3D na indústria, ciência e lazer

As capacidades avançadas dos modelos SAM3 e SAM3D rapidamente atraem setores variados, gerando muitas aplicações inovadoras.

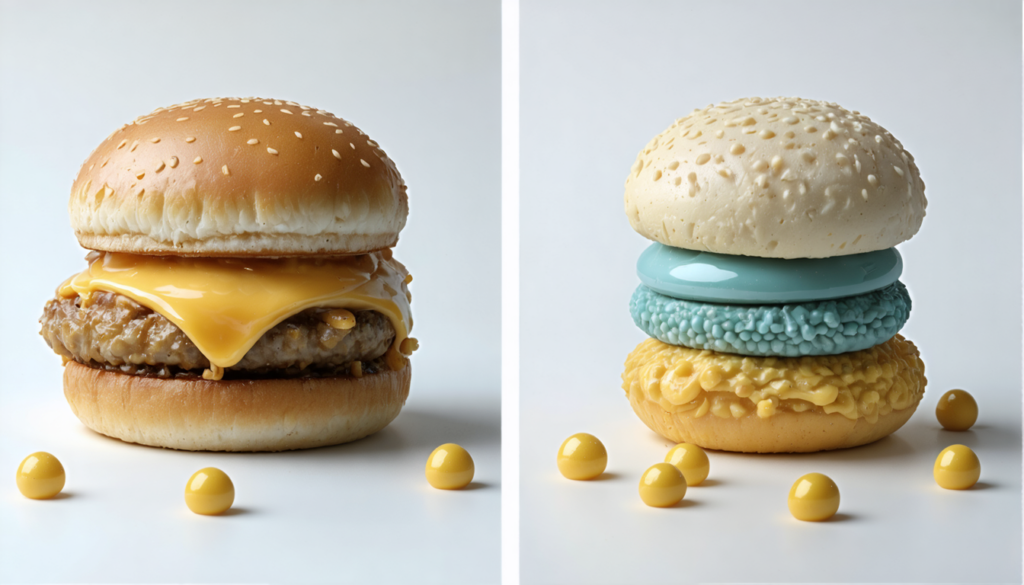

No comércio online, o Facebook Marketplace já explora o SAM3 via a função “View in Room”. Essa funcionalidade permite aos vendedores converter instantaneamente a foto de um produto, como uma cadeira, em um objeto 3D virtual para que o comprador possa visualizá-lo diretamente em seu interior via realidade aumentada. Uma experiência imersiva que revoluciona os códigos da venda à distância e melhora significativamente a taxa de conversão.

Os criadores de conteúdo no Instagram aproveitam as ferramentas de edição inteligentes desenvolvidas a partir do SAM3. Elas automatizam comandos complexos, como “desfocar o fundo” ou “transformar o céu em preto e branco”, executados em frações de segundo. Assim, a criação visual torna-se mais intuitiva e acessível, sem necessidade de competências técnicas avançadas.

Nas ciências naturais, a Conservation X Labs utiliza o SAM3 para analisar grandes volumes de imagens e vídeos capturados por armadilhas fotográficas. Identificar automaticamente espécies raras ou ameaçadas facilita muito a vigilância ecológica e a proteção da biodiversidade.

Finalmente, a robótica se beneficia de uma percepção aprimorada via SAM3D, essencial para a manipulação precisa de objetos em ambientes complexos. Os robôs podem calcular o ponto de preensão ótimo, navegar com facilidade por espaços apertados e reagir a comandos vocais para interagir com objetos desconhecidos, um avanço que redefine a robótica moderna.

Restrições e limitações atuais do Meta SAM3 / SAM3D a considerar

Apesar do avanço fulgurante no reconhecimento de imagem por inteligência artificial, a dupla SAM3 / SAM3D não está isenta de desafios e limitações técnicas.

Por exemplo, a qualidade das texturas 3D geradas às vezes é moderada. Detalhes finos como cabelos, malhas delicadas ou certos objetos transparentes podem aparecer borrados ou simplificados ao sair do modelo. Essa insuficiência limita o uso desses objetos em produções que exigem resolução cinematográfica muito alta, como filmes ou jogos AAA.

Outro desafio importante está na compreensão física real dos ambientes. O modelo “vê” as formas, mas não entende as propriedades materiais como gravidade, solidez ou colisão. Assim, acontece que objetos reconstruídos em 3D se cruzem ou se interpenetrem sem respeitar as leis físicas, uma limitação a ser compensada por intervenção manual na pós-produção.

Por fim, as alucinações visuais, embora reduzidas graças ao presence token, persistem em cenas complexas e carregadas onde objetos são muito semelhantes. O rastreamento de vídeo às vezes falha, exigindo controle humano para evitar erros críticos, especialmente na vigilância ou na área médica.

O alto consumo de memória de vídeo (VRAM) para executar esses modelos também limita seu uso em dispositivos móveis. Atualmente, um ambiente computacional potente e uma conexão robusta à internet são indispensáveis, dificultando o crescimento de usos embarcados e autônomos.

Comparativo entre Meta SAM3 / SAM3D e outras tecnologias IA de reconhecimento de imagem

Num setor em plena efervescência, existem muitas alternativas aos modelos da Meta, oferecendo soluções às vezes mais especializadas ou complementares.

| Tecnologia | Especificidade | Pontos fortes | Limitações |

|---|---|---|---|

| Meta SAM3 / SAM3D | Segmentação avançada e reconstrução 3D | Versatilidade, Zero-Shot, integração vídeo-imagem unificada | Alto consumo, texturas 3D limitadas |

| Google DeepMind Gemini 3 | Multimodalidade integral e raciocínio lógico | Excelência em análise documental complexa | Menos eficiente em geometria 3D pura |

| OpenAI Sora 2 | Geração e compreensão de vídeo dinâmico | Criação de cenas físicas realistas | Menos adequado para segmentação |

| YOLO | Detecção e contagem rápida de objetos | Extremamente leve e rápido | Menos preciso, sem reconstrução 3D |

| MedSAM | Especializado em imagens médicas | Certificação médica, alta precisão | Não versátil, uso muito específico |

Essa diversidade favorece o surgimento de uma oferta rica e adaptada a todos os usos, onde a generalização do Meta SAM3 / SAM3D é acompanhada por soluções especializadas com perfis específicos.

Acessibilidade, custos e modelos de uso do Meta SAM3 / SAM3D no cenário tecnológico atual

A Meta optou por uma política ambiciosa de abertura para seus modelos SAM3 e SAM3D. Os pesos desses modelos são gratuitos e acessíveis à pesquisa, principalmente por meio de plataformas populares como Hugging Face. Essa estratégia busca impor um padrão tecnológico aberto no domínio do reconhecimento e processamento de imagens por IA.

Contudo, a execução em tempo real requer uma infraestrutura poderosa, especialmente para obter um processamento em menos de 30 milissegundos por imagem. A presença de processadores gráficos performáticos como o H200 é essencial, limitando a disponibilidade a profissionais e centros de dados especializados.

Para usuários finais, o acesso geralmente é feito via cloud e interfaces web como o Segment Anything Playground, que permite testar essas ferramentas gratuitamente. Ainda assim, para integrar plenamente esses modelos em produtos comerciais, é necessário lidar com licenças específicas e geralmente caras chamadas “SAM License”, que regulam o uso e protegem a propriedade intelectual da Meta.

Em resumo, a tecnologia é amplamente democratizada para a pesquisa, mas sua industrialização demanda investimentos significativos em hardware e contratos jurídicos. Essa dualidade entre código gratuito e custo de uso é uma realidade frequente no setor de tecnologias revolucionárias de ponta.

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”O que é o modelo Meta SAM3?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Meta SAM3 é um modelo de inteligência artificial capaz de segmentar automática e rapidamente qualquer objeto presente em uma imagem ou vídeo a partir de uma simples descrição textual ou de um clique.”}},{“@type”:”Question”,”name”:”Como o SAM3D transforma imagens em objetos 3D?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”O SAM3D usa dados provenientes da visão multi-câmeras e de scans LiDAR para reconstruir objetos em três dimensões a partir de uma única foto, gerando malhas texturizadas manipuláveis.”}},{“@type”:”Question”,”name”:”Quais são as vantagens da segmentação conceitual (PCS)?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”A segmentação conceitual permite ao usuário pedir que o modelo isole precisamente objetos segundo descrições em linguagem natural, sem necessidade de treinamento específico, tornando as ferramentas acessíveis e poderosas.”}},{“@type”:”Question”,”name”:”Quais setores se beneficiam mais do Meta SAM3 / SAM3D?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Setores como comércio online, criação de conteúdo, robótica, vigilância por vídeo e conservação da biodiversidade utilizam ativamente essas tecnologias para melhorar seus processos.”}},{“@type”:”Question”,”name”:”O SAM3 / SAM3D é acessível gratuitamente?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Os modelos são acessíveis gratuitamente para pesquisa via plataformas abertas, mas o uso comercial geralmente requer licenças específicas e uma infraestrutura de cálculo custosa.”}}]}O que é o modelo Meta SAM3?

Meta SAM3 é um modelo de inteligência artificial capaz de segmentar automática e rapidamente qualquer objeto presente em uma imagem ou vídeo a partir de uma simples descrição textual ou de um clique.

Como o SAM3D transforma imagens em objetos 3D?

O SAM3D usa dados provenientes da visão multi-câmeras e de scans LiDAR para reconstruir objetos em três dimensões a partir de uma única foto, gerando malhas texturizadas manipuláveis.

Quais são as vantagens da segmentação conceitual (PCS)?

A segmentação conceitual permite ao usuário pedir que o modelo isole precisamente objetos segundo descrições em linguagem natural, sem necessidade de treinamento específico, tornando as ferramentas acessíveis e poderosas.

Quais setores se beneficiam mais do Meta SAM3 / SAM3D?

Setores como comércio online, criação de conteúdo, robótica, vigilância por vídeo e conservação da biodiversidade utilizam ativamente essas tecnologias para melhorar seus processos.

O SAM3 / SAM3D é acessível gratuitamente?

Os modelos são acessíveis gratuitamente para pesquisa via plataformas abertas, mas o uso comercial geralmente requer licenças específicas e uma infraestrutura de cálculo custosa.