Nell’era dell’intelligenza artificiale, la percezione visiva delle macchine non è mai stata così avanzata. Meta, gigante delle tecnologie digitali, ha appena superato una tappa cruciale con i suoi modelli SAM3 e SAM3D, che ridefiniscono il riconoscimento delle immagini e la visione artificiale. Questi nuovi sistemi integrano tecniche avanzate di deep learning e di elaborazione delle immagini, spingendo oltre i confini del possibile nell’analisi visiva. Più di una semplice segmentazione degli oggetti, è una capacità di comprendere, isolare e persino ricostruire in tre dimensioni gli elementi di una scena che apre vasti orizzonti.

Nel 2025, queste tecnologie si posizionano come strumenti rivoluzionari, capaci di trasformare il mondo digitale e fisico. Le loro prestazioni superiori nell’identificazione di oggetti a partire da una semplice descrizione testuale, la loro attitudine a mantenere la continuità visiva in sequenze video complesse e la loro capacità di ricostruzione 3D a partire dalle immagini fanno di SAM3 e SAM3D innovazioni di rilievo. Questi modelli, addestrati su una base di oltre 11 milioni di immagini, illustrano perfettamente il potenziale spettacolare dell’intersezione tra intelligenza artificiale e visione artificiale.

Questa svolta tecnologica influenzerà non solo i ricercatori e gli sviluppatori, ma anche le industrie creative, commerciali e scientifiche. Mentre l’elaborazione delle immagini diventa più intuitiva, efficiente e precisa, l’ascesa dei modelli IA avanzati come SAM3 e SAM3D promette di reinventare settori tanto diversi quanto la sorveglianza, il commercio online, la robotica o la conservazione della biodiversità. Scoprite un panorama dettagliato di queste innovazioni e delle loro implicazioni concrete nel riconoscimento delle immagini.

- 1 Come Meta SAM3 rivoluziona il riconoscimento delle immagini grazie alla segmentazione intelligente

- 2 SAM3D: la tecnologia di visione tridimensionale che trasforma una semplice foto in oggetto 3D

- 3 Funzionalità chiave dettagliate di Meta SAM3 e SAM3D per la visione artificiale avanzata

- 4 Lo sviluppo supportato da un gigantesco Data Engine e l’impatto sulla precisione

- 5 Applicazioni concrete di Meta SAM3 / SAM3D nell’industria, nella scienza e nel tempo libero

- 6 I vincoli e i limiti attuali di Meta SAM3 / SAM3D da considerare

- 7 Confronto tra Meta SAM3 / SAM3D e altre tecnologie IA di riconoscimento delle immagini

- 8 Accessibilità, costi e modelli d’uso di Meta SAM3 / SAM3D nel panorama tecnologico attuale

Come Meta SAM3 rivoluziona il riconoscimento delle immagini grazie alla segmentazione intelligente

Il modello Meta SAM3 si impone come un vero progresso nel campo del riconoscimento delle immagini tramite intelligenza artificiale. A differenza delle generazioni precedenti, questo sistema non si limita ad analizzare pixel isolati: segmenta con una precisione eccezionale ogni oggetto presente in un’immagine o in un video. Questa segmentazione si ottiene a partire da un semplice clic o anche da una descrizione testuale fornita dall’utente, semplificando radicalmente l’interazione tra umano e macchina.

Una delle forze di SAM3 risiede nella sua capacità di funzionare senza un addestramento specifico precedente. In altre parole, il modello può isolare istantaneamente un oggetto mai incontrato prima, qualunque sia la sua forma o le sue caratteristiche. Per esempio, un fotografo amatore che desideri estrarre tutte le biciclette rosse da una scena urbana deve solo scrivere la descrizione “tutte le biciclette rosse”. SAM3 identificherà e traccerà i contorni degli oggetti corrispondenti senza necessitare di un intervento laborioso o di una preparazione specifica dei dati. Questa funzionalità, chiamata Promptable Concept Segmentation (PCS), combina la comprensione del linguaggio naturale alla potenza visiva del deep learning, una combinazione resa possibile dall’architettura sofisticata sviluppata da Meta.

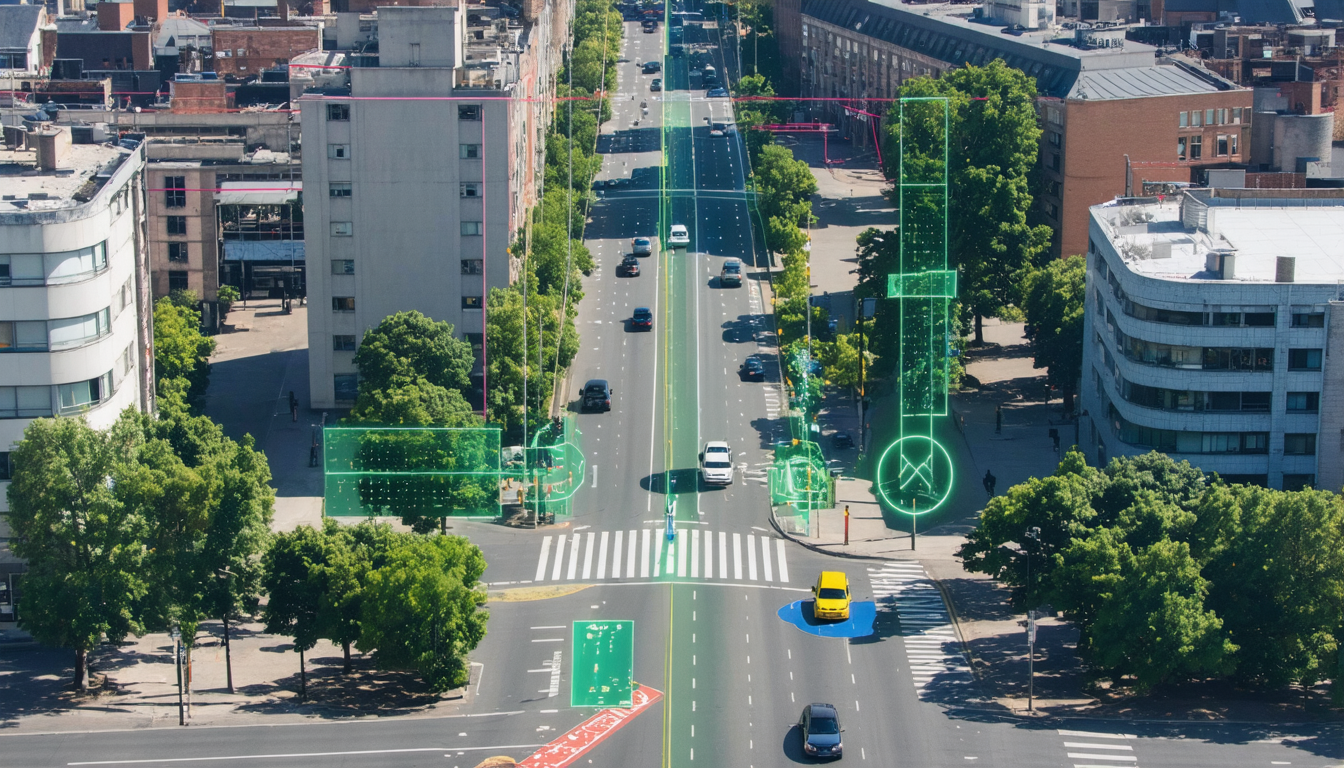

La segmentazione intelligente non si limita all’immagine statica: i flussi video beneficiano anch’essi di questo avanzato trattamento delle immagini. SAM3 utilizza “masklets” per seguire con precisione gli oggetti, anche quando sono parzialmente occultati o si muovono in scene dinamiche. Per esempio, in un video di sorveglianza, se una persona si sposta dietro un ostacolo, il modello continua a mantenerne il tracciamento senza confusione. Questa capacità garantisce un tracciamento temporale affidabile e apre la strada ad applicazioni come la videosorveglianza automatizzata o gli strumenti creativi di montaggio video istantaneo.

L’architettura unificata di SAM3 si distingue inoltre per la sua colonna vertebrale unica che elabora uniformemente immagini e video. Questa organizzazione interna riduce il consumo di risorse e aumenta la velocità di esecuzione, fornendo prestazioni ottimali anche in contesti esigenti. Grazie a questa ingegneria, SAM3 trasforma il riconoscimento delle immagini in un’esperienza fluida e accessibile, emblema dei progressi nell’intelligenza artificiale che segnano profondamente la visione artificiale nel 2025.

SAM3D: la tecnologia di visione tridimensionale che trasforma una semplice foto in oggetto 3D

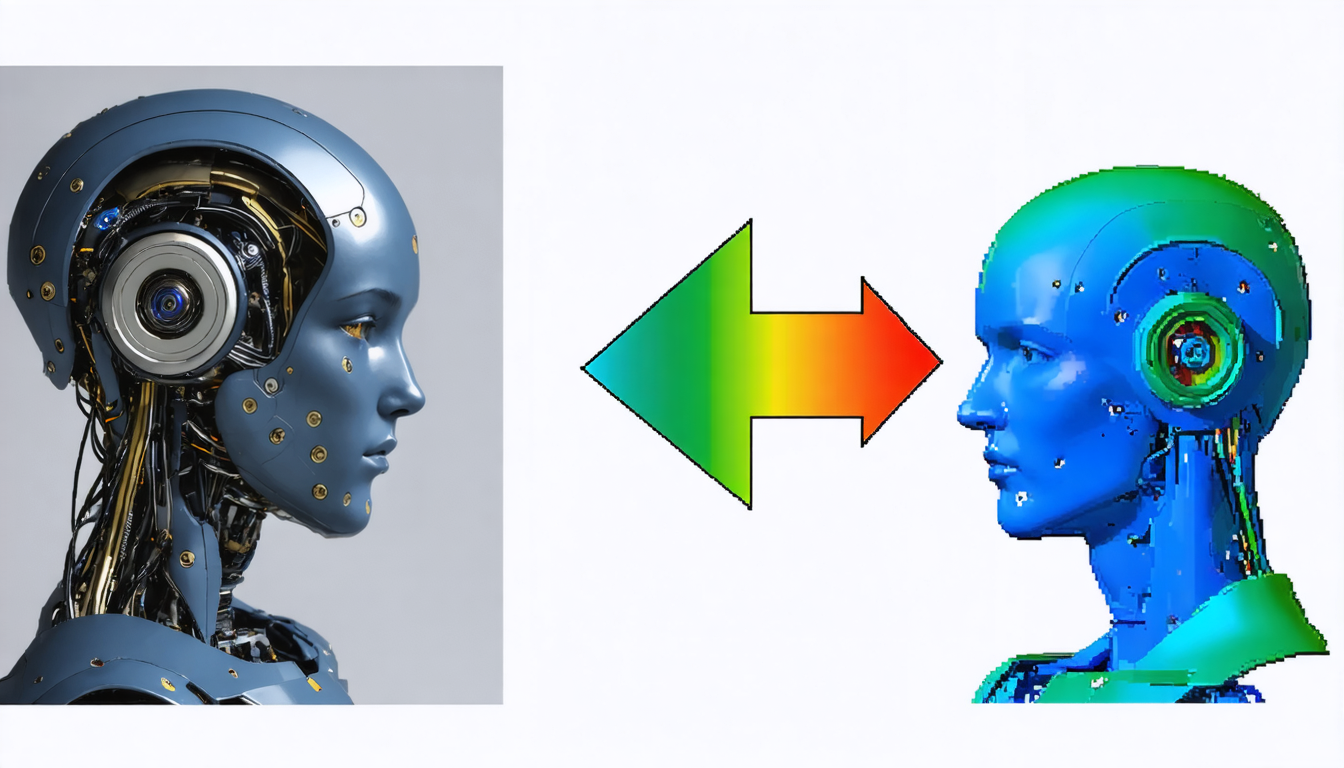

Oltre alla segmentazione classica, Meta innova con SAM3D, un modello che eleva il riconoscimento delle immagini al livello spaziale tridimensionale. Utilizzando dati di riferimento derivanti dalla visione artificiale multi-camera e scansioni LiDAR, SAM3D riesce a ricostruire oggetti in 3D da fotografie ordinarie, aprendo una nuova era nell’interpretazione visiva automatica.

Questa tecnologia si basa su due moduli specializzati. SAM 3D Objects si rivolge agli oggetti inanimati di uso quotidiano. A partire da una semplice foto, genera una mesh texturizzata manipolabile in tre dimensioni, capace di gestire occultamenti parziali. Così, se un oggetto è parzialmente nascosto dietro un altro, SAM3D può prevedere la forma mancante grazie a un ragionamento logico e contestuale intenso. Per esempio, in un’immagine dove una tazza copre parzialmente un vaso, il contenitore sarà ricostruito nella sua interezza, un’impresa che supera di gran lunga le capacità dei modelli tradizionali.

Per gli esseri viventi, in particolare gli umani, SAM 3D Body dispiega un modello inedito di rappresentazione corporea. Distingue tra scheletro, carne e persino abiti, permettendo un’analisi dettagliata delle pose e dei movimenti complessi. Questa innovazione conferisce agli avatar digitali una fluidità e un naturalezza mai viste, aprendo la strada ad applicazioni in realtà virtuale, animazione o ergonomia.

SAM3D rappresenta così un avanzamento fondamentale nel trattamento delle immagini in quanto trasforma non solo la percezione ma anche la modellazione degli oggetti. Questa immersione nella terza dimensione apre il dibattito sulla possibilità di introdurre un vero « senso » fisico alle immagini, servendo da base a interazioni più naturali tra umani e macchine.

Funzionalità chiave dettagliate di Meta SAM3 e SAM3D per la visione artificiale avanzata

Meta SAM3 e SAM3D non si limitano a una segmentazione e ricostruzione di oggetti: questi modelli introducono un insieme di funzionalità innovative che sconvolgono l’approccio standard del deep learning applicato al riconoscimento delle immagini.

La feature principale, Promptable Concept Segmentation (PCS), consente di segmentare con grande precisione concetti espressi in linguaggio naturale. Questa capacità fonde comprensione linguistica e interpretazione visiva in tempo reale. Questa alleanza offre un doppio vantaggio: da un lato elimina la necessità di annotazioni manuali costose e, dall’altro, aumenta l’accessibilità agli strumenti IA per un ampio pubblico, sia esso esperto o neofita.

Tra altre funzionalità notevoli, possiamo citare:

- Il tracciamento temporale intelligente nei video, che utilizza i masklets per mantenere l’identità degli oggetti anche in caso di occultamento

- La gestione delle occlusioni parziali in 3D, permettendo la ricostruzione coerente di oggetti nascosti

- La capacità di generalizzazione « Zero-Shot », offrendo il riconoscimento di oggetti mai incontrati nella fase di addestramento

- Un meccanismo di validazione tramite presence token, che evita errori di interpretazione e limita le allucinazioni visive

- Un’architettura unificata ottimizzata per l’esecuzione rapida su immagini statiche e flussi video

Queste tecnologie avanzate hanno come effetto diretto la moltiplicazione delle possibilità di usi reali in numerosi settori, facilitando la creazione, l’automazione e l’analisi precisa di elementi visivi complessi.

Lo sviluppo supportato da un gigantesco Data Engine e l’impatto sulla precisione

La potenza di Meta SAM3 / SAM3D deriva anche dall’immensa base di dati su cui i modelli sono stati addestrati. Più di 11 milioni di immagini annotate hanno servito a dotare l’IA di una comprensione fine e diversificata del mondo visivo.

Questa base massiccia è completata dal benchmark SA-Co, una raccolta scientifica che include quasi quattro milioni di concetti distinti annotati. Questa ricchezza consente all’IA di percepire sfumature sottilissime tra oggetti simili, come differenziare una « ruota anteriore » da una « ruota posteriore » su un veicolo. Un esempio che testimonia la sofisticazione del modello e la sua capacità di affinare l’analisi visiva nel contesto.

Il procedimento di annotazione si basa su un ciclo di lavoro ibrido innovativo: l’IA esegue una pre-annotazione automatica accelerando il lavoro umano, poi gli esperti convalidano e correggono in tempo reale. Questo processo rapido, circa cinque volte più efficiente dell’annotazione manuale tradizionale, ha permesso di creare un Data Engine colossale ed estremamente qualitativo.

Questo approccio metodico garantisce a Meta SAM3 / SAM3D robustezza e affidabilità importanti, minimizzando errori e « allucinazioni » sofferti dai sistemi precedenti. Il risultato è un sistema al contempo potente e preciso che promette di trasformare in modo duraturo il trattamento delle immagini su larga scala.

Applicazioni concrete di Meta SAM3 / SAM3D nell’industria, nella scienza e nel tempo libero

Le capacità avanzate dei modelli SAM3 e SAM3D conquistano rapidamente settori diversi, generando numerose applicazioni innovative.

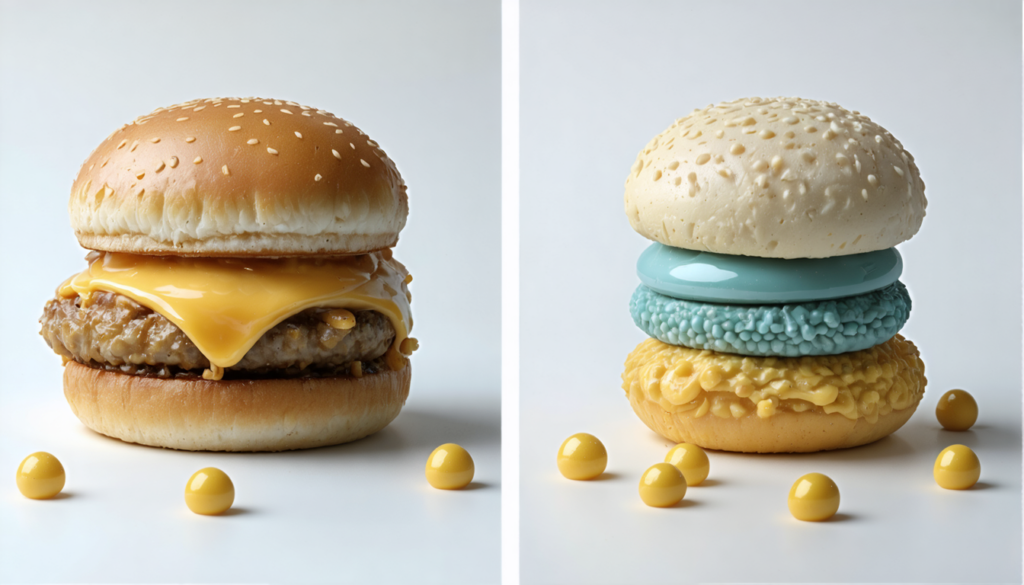

Nel commercio online, Facebook Marketplace sfrutta già SAM3 tramite la funzione « View in Room ». Questa funzionalità permette ai venditori di convertire istantaneamente la foto di un prodotto, come una sedia, in un oggetto 3D virtuale affinché l’acquirente possa visualizzarlo direttamente nel suo interno tramite la realtà aumentata. Un’esperienza immersiva che stravolge le regole della vendita a distanza e migliora significativamente il tasso di conversione.

I creatori di contenuti su Instagram usufruiscono degli strumenti di montaggio intelligenti sviluppati a partire da SAM3. Questi automatizzano comandi complessi, come « sfocare lo sfondo » o « trasformare il cielo in bianco e nero », eseguiti in una frazione di secondo. Così, la creazione visiva diventa più intuitiva e accessibile, senza bisogno di competenze tecniche approfondite.

In scienze naturali, Conservation X Labs usa SAM3 per analizzare enormi volumi di immagini e video catturati da fototrappole. Identificare automaticamente specie rare o minacciate facilita grandemente la sorveglianza ecologica e la protezione della biodiversità.

Infine, la robotica beneficia di una percezione migliorata tramite SAM3D, essenziale per la manipolazione precisa di oggetti in ambienti complessi. I robot possono calcolare il punto di presa ottimale, navigare con facilità in spazi ristretti e rispondere a comandi vocali per interagire con oggetti sconosciuti, un progresso che ridefinisce la robotica moderna.

I vincoli e i limiti attuali di Meta SAM3 / SAM3D da considerare

Nonostante il suo rapido progresso nel riconoscimento delle immagini tramite intelligenza artificiale, la coppia SAM3 / SAM3D non è esente da sfide e vincoli tecnici.

Per esempio, la qualità delle texture 3D generate rimane a volte moderata. I dettagli fini come i capelli, le maglie sottili o alcuni oggetti trasparenti possono apparire sfocati o semplificati all’uscita dal modello. Questa insufficienza limita l’uso di questi oggetti in produzioni che richiedono una risoluzione cinematografica molto elevata, come film o giochi AAA.

Un’altra sfida importante riguarda la reale comprensione fisica degli ambienti. Il modello « vede » le forme ma non comprende le proprietà materiali come la gravità, la solidità o la collisione. Così capita che oggetti ricostruiti in 3D si attraversino o si interpenetrino senza rispettare le leggi fisiche, un limite da compensare con un intervento manuale in post-produzione.

Infine, le allucinazioni visive, sebbene ridotte grazie al presence token, persistono in scene complesse e cariche dove oggetti si somigliano fortemente. Il tracciamento video a volte può interrompersi, richiedendo un controllo umano per evitare errori critici, soprattutto nella sorveglianza o in ambito medico.

Il consumo elevato di memoria video (VRAM) per eseguire questi modelli limita anche il loro dispiegamento su dispositivi mobili. Attualmente, un ambiente informatico potente e una connessione internet robusta sono indispensabili, frenando l’espansione di usi autonomi embedded.

Confronto tra Meta SAM3 / SAM3D e altre tecnologie IA di riconoscimento delle immagini

In un settore in piena effervescenza, molte alternative esistono di fronte ai modelli Meta, offrendo soluzioni talvolta più specializzate o complementari.

| Tecnologia | Specificità | Punti di forza | Limiti |

|---|---|---|---|

| Meta SAM3 / SAM3D | Segmentazione avanzata e ricostruzione 3D | Polivalenza, Zero-Shot, integrazione video-immagine unificata | Consumo elevato, texture 3D limitate |

| Google DeepMind Gemini 3 | Multimodalità integrale e ragionamento logico | Eccellenza nell’analisi documentale complessa | Meno performante in geometria 3D pura |

| OpenAI Sora 2 | Generazione e comprensione video dinamica | Creazione di scene fisiche realistiche | Meno adatto alla segmentazione |

| YOLO | Rilevamento e conteggio rapido di oggetti | Estremamente leggero e veloce | Meno preciso, nessuna ricostruzione 3D |

| MedSAM | Specializzato in imaging medico | Certificazione medica, alta precisione | Non polivalente, uso molto mirato |

Questa diversità favorisce l’emergere di un’offerta ricca e adatta a tutti gli usi, dove la generalizzazione di Meta SAM3 / SAM3D si accompagna a soluzioni specializzate con profili specifici.

Accessibilità, costi e modelli d’uso di Meta SAM3 / SAM3D nel panorama tecnologico attuale

Meta ha scelto una politica di apertura ambiziosa per i suoi modelli SAM3 e SAM3D. I pesi di questi modelli sono gratuiti e accessibili alla ricerca, in particolare tramite piattaforme popolari come Hugging Face. Questa strategia risponde all’obiettivo di imporre uno standard tecnologico aperto nel campo del riconoscimento e del trattamento delle immagini tramite IA.

Tuttavia, l’esecuzione in tempo reale richiede un’infrastruttura potente, soprattutto per ottenere un trattamento sotto i 30 millisecondi per immagine. La presenza di processori grafici performanti come l’H200 è essenziale, limitando la disponibilità ai professionisti e ai centri dati specializzati.

Per gli utenti comuni, l’accesso avviene spesso tramite cloud e interfacce web come Segment Anything Playground, che consente di testare gratuitamente questi strumenti. Tuttavia, per integrare pienamente questi modelli in prodotti commerciali, è necessario confrontarsi con licenze specifiche e spesso costose chiamate « SAM License », che regolano l’uso e proteggono la proprietà intellettuale di Meta.

In sintesi, la tecnologia è ampiamente democratizzata per la ricerca ma la sua industrializzazione richiede investimenti significativi in hardware e contratti legali. Questa dualità tra gratuità del codice e costo d’uso è una realtà frequente nel settore delle tecnologie rivoluzionarie d’avanguardia.

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Che cos’è il modello Meta SAM3?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Meta SAM3 è un modello di intelligenza artificiale capace di segmentare automaticamente e rapidamente qualsiasi oggetto presente in un’immagine o in un video a partire da una semplice descrizione testuale o da un clic.”}},{“@type”:”Question”,”name”:”Come SAM3D trasforma le immagini in oggetti 3D?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”SAM3D utilizza dati derivanti dalla visione multi-camera e scansioni LiDAR per ricostruire oggetti in tre dimensioni a partire da una sola foto, generando mesh texturizzate manipolabili.”}},{“@type”:”Question”,”name”:”Quali sono i vantaggi della segmentazione concettuale (PCS)?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”La segmentazione concettuale permette all’utente di chiedere al modello di isolare con precisione oggetti secondo descrizioni in linguaggio naturale, senza necessità di addestramento specifico, rendendo gli strumenti accessibili e potenti.”}},{“@type”:”Question”,”name”:”Quali settori beneficiano maggiormente di Meta SAM3 / SAM3D?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Settori come il commercio online, la creazione di contenuti, la robotica, la videosorveglianza e la conservazione della biodiversità sfruttano attivamente queste tecnologie per migliorare i propri processi.”}},{“@type”:”Question”,”name”:”SAM3 / SAM3D sono accessibili gratuitamente?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”I modelli sono accessibili gratuitamente per la ricerca tramite piattaforme aperte, ma l’uso commerciale richiede spesso licenze specifiche e un’infrastruttura di calcolo costosa.”}}]}Che cos’è il modello Meta SAM3?

Meta SAM3 è un modello di intelligenza artificiale capace di segmentare automaticamente e rapidamente qualsiasi oggetto presente in un’immagine o in un video a partire da una semplice descrizione testuale o da un clic.

Come SAM3D trasforma le immagini in oggetti 3D?

SAM3D utilizza dati derivanti dalla visione multi-camera e scansioni LiDAR per ricostruire oggetti in tre dimensioni a partire da una sola foto, generando mesh texturizzate manipolabili.

Quali sono i vantaggi della segmentazione concettuale (PCS)?

La segmentazione concettuale permette all’utente di chiedere al modello di isolare con precisione oggetti secondo descrizioni in linguaggio naturale, senza necessità di addestramento specifico, rendendo gli strumenti accessibili e potenti.

Quali settori beneficiano maggiormente di Meta SAM3 / SAM3D?

Settori come il commercio online, la creazione di contenuti, la robotica, la videosorveglianza e la conservazione della biodiversità sfruttano attivamente queste tecnologie per migliorare i propri processi.

SAM3 / SAM3D sono accessibili gratuitamente?

I modelli sono accessibili gratuitamente per la ricerca tramite piattaforme aperte, ma l’uso commerciale richiede spesso licenze specifiche e un’infrastruttura di calcolo costosa.