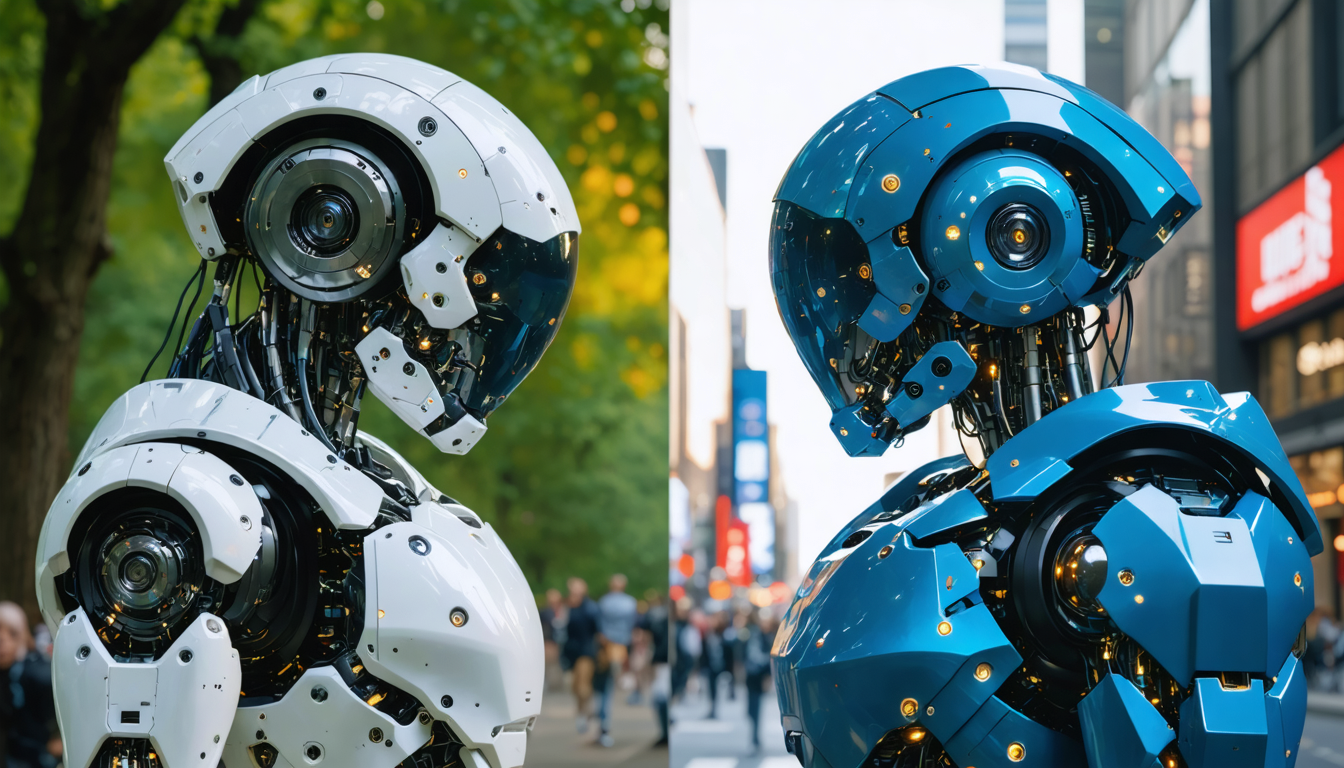

OpenAI और अमेरिका के युद्ध विभाग के बीच नई साझेदारी 2026 की शुरुआत में एक बड़ा विवाद खड़ा कर रही है: क्या यह स्वीकार किया जाना चाहिए कि लोकप्रिय कृत्रिम बुद्धिमत्ता तकनीकें सैन्य उपकरण बन जाएं? जबकि एंथ्रोपिक, एआई क्षेत्र का एक बड़ा प्रतियोगी, अपने मॉडलों के सैन्यीकरण में शामिल होने से पूरी तरह इंकार करता है, OpenAI एक विवादास्पद भागीदारी के लिए सहमति देता है। यह रणनीतिक भिन्नता उपयोगकर्ता समुदाय में एक स्तब्धता पैदा करती है, “Cancel ChatGPT” आंदोलन को जन्म देती है जो नैतिक त्याग की निंदा करने वालों को एकजुट करती है। यह केवल एक तकनीकी विवाद नहीं है, बल्कि मूल्य और जिम्मेदारियों के बीच एक गहरी दरार है जो इस मोड़ को जन्म देती है। जब एंथ्रोपिक का सहायक Claude एप्लिकेशन की रैंकिंग में ऊपर चढ़ता है, तो एआई दिग्गजों के प्रति विश्वास का सवाल महत्वपूर्ण हो जाता है, जिसके प्रभाव केवल बाजार तक सीमित नहीं हैं बल्कि ब्रांड छवि और नियमन के भविष्य पर भी पड़ते हैं।

जनसाधारण एआई तकनीकों का सैन्यीकरण 2026 में उपयोगकर्ताओं के चयन में एक निर्णायक मुद्दा बन गया है। प्रदर्शन या कार्यक्षमता से परे, नैतिकता, पारदर्शिता और अंतिम उद्देश्यों के प्रश्न अब प्राथमिकता प्राप्त कर रहे हैं। OpenAI और एंथ्रोपिक के बीच यह ध्रुवीकरण व्यापक समस्याओं को भी उजागर करता है, विशेष रूप से स्वायत्त हथियारों के नियंत्रण, जन निगरानी, और सैन्य प्रशासन के प्रति एआई कंपनियों की भूमिका के संबंध में। जबकि कुछ OpenAI में सुरक्षा उपायों की इच्छा की सराहना करते हैं, अन्य सैन्य उपयोग के लिए केवल सहमति को एक तोड़फोड़ मानते हैं, जो ChatGPT के प्रति स्पष्ट अपवाह का कारण बनता है। यह मामला नवाचार, व्यावसायिक आवश्यकताओं और नैतिक मांगों के बीच एक अंतर्निहित संघर्ष को दर्शाता है जो डिजिटल युग के लिए प्रासंगिक है।

- 1 OpenAI – युद्ध विभाग समझौते के परिणाम: “Cancel ChatGPT” आंदोलन और उपयोगकर्ताओं पर प्रभाव

- 2 Anthropic: नैतिकता और कृत्रिम बुद्धिमत्ता के सैन्यीकरण का विरोध

- 3 OpenAI में सुरक्षा उपाय: सैन्यीकरण के लिए सहमति और सीमाएं, आधिकारिक तर्क

- 4 नैतिकता और तकनीक: जब आम जनता AI के सैन्यीकरण के सवालों को सामने लाती है

- 5 कृत्रिम बुद्धिमत्ता क्षेत्र में प्रतिक्रियाएं और रुख

- 6 भविष्य: एक युग जहाँ नैतिकता लंबे समय तक AI में रणनीतिक साझेदारियों को आकार देती है

- 7 रणनीतिक क्षेत्रों में AI के नैतिक और जिम्मेदार समावेशन के लिए मार्ग

- 8 OpenAI, Anthropic और AI सैन्यीकरण विवाद पर सामान्य प्रश्न

- 8.1 Anthropic ने अपने AI के सैन्यीकरण से इंकार क्यों किया?

- 8.2 OpenAI का दावा है कि उसने सैन्य साझेदारी में कौन-कौन से गारंटी हासिल की हैं?

- 8.3 OpenAI – युद्ध विभाग की साझेदारी का आम जनता पर क्या प्रभाव पड़ा है?

- 8.4 क्या Anthropic के Claude ने सैन्यीकरण से इंकार के कारण लाभ उठाया?

- 8.5 AI के सैन्यीकरण के लिए भविष्य के प्रमुख मुद्दे क्या हैं?

OpenAI – युद्ध विभाग समझौते के परिणाम: “Cancel ChatGPT” आंदोलन और उपयोगकर्ताओं पर प्रभाव

OpenAI और अमेरिकी युद्ध विभाग के बीच आधिकारिक साझेदारी की घोषणा ने एआई उपयोगकर्ता समुदाय में अभूतपूर्व हलचल मचा दी। तुरंत ही, “Cancel ChatGPT” हैशटैग सोशल मीडिया पर उभरा, जो बड़े पैमाने पर और तेज़ विरोध को दर्शाता है। ChatGPT Plus की अनइंस्टॉल और सदस्यता रद्द करने की इस लहर से पता चलता है कि किसी सेवा को स्वीकार या अस्वीकार करना अब केवल तकनीकी दक्षता तक सीमित नहीं है, बल्कि कंपनी के मूल्यों पर नैतिक निर्णय पर आधारित है।

मुख्य रूप से X (पूर्व ट्विटर) और Reddit पर सक्रिय इंटरनेट उपयोगकर्ता अपनी मान्यताओं की रक्षा के लिए विस्तृत मार्गदर्शिकाएं साझा कर रहे हैं, जिनमें उनके डेटा को एक्सपोर्ट करना, ChatGPT अकाउंट हटाना और एंथ्रोपिक के Claude जैसे अधिक नैतिक विकल्पों की ओर पलायन शामिल है। उदाहरण के लिए, एक उपयोगकर्ता ने Reddit पर इस संक्रमण को सरल बनाने के लिए पूरी वीडियो ट्यूटोरियल श्रृंखला प्रकाशित की, जबकि कई विशेषज्ञ ब्लॉगों ने OpenAI की नीति की तुलना विस्तार से की, खासकर सैन्यीकरण के खिलाफ एंथ्रोपिक के रुख को उजागर करते हुए।

यह केवल एक फैशन का मामला नहीं है। यह घटना पहली बार है जब जनसाधारण एआई के सैन्यीकरण ने उपयोगकर्ता वफादारी के लिए एक मौलिक मानदंड बनना शुरू किया है। वास्तव में, कुछ इंटरनेट समुदायों ने न केवल विरोध किया बल्कि वैश्विक सुरक्षा, निगरानी और स्वायत्त हथियारों से जुड़े जोखिमों पर आलोचनात्मक विमर्श को भी संगठित किया।

यह विरोध आर्थिक आयाम भी ग्रहण कर चुका है: ऐप स्टोर और प्ले स्टोर में एंथ्रोपिक की AI Claude डाउनलोड के शीर्ष स्थान पर आ गई है, जो सीधे ChatGPT की नैतिक बहिष्कार से लाभ उठा रही है। इसके अलावा, यह उल्लेखनीय है कि इस बढ़ोतरी के दौरान तकनीकी समस्याएं भी देखी गईं, जैसे नए उपयोगकर्ताओं की अचानक भारी संख्या के कारण सर्वर लोड में वृद्धि। इससे पता चलता है कि नैतिकता एआई समाधानों की स्थिति और प्रतिस्पर्धा में एक मुख्य कारक बन गई है।

“Cancel ChatGPT” आंदोलन के मुख्य परिणामों का एक सारांश यहां दिया गया है:

- ChatGPT Plus की भुगतान सदस्यताओं में भारी वृद्धि हुई समाप्ति।

- प्लेटफॉर्म को प्रभावी ढंग से छोड़ने के लिए शैक्षिक संसाधनों का निर्माण और प्रसार।

- एंथ्रोपिक की AI Claude की एप्लिकेशन स्टोर रैंकिंग में चौंकाने वाली वृद्धि।

- सामाजिक बहस में सैन्य उपयोगों के प्रति एआई कंपनियों की जिम्मेदारी पर वृद्धि।

- उपयोगकर्ताओं के बीच सैन्यीकरण को स्वीकार या अस्वीकार करने के आधार पर ध्रुवीकरण में बढ़ोतरी।

ChatGPT Plus रद्द करने और Claude पर स्थानांतरित होने के लिए एक मार्गदर्शिका का उदाहरण

एक उपयोगकर्ता समूह द्वारा प्रकाशित मार्गदर्शिका बताती है कि सदस्यता रद्द करने की प्रक्रिया सरल है लेकिन इसमें कई महत्वपूर्ण चरणों का पालन करना आवश्यक है: व्यक्तिगत डेटा निर्यात करना, वार्तालाप इतिहास हटाना, विभिन्न उपकरणों पर ऐप्स अनइंस्टॉल करना, और फिर आधिकारिक स्टोर्स के माध्यम से Claude की सदस्यता लेना।

यह दस्तावेज केवल तकनीकी व्याख्या तक सीमित नहीं है, बल्कि नैतिक विकल्प की प्रकृति को भी उजागर करता है, “ऐसे अभिनेता का समर्थन न करना जो संभावित रूप से सैन्य रूप से प्रयुक्त की जाने वाली कृत्रिम बुद्धिमत्ता प्रदान करने के लिए सहमत हो।”

Anthropic: नैतिकता और कृत्रिम बुद्धिमत्ता के सैन्यीकरण का विरोध

Anthropic, OpenAI का प्रतियोगी और Claude का निर्माता, अपनी कृत्रिम बुद्धिमत्ता तकनीकों के सैन्यीकरण के खिलाफ एक दृढ़ रुख अपनाता है। Pentagon के साथ समझौता करने के बजाय, Anthropic ने सहमति देने से परहेज़ किया, यह दावा करते हुए कि जन निगरानी और बिना नियंत्रण के स्वायत्त हथियारों को रोकने के लिए पर्याप्त गारंटी नहीं हैं।

ऐसे संदर्भ में जहां सरकारी वित्तपोषण सैकड़ों मिलियन डॉलर तक हो सकता है, यह अस्वीकार दीर्घकालिक के लिए एक जोखिम भरा दांव है। हालांकि, यह निर्णय एक गुणवत्ता रणनीति का हिस्सा है जो कंपनी की प्रतिष्ठा, सुरक्षा और नैतिक मूल्यों की रक्षा का लक्ष्य रखती है।

Anthropic सुरक्षा के सिद्धांत को अपनी नीति की आधारशिला के रूप में प्रस्तुत करता है। कंपनी किसी भी सैन्य सहयोग के लिए स्पष्ट, नियंत्रणीय और पारदर्शी सुरक्षा उपायों की स्थापना को बिना शर्त मानता है। यह अंतर महत्वपूर्ण है: यह एक पूर्ण इंकार और नैतिक नियमों पर संवाद के बीच संतुलन है।

एक सार्वजनिक आंतरिक नोट में प्रबंधन ने यह स्पष्ट किया कि:

“हम मानते हैं कि बिना कड़े और जांच योग्य ढांचे के AI का सैन्यीकरण समाज के लिए बहुत बड़े जोखिम प्रस्तुत करता है। किसी भी शक्ति के पास पूरी तरह से स्वायत्त हथियार नहीं होने चाहिए बिना मजबूत नियंत्रण तंत्र के।”

यह रुख Claude को एक नैतिक उपकरण के रूप में प्रतिष्ठित करता है, जो एक उत्तरदायी और सावधान कृत्रिम बुद्धिमत्ता के बीमे पर बनाया और तैनात किया गया है।

उपयोगकर्ताओं पर इसका प्रभाव महसूस किया गया है। बाजारों में इसके प्रभाव के प्रमाण के रूप में Claude अब App Store और Play Store पर हावी है, जो नैतिक रणनीति के उपभोक्ता व्यवहार पर प्रभाव को स्थापित करता है।

Anthropic की नीति कई आयामों को समेटती है:

- परिनियोजन में सुरक्षा और सुरक्षित्ता पर ज़ोर।

- सैन्य उपयोग के लिए पारदर्शिता और नियंत्रण की मांग।

- शर्तबद्ध सहयोग स्वीकार करना, न कि पूर्ण विराम।

- एक नैतिक रुख, जो प्रतियोगी लाभ प्रदान करता है।

अस्वीकृति की लागत: रणनीतिक और वित्तीय मुद्दे

युद्ध विभाग के साथ इतना लाभकारी करार अस्वीकार करना वित्तीय नुकसान भी है, एक ऐसा क्षेत्र जहां निवेश प्रतिस्पर्धा बनाए रखने के लिए प्राथमिकता है। फिर भी, यह विकल्प उन जगहों पर नैतिक समझौतों को प्राथमिकता देता है जहां तात्कालिक लाभों को महत्व दिया जाता है।

2026 में यह भिन्नता क्षेत्र की गति में एक मोड़ है। यह एआई कंपनियों के मूल्यांकन के मानदंडों को पुनर्परिभाषित करता है, न केवल तकनीकी प्रदर्शन पर बल्कि उनके ऑपरेशनल नैतिकता पर भी।

OpenAI में सुरक्षा उपाय: सैन्यीकरण के लिए सहमति और सीमाएं, आधिकारिक तर्क

OpenAI अमेरिकी रक्षा मंत्रालय के साथ अपने समझौते को पूरी तरह स्वीकार करता है। कंपनी बताती है कि इसने Anthropic को दी गई तुलना में अधिक सुरक्षा उपाय के साथ एक ढांचा बातचीत द्वारा स्थापित किया है। यह समझौता जन निगरानी और पूरी तरह से स्वायत्त हथियारों से जुड़ी अनुप्रयोगों को बाहर रखता है।

आधिकारिक दस्तावेज़ इस बात पर जोर देता है कि सैन्य उपयोग “वैध” माने जाने वाली ऑपरेशनों तक सीमित रहेंगे, जिसमें मानवाधिकारों का सम्मान स्पष्ट रूप से शामिल है। OpenAI इन सीमाओं के कड़ाई से पालन की निगरानी का वादा भी करता है।

फिर भी, सार्वजनिक क्षेत्र में प्रतिक्रिया मिश्रित बनी हुई है। “वैध उद्देश्यों” की धारणा कानूनी और राजनीतिक ढांचे के विकास के अधीन है, जिससे उपयोगकर्ताओं में भारी संदेह उत्पन्न होता है। उन्हें डर है कि कानूनी प्रावधान समय के साथ विकसित होकर विवादास्पद उपयोग की अनुमति दे सकते हैं।

OpenAI द्वारा उठाया गया यह मोड़, जिसने पहले Anthropic के साथ एक कड़े सुरक्षा दृष्टिकोण का समर्थन किया था, अपने समुदाय के एक हिस्से को झकझोर देता है। यह नैतिक असंगति की भावना को बढ़ावा देता है, जो पहले से ही एकopaque और जटिल क्षेत्र में है।

OpenAI की सैन्यीकरण के लिए सहमति की स्थिति के मुख्य बिंदु यहां हैं:

- एक कड़ा ढांचा जो जन निगरानी को बाहर करता है।

- पूरी तरह स्वायत्त हथियार नहीं विकसित करने की प्रतिबद्धता।

- युद्ध विभाग के भीतर उपयोगों का नियमित निरीक्षण और ऑडिट।

- नवाचार और सुरक्षा के संयोजन के लिए व्यावहारिक सहयोग की अपील।

- लंबी अवधि में “वैध” की परिभाषा में संभावित विविधता जोखिम।

उपयोगकर्ताओं का विश्वास क्यों थमता जा रहा है

OpenAI की आलोचनाएं केवल इस मामले तक सीमित नहीं हैं, बल्कि एक व्यापक अविश्वास के संदर्भ में हैं: प्रशिक्षण डेटा के संदर्भ में ऑपरेशन, उच्च ऊर्जा खपत, सामाजिक और व्यावसायिक प्रभाव। सैन्य रुचि ने पारदर्शिता पर भरोसे को कमजोर किया है।

नैतिकता और तकनीक: जब आम जनता AI के सैन्यीकरण के सवालों को सामने लाती है

यह मामला एक अभूतपूर्व परिवर्तन को चिह्नित करता है कि आम जनता कृत्रिम बुद्धिमत्ता के मुद्दों को कैसे देखती है। पहले, विवाद अक्सर तकनीकी अमूर्तताएं थे: एल्गोरिथमिक पूर्वाग्रह, डेटा गोपनीयता, या पर्यावरणीय प्रभाव। अब, सैन्यीकरण का विषय सीधे नागरिक समाज को जोड़ता है, गहरा भावनात्मक और राजनीतिक प्रभाव देते हुए।

यह बदलाव असंयमित उपयोग के संभावित परिणामों के प्रति बढ़ी हुई जागरूकता का परिणाम है, विशेषकर रक्षा जैसे संवेदनशील क्षेत्र में। उपयोगकर्ता अब केवल प्रदर्शन या नवाचार नहीं चाहते, बल्कि अपनी मूल्यों के साथ संरेखण भी चाहते हैं। वे समझते हैं कि AI केवल तटस्थ उपकरण नहीं हैं, बल्कि इनमें मूलभूत नैतिक विकल्प निहित हैं।

यह विकास AI डेवलपर्स को अपनी व्यावसायिक रणनीतियों का गहराई से पुनर्मूल्यांकन करने के लिए बाध्य करता है। नैतिकता अब उपयोगकर्ता आधार बनाए रखने के लिए एक केंद्रीय तत्व बन गई है, जो अपने सिद्धांतों के विरुद्ध निर्णयों को दंडित करने में संकोच नहीं करते।

साथ ही, सैन्य AI के नियमन को लेकर राजनीतिक दबाव बढ़ रहा है। सार्वजनिक राय अब विधायी और अंतरराष्ट्रीय चर्चा में भूमिका निभाने लगी है, युद्धोन्मुख तकनीकों की होड़ से बचने के लिए पारदर्शिता और कड़े नियमों की मांग कर रही है।

AI के सैन्यीकरण से उठे मुख्य प्रश्न:

- AI तकनीकों के डिजाइन में कंपनियों की नैतिक जिम्मेदारी।

- स्वायत्त हथियारों पर नियंत्रण खोने से जुड़े जोखिम।

- AI द्वारा संभावित व्यापक और आक्रामक निगरानी।

- अंतिम उपयोगकर्ताओं की जागरूक सहमति और सूचना।

- अंतरराष्ट्रीय समन्वित नियमन की आवश्यकता।

कृत्रिम बुद्धिमत्ता क्षेत्र में प्रतिक्रियाएं और रुख

OpenAI और Anthropic से परे, पूरा तकनीकी क्षेत्र AI के सैन्यीकरण को लेकर आलोचनाओं की आग में है। कई प्रतिष्ठित खिलाड़ी अपनी स्थिति स्पष्ट करना और सार्वजनिक रूप से अपनी प्रतिबद्धताएं साझा करना मजबूर हुए हैं।

कुछ छोटे खिलाड़ी जैसे Anthropic अपनी सतर्कता और सैन्य अनुबंधों के अस्वीकार के जरिये नैतिक और जिम्मेदार विकास को प्राथमिकता देते हैं। जबकि अन्य बड़ी कंपनियां सरकारों के साथ सहयोग करना पसंद करती हैं, यह तर्क देते हुए कि रणनीतिक महत्त्व वाले क्षेत्रों में सुरक्षित रूपरेखा बनाना आवश्यक है।

यह ध्रुवीकरण वित्तीय निवेश में भी परिलक्षित होता है। क्षेत्र में विभिन्न सैन्य साझेदारियों की एक तुलनात्मक तालिका एआई कंपनियों के रणनीतिक विकल्पों को दर्शाती है:

| कंपनी | सैन्य साझेदारी | नैतिक रुख | राशि (मिलियन $) |

|---|---|---|---|

| OpenAI | हां, अमेरिका के युद्ध विभाग के साथ | सुरक्षा उपायों के साथ सहमति | 200 |

| Anthropic | नहीं, सतर्क अस्वीकृति | बिना समझौते का अस्वीकार | 0 |

| Google DeepMind | सीमित सहयोग, निगरानी | मिश्रित स्थिति, बढ़ा हुआ नियंत्रण | 150 |

| Microsoft | यू.एस. सैनिकों के लिए AI एकीकरण | कठोर सहमति | 180 |

प्रौद्योगिकी निवेशक, जैसे Aidan Gold, सार्वजनिक रूप से OpenAI के नैतिक द्वंद्व पर भी बोलते हैं जो समझौते पर हस्ताक्षर से पहले था। वे विशेष रूप से उस विरोधाभास पर ध्यान देते हैं जहां Anthropic की सुरक्षा स्थिति का अस्थायी रूप से समर्थन किया गया था फिर अचानक दिशा बदली।

भविष्य: एक युग जहाँ नैतिकता लंबे समय तक AI में रणनीतिक साझेदारियों को आकार देती है

OpenAI-Anthropic मामला एक नए युग के उदय को दर्शाता है जहाँ AI का सैन्यीकरण एक महत्वपूर्ण नैतिक परीक्षा बन गया है। कंपनियां केवल तकनीकी वादे पर निर्भर नहीं रह सकतीं; उन्हें अब अपनी रणनीतिक निर्णयों को उपयोगकर्ताओं द्वारा स्वीकृत नैतिकता के अनुरूप लाना होगा।

हाल के उदाहरण दिखाते हैं कि यह मांग बाधा नहीं बल्कि अवसर है। Anthropic के लिए, एक बड़े सरकारी अनुबंध को अस्वीकार करना चरित्र की ताकत और जिम्मेदार अंतरराष्ट्रीय भूमिका की इच्छा को दर्शाता है।

OpenAI के लिए चुनौती अधिक जटिल है। भविष्य बताएगा कि सैन्य साझेदारी के लिए सहमति, जिसमें प्रतिबंधात्मक प्रावधान हैं, क्या समुदाय को आश्वस्त कर सकेगी और विश्वास कायम रखेगी। किसी भी हालत में, नीति के केंद्र में नैतिकता अब पूरी तरह से आ गई है।

यह मोड़ सार्वजनिक प्राधिकारी, निजी क्षेत्र के खिलाड़ी, और सिविल सोसायटी के बीच एक समृद्ध संवाद का मार्ग भी खोलता है। सैन्य AI के उपयोग के लिए अंतरराष्ट्रीय नियम बनाने का दबाव लोकप्रिय प्रतिक्रियाओं के साथ बढ़ रहा है। बाजार अब इस नैतिक आयाम को नजरअंदाज नहीं कर सकता, नहीं तो अपने उपयोगकर्ता आधार में स्थायी विभाजन का खतरा रहेगा।

कृत्रिम बुद्धिमत्ता, केवल एक उपकरण नहीं, बल्कि एक प्रणाली है जिसका हर तकनीकी विकास महत्वपूर्ण सामाजिक जिम्मेदारियों को जन्म देता है, जिसके लिए समझदारी से और सामूहिक सहमति आवश्यक है।

रणनीतिक क्षेत्रों में AI के नैतिक और जिम्मेदार समावेशन के लिए मार्ग

प्रौद्योगिकी नवाचार और नैतिक आवश्यकताओं के बीच संतुलन सुनिश्चित करने के लिए कई उपाय अपनाए जा सकते हैं:

- सैन्य क्षेत्र में AI के उपयोग के लिए सख्त अंतरराष्ट्रीय मानक स्थापित करना, खासकर स्वायत्त हथियारों और निगरानी के संदर्भ में।

- कंपनियों और प्रशासनों के बीच अनुबंधों तथा उपयोग के उद्देश्यों की पारदर्शिता को बढ़ावा देना।

- आख़िरी उपयोगकर्ताओं को नैतिक चर्चा में शामिल करना, परामर्श और सक्रिय सूचना के जरिए।

- तीसरे पक्ष के ऑडिट प्रणालियों का विकास, जिससे प्रतिबद्धताओं के पालन की पुष्टि हो सके।

- शोधकर्ता, नियामक और उद्योग के बीच साझेदारी को प्रोत्साहित करना, ताकि विकास और नियंत्रण संतुलित रहे।

- स्पष्ट संचार अपनाना, अस्पष्टताओं से बचने और विश्वास बनाए रखने के लिए।

सैन्य AI के जोखिमों, मुद्दों और संभावित समाधानों का एक सारणीबद्ध सारांश यहां प्रस्तुत है:

| जोखिम | मुद्दे | संभावित समाधान |

|---|---|---|

| अनियंत्रित स्वायत्त हथियार | वैश्विक सुरक्षा, अंतरराष्ट्रीय स्थिरता | संधियाँ बनाना, स्पष्ट प्रतिबंध |

| व्यापक और आक्रामक निगरानी | नागरिक अधिकारों का सम्मान, व्यक्तिगत गोपनीयता | कड़ी कानूनी व्यवस्था, लोकतांत्रिक नियंत्रण |

| उपयोगकर्ताओं का विश्वास खोना | सामाजिक और व्यावसायिक स्वीकार्यता | पारदर्शिता, संवाद, शिक्षण |

| गैरकानूनी उद्देश्यों के लिए उपयोग | नैतिकता और वैधता | स्वतंत्र ऑडिट, दंड |

OpenAI, Anthropic और AI सैन्यीकरण विवाद पर सामान्य प्रश्न

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Anthropic ने अपने AI के सैन्यीकरण से इंकार क्यों किया?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Anthropic ने पेंटागन द्वारा अपने AI के सैन्यीकरण का विरोध किया क्योंकि जन निगरानी रोकने और स्वायत्त हथियारों के नियंत्रण के लिए पर्याप्त गारंटियां नहीं थीं। कंपनी केवल सुरक्षा और संरक्षण सुनिश्चित करने वाले कड़े सुरक्षा उपायों के अंतर्गत ही प्रतिबद्धता को प्राथमिकता देती है।”}},{“@type”:”Question”,”name”:”OpenAI का दावा है कि उसने सैन्य साझेदारी में कौन-कौन से गारंटी हासिल की हैं?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”OpenAI का दावा है कि उसका समझौता जन निगरानी और पूरी तरह स्वायत्त हथियारों से संबंधित उपयोगों को बाहर करता है तथा सैन्य उपयोग को केवल वैध उद्देश्यों तक सीमित रखने वाला एक नियंत्रण प्रणाली और कानूनी ढांचा प्रदान करता है।”}},{“@type”:”Question”,”name”:”OpenAI – युद्ध विभाग की साझेदारी का आम जनता पर क्या प्रभाव पड़ा है?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”इस साझेदारी ने ‘Cancel ChatGPT’ आंदोलन को जन्म दिया जहां उपयोगकर्ताओं ने अधिक नैतिक विकल्पों की ओर रुख किया, जिससे AI के सैन्य उपयोग को लेकर एक नैतिक बहस केंद्रित हुई।”}},{“@type”:”Question”,”name”:”क्या Anthropic के Claude ने सैन्यीकरण से इंकार के कारण लाभ उठाया?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”हाँ, Claude ने ऐप स्टोर जैसे प्लेटफार्मों पर उच्च रैंकिंग हासिल कर एक अधिक नैतिक AI के रूप में अपनी छवि के कारण उपयोगकर्ताओं के निर्णयों में नैतिक कारक के महत्व को दिखाया।”}},{“@type”:”Question”,”name”:”AI के सैन्यीकरण के लिए भविष्य के प्रमुख मुद्दे क्या हैं?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”भविष्य के मुद्दे में अंतरराष्ट्रीय मानकों की स्थापना, साझेदारी की पारदर्शिता, नैतिक चर्चाओं में उपयोगकर्ता भागीदारी, और दुरुपयोग को रोकने और विश्वास बनाए रखने के लिए ऑडिट प्रणालियों का विकास शामिल है।”}}]}Anthropic ने अपने AI के सैन्यीकरण से इंकार क्यों किया?

Anthropic ने पेंटागन द्वारा अपने AI के सैन्यीकरण का विरोध किया क्योंकि जन निगरानी रोकने और स्वायत्त हथियारों के नियंत्रण के लिए पर्याप्त गारंटियां नहीं थीं। कंपनी केवल सुरक्षा और संरक्षण सुनिश्चित करने वाले कड़े सुरक्षा उपायों के अंतर्गत ही प्रतिबद्धता को प्राथमिकता देती है।

OpenAI का दावा है कि उसने सैन्य साझेदारी में कौन-कौन से गारंटी हासिल की हैं?

OpenAI का दावा है कि उसका समझौता जन निगरानी और पूरी तरह स्वायत्त हथियारों से संबंधित उपयोगों को बाहर करता है तथा सैन्य उपयोग को केवल वैध उद्देश्यों तक सीमित रखने वाला एक नियंत्रण प्रणाली और कानूनी ढांचा प्रदान करता है।

OpenAI – युद्ध विभाग की साझेदारी का आम जनता पर क्या प्रभाव पड़ा है?

इस साझेदारी ने ‘Cancel ChatGPT’ आंदोलन को जन्म दिया जहां उपयोगकर्ताओं ने अधिक नैतिक विकल्पों की ओर रुख किया, जिससे AI के सैन्य उपयोग को लेकर एक नैतिक बहस केंद्रित हुई।

क्या Anthropic के Claude ने सैन्यीकरण से इंकार के कारण लाभ उठाया?

हाँ, Claude ने ऐप स्टोर जैसे प्लेटफार्मों पर उच्च रैंकिंग हासिल कर एक अधिक नैतिक AI के रूप में अपनी छवि के कारण उपयोगकर्ताओं के निर्णयों में नैतिक कारक के महत्व को दिखाया।

AI के सैन्यीकरण के लिए भविष्य के प्रमुख मुद्दे क्या हैं?

भविष्य के मुद्दे में अंतरराष्ट्रीय मानकों की स्थापना, साझेदारी की पारदर्शिता, नैतिक चर्चाओं में उपयोगकर्ता भागीदारी, और दुरुपयोग को रोकने और विश्वास बनाए रखने के लिए ऑडिट प्रणालियों का विकास शामिल है।