Dalam konteks saat ini yang ditandai dengan adopsi cepat dan luas kecerdasan buatan di perusahaan-perusahaan Prancis, manfaatnya tak terbantahkan: peningkatan produktivitas, percepatan transformasi digital, dan otomatisasi banyak tugas. Namun, perkembangan ini disertai dengan risiko signifikan, yang terkadang tidak dikenal atau diremehkan, yang dapat melemahkan keamanan, kerahasiaan, dan bahkan keberlangsungan organisasi. Direktorat Jenderal Keamanan Dalam Negeri (DGSI) baru-baru ini menerbitkan Flash intervensi yang menyoroti kerentanan ini melalui tiga kasus nyata yang dialami oleh perusahaan-perusahaan Prancis, yang mengungkap bahaya yang mengintai ketika alat kecerdasan buatan yang digunakan tidak dikuasai sepenuhnya.

Contoh-contoh ini menunjukkan berbagai sisi tantangan teknologi dan organisasi: di satu sisi, manipulasi data sensitif melalui alat eksternal yang tidak dikontrol, di sisi lain, kepercayaan berlebihan pada sistem pengambilan keputusan otomatis, dan terakhir, meningkatnya serangan canggih yang menggunakan teknologi deepfake. Artikel ini menyelami ketiga ilustrasi konkret ini untuk menggali isu utama yang dihadapi perusahaan-perusahaan Prancis dalam eksplorasi dan penggunaan kecerdasan buatan, membahas risiko etis, bias algoritmik, masalah perlindungan data, dan keharusan keamanan siber. Ini juga akan mengevaluasi bagaimana regulasi kecerdasan buatan yang tepat, dipadukan dengan tata kelola yang ketat, dapat mencegah kesalahan mahal dan melindungi integritas struktur ekonomi nasional.

- 1 Pemanfaatan kecerdasan buatan generatif yang tidak tepat: contoh mengkhawatirkan bagi perusahaan-perusahaan Prancis

- 2 Bahaya ketergantungan pada kecerdasan buatan untuk pengambilan keputusan strategis di perusahaan-perusahaan Prancis

- 3 Penipuan canggih dengan deepfake, ancaman yang berkembang bagi perusahaan-perusahaan Prancis

- 4 Rekomendasi utama untuk mengatur penggunaan kecerdasan buatan di perusahaan-perusahaan Prancis

- 5 Statistik dan dampak ekonomi kecerdasan buatan di perusahaan-perusahaan Prancis

- 6 Risiko etis dan bias algoritmik: tantangan bagi perusahaan-perusahaan Prancis terhadap kecerdasan buatan

- 7 Transformasi digital dan tantangan perlindungan data di perusahaan-perusahaan Prancis

- 8 Pendekatan strategis untuk integrasi kecerdasan buatan yang sukses di perusahaan-perusahaan Prancis

Pemanfaatan kecerdasan buatan generatif yang tidak tepat: contoh mengkhawatirkan bagi perusahaan-perusahaan Prancis

Kasus pertama yang diangkat oleh DGSI berkaitan dengan sebuah perusahaan strategis yang menggunakan alat kecerdasan buatan generatif publik, yang dikembangkan di luar negeri, untuk penerjemahan dokumen internal yang sensitif. Penggunaan alat ini diadopsi secara spontan oleh beberapa karyawan, yang terpesona oleh efisiensi dan kecepatan yang ditawarkan dalam pengelolaan konten sehari-hari. Praktik ini, dimulai tanpa validasi hirarkis atau kontrol sebelumnya, dengan cepat menunjukkan keterbatasannya ketika departemen TI mendeteksi kebocoran potensial melalui audit internal.

Pemanfaatan layanan gratis atau internasional menimbulkan bahaya khusus, sebab data yang dimasukkan dapat digunakan untuk melatih model kecerdasan buatan di latar belakang, sering kali tanpa pemberitahuan eksplisit kepada pengguna. Fenomena ini menimbulkan ancaman besar terhadap kerahasiaan informasi, terutama ketika server perusahaan-perusahaan ini berada di luar wilayah Prancis bahkan Eropa, sehingga data tersebut terkena regulasi asing yang kadang-kadang lebih longgar.

Menanggapi temuan ini, perusahaan menghentikan penggunaan layanan tersebut dan beralih ke solusi internal berbayar yang menawarkan lingkungan aman sesuai dengan standar nasional. Selain itu, kelompok kerja khusus dibentuk untuk menyusun doktrin penggunaan alat kecerdasan buatan yang ketat. Langkah ini menggambarkan kebutuhan penting bagi perusahaan untuk mengatur pemanfaatan teknologi canggih guna menghindari celah keamanan. Memang, ancaman yang terkait dengan interkoneksi dengan antarmuka eksternal atau plugin yang tidak dikontrol meningkatkan vektor serangan dan kerentanan terhadap infiltrasi.

Melihat keseluruhan contoh pertama ini, menjadi jelas bahwa godaan untuk menggunakan alat yang sederhana dan gratis dapat menyembunyikan risiko besar. Bagi semua perusahaan Prancis yang terlibat dalam transformasi digital, sangat penting untuk mengadopsi kebijakan keamanan siber yang proaktif dan mengintegrasikan perlindungan data dalam kriteria evaluasi alat kecerdasan buatan sejak tahap awal.

Bahaya ketergantungan pada kecerdasan buatan untuk pengambilan keputusan strategis di perusahaan-perusahaan Prancis

Kasus kedua yang dibahas oleh layanan intelijen menggambarkan skenario di mana sebuah perusahaan Prancis yang sedang berkembang secara internasional telah mengalihdayakan sebagian penting proses pengambilan keputusannya, yaitu due diligence, kepada sistem kecerdasan buatan yang dirancang di luar negeri. Tujuan dari pendekatan ini adalah untuk memperoleh kecepatan dan efisiensi dalam mengevaluasi mitra bisnis potensial di pasar yang belum dikenal.

Dalam jangka pendek, otomatisasi ini terbukti menarik karena menghasilkan laporan yang rinci dan instan. Namun, karena volume pekerjaan dan kurangnya sumber daya manusia yang khusus untuk memverifikasi hasil, tim-tim cenderung menerima hasil yang diberikan secara membabi buta tanpa validasi ahli tambahan. Padahal, sistem algoritmik ini memberikan jawaban probabilistik, yang merupakan jawaban yang secara statistik paling mungkin dibandingkan jawaban yang bebas bias atau tepat sesuai konteks.

Bias algoritmik, yang diperkenalkan sejak desain model atau melalui data pelatihan, dapat mengarahkan hasil secara keliru. Selain itu, fenomena yang dikenal sebagai “halusinasi” – yang menghasilkan informasi yang salah, tidak tepat, atau dibuat-buat – membahayakan keandalan alat ini. Fenomena ini memperbesar risiko pengambilan keputusan strategis yang didasarkan pada analisis yang bias, yang dapat menyebabkan kerugian komersial, konflik kontraktual, atau hilangnya kepercayaan.

Contoh ini dengan jelas menunjukkan kebutuhan penting untuk memasukkan kontrol manusia ahli dalam siklus pengambilan keputusan, misalnya dengan menunjuk referen kecerdasan buatan yang bertugas untuk merumuskan ulang, memeriksa, dan menyeimbangkan rekomendasi yang dihasilkan oleh mesin ini. Kehati-hatian manusia tetap menjadi pengaman yang tak tergantikan terhadap penyempitan keragaman pemikiran dan keputusan otomatis yang terlepas dari konteks nyata perusahaan-perusahaan Prancis.

Kasus ini juga mengilustrasikan tantangan teknologi besar lainnya: bagaimana menggabungkan optimasi yang dibawa oleh otomatisasi dan transformasi digital dengan pemeliharaan kontrol strategis yang ketat? Program pelatihan dan peningkatan kesadaran terhadap risiko yang melekat pada penggunaan kecerdasan buatan menjadi penting untuk menjaga kelincahan dan ketahanan perusahaan di pasar internasional yang kompetitif.

Penipuan canggih dengan deepfake, ancaman yang berkembang bagi perusahaan-perusahaan Prancis

Kasus ketiga yang diungkap oleh DGSI mengungkap percobaan penipuan yang sangat canggih menggunakan teknologi deepfake. Seorang manajer di sebuah situs industri menerima panggilan video dari seseorang yang meniru tampilan dan suara pemimpin grup secara sempurna, yang meminta transfer dana dalam konteks proyek akuisisi. Penipuan ini hanya terdeteksi berkat kewaspadaan dan insting sang manajer, yang segera memutus komunikasi dan memberi tahu manajemen.

Teknologi manipulasi audio dan video memang telah menjadi sangat meyakinkan. Antara 2023 dan 2025, volume konten deepfake di internet meningkat lebih dari sepuluh kali lipat, dan jutaan video, gambar, atau rekaman ini beredar setiap hari. Perkembangan ini juga mengalami akselerasi yang spektakuler karena popularitas alat kecerdasan buatan generatif dan teknik sintesis suara.

Serangan-serangan ini seringkali didasarkan pada pengumpulan dan analisis data publik dan pribadi sebuah perusahaan secara teliti untuk mempersonalisasi pesan palsu, sehingga memperkuat kredibilitas dan potensi manipulasi mereka. Hampir setengah dari perusahaan mengaku pernah menjadi target upaya seperti ini, menunjukkan besarnya masalah di lanskap Prancis. Sektor industri, dengan risiko ekonomi yang besar, sangat rentan.

Oleh karena itu, sangat penting bagi perusahaan-perusahaan Prancis untuk menerapkan perangkat keamanan siber yang sesuai: pelatihan karyawan dalam mengenali deepfake, penerapan protokol verifikasi ketat saat ada permintaan keuangan, dan penggunaan solusi teknologi yang mampu mendeteksi konten palsu. Langkah-langkah ini harus benar-benar mendampingi transformasi digital agar inovasi ini tidak menjadi sarana penipuan dan disinformasi.

Rekomendasi utama untuk mengatur penggunaan kecerdasan buatan di perusahaan-perusahaan Prancis

DGSI menekankan pentingnya pengaturan ketat untuk menghindari bahaya yang telah diidentifikasi, sekaligus mendorong adopsi kecerdasan buatan dan berbagai manfaatnya. Imperatif pertama adalah definisi yang jelas tentang kebijakan internal yang mengatur penggunaan dan jenis data yang dapat diproses melalui alat kecerdasan buatan.

Perusahaan-perusahaan Prancis didorong untuk lebih memilih solusi lokal atau Eropa guna membatasi risiko terkait kedaulatan data dan perlindungan hukum. Selain itu, pelatihan berkelanjutan bagi karyawan menjadi pilar utama lainnya, memungkinkan mereka memahami isu-, mengidentifikasi risiko, dan mengadopsi perilaku sesuai aturan.

DGSI juga merekomendasikan penerapan mekanisme transparansi internal, terutama melalui saluran pelaporan untuk setiap insiden mencurigakan, serta pengkajian rutin praktik yang berhubungan dengan kecerdasan buatan. Integrasi validasi manusia yang khusus harus menjadi sistematik, terutama untuk keputusan strategis atau sensitif.

Terakhir, kolaborasi antara aktor publik dan swasta, termasuk otoritas pengatur kecerdasan buatan, sangat penting untuk mendefinisikan kerangka kerja yang jelas dan dapat berkembang, yang mampu mendukung perubahan teknologi tanpa mengorbankan nilai-nilai etis dan keamanan perusahaan-perusahaan Prancis.

- Mendefinisikan kebijakan internal yang jelas tentang penggunaan kecerdasan buatan

- Memprioritaskan solusi lokal atau Eropa

- Melatih karyawan secara rutin

- Menerapkan saluran pelaporan insiden

- Menjamin validasi manusia yang sistematik untuk keputusan kritis

- Menjamin transparansi dan peninjauan rutin praktik

- Berkolaborasi dengan otoritas untuk kerangka regulasi yang sesuai

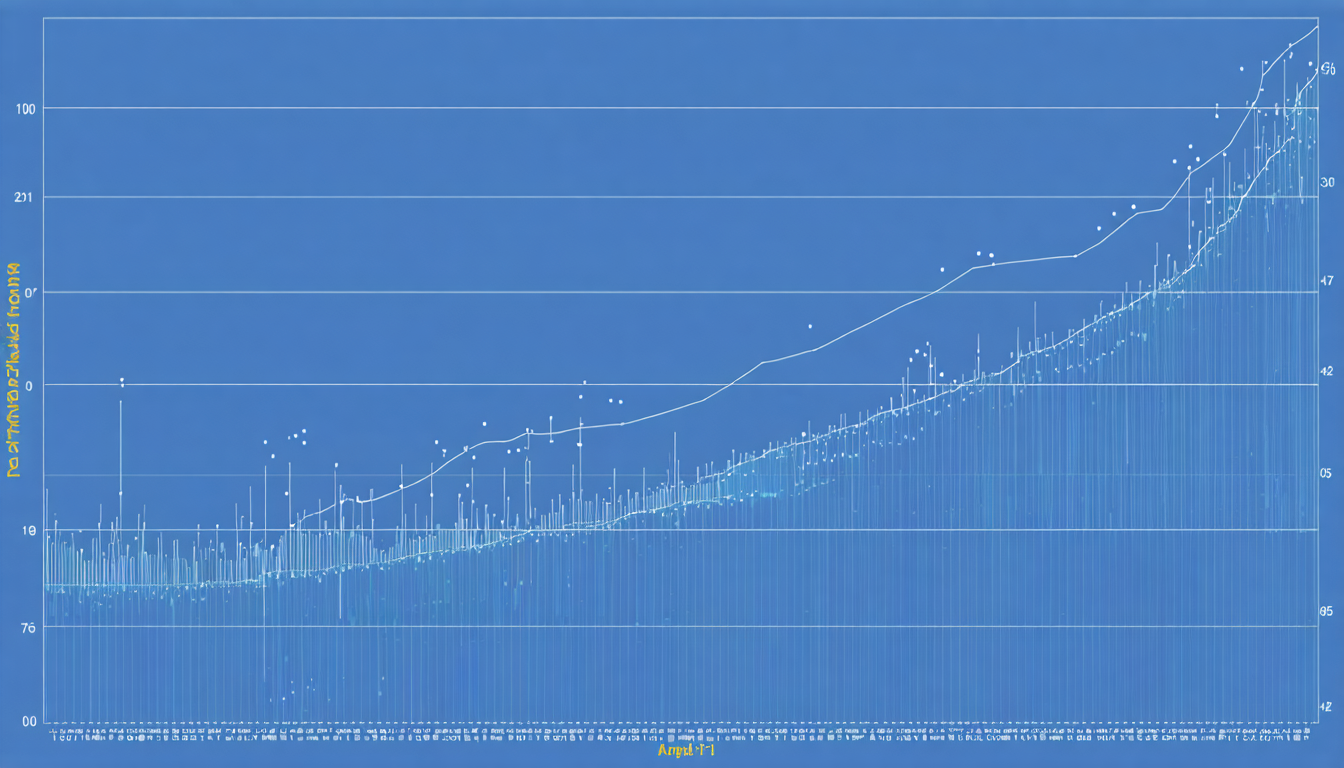

Statistik dan dampak ekonomi kecerdasan buatan di perusahaan-perusahaan Prancis

Angka-angka mengungkapkan pemandangan yang beragam antara manfaat ekonomi dan potensi kerentanan. Hampir 78% perusahaan global sudah mengintegrasikan kecerdasan buatan setidaknya dalam satu fungsinya. Di Prancis, tren ini terus meningkat, terutama berkat transformasi digital yang didorong di berbagai sektor.

Berdasarkan beberapa studi, peningkatan produktivitas terkait kecerdasan buatan dapat mencapai tingkat hingga 55%. Rata-rata keuntungan finansial diperkirakan sekitar 3,70 dolar yang dihasilkan per dolar yang diinvestasikan. Prospek ekonomi ini menarik bagi pemimpin perusahaan, meskipun terkadang menyembunyikan risiko inheren, khususnya dalam hal keamanan siber dan perlindungan privasi.

Tabel ini merangkum beberapa indikator utama:

| Indikator | Nilai | Komentar |

|---|---|---|

| Tingkat adopsi kecerdasan buatan di perusahaan (Prancis) | 70% | Pesat meningkat sejak 2023 |

| Kenaikan produktivitas terkait kecerdasan buatan | Hingga 55% | Variasi menurut sektor dan penggunaan |

| Pengembalian finansial rata-rata | 3,70 $ per dolar yang diinvestasikan | Keuntungan signifikan dibanding investasi tradisional |

| Perusahaan tanpa kebijakan kecerdasan buatan formal | 1/3 | Kekurangan tata kelola yang meningkatkan risiko |

| Perusahaan yang menjadi target deepfake | 46% | Penyebaran cepat ancaman ini |

Risiko etis dan bias algoritmik: tantangan bagi perusahaan-perusahaan Prancis terhadap kecerdasan buatan

Selain masalah keamanan dan perlindungan data, perusahaan-perusahaan Prancis menghadapi tantangan mendasar terkait bias algoritmik. Bias ini muncul ketika data yang digunakan untuk melatih model hanya sebagian representatif atau ketika prasangka implisit tertanam dalam program. Hal ini dapat menyebabkan diskriminasi, menyesatkan hasil analisis, atau mengganggu pengambilan keputusan otomatis.

Risiko etis yang terkait dengan bias ini sangat penting, khususnya bagi perusahaan yang bergerak di sektor sensitif seperti keuangan, kesehatan, atau sumber daya manusia. Misalnya, kecerdasan buatan yang bias dapat secara tidak adil mempengaruhi keputusan perekrutan, merugikan profil pelanggan tertentu, atau mendukung pilihan komersial yang dipertanyakan.

Untuk menghadapi tantangan ini, perusahaan harus menerapkan audit algoritma secara berkala, melakukan tes kepatuhan etis, dan memperkuat keberagaman tim pengembang untuk mengurangi blind spot. Kesadaran para pengambil keputusan terhadap risiko ini dan integrasi mekanisme korektif juga sangat penting.

Terakhir, regulasi kecerdasan buatan di tingkat Eropa sekarang menetapkan persyaratan ketat terkait evaluasi bias dan transparansi, yang mengharuskan perusahaan-perusahaan Prancis mematuhi standar ini atau menghadapi sanksi hukum dan dampak negatif terhadap citra mereka.

Langkah praktis untuk mengurangi bias algoritmik

- Melakukan audit independen pada model yang digunakan

- Melibatkan ahli multidisipliner dalam pengembangan algoritma

- Menggunakan dataset yang representatif dan beragam

- Menerapkan mekanisme penjelasan terhadap keputusan algoritmik

- Melatih tim mengenai risiko etis terkait kecerdasan buatan

Transformasi digital dan tantangan perlindungan data di perusahaan-perusahaan Prancis

Transformasi digital, yang dipercepat oleh penggunaan intensif kecerdasan buatan, menuntut penguatan kebijakan perlindungan data. Dalam konteks ini, perusahaan-perusahaan Prancis harus mematuhi tidak hanya standar Eropa seperti GDPR, tetapi juga mengantisipasi persyaratan khusus terkait kerahasiaan dan integritas data yang diproses oleh sistem kecerdasan buatan.

Manipulasi data sensitif melalui antarmuka otomatis dapat memperburuk risiko kebocoran dan penyalahgunaan. Oleh karena itu, kebijakan siber yang diperkuat harus menggabungkan pemanfaatan alat teknis dan tata kelola yang ketat, termasuk pendefinisian peran yang jelas dan pertanggungjawaban para pelaku.

Keamanan data juga bergantung pada pengendalian aliran data ke luar. Perusahaan-perusahaan Prancis didorong untuk membatasi pertukaran dengan platform eksternal yang tidak bersertifikasi atau yang berlokasi di luar Uni Eropa, dengan memprioritaskan solusi kedaulatan yang menjamin kontrol lebih besar atas data. Pendekatan ini ikut berkontribusi untuk menjaga kepercayaan pelanggan dan mitra, faktor kunci dalam memperkuat hubungan bisnis jangka panjang.

Pendekatan strategis untuk integrasi kecerdasan buatan yang sukses di perusahaan-perusahaan Prancis

Akhirnya, untuk memaksimalkan peluang keberhasilan transformasi digital dan meminimalkan risiko, perusahaan-perusahaan Prancis harus mengadopsi pendekatan strategis yang menyeluruh dan terpadu. Pendekatan ini tidak hanya menggerakkan teknologi kecerdasan buatan, tetapi juga pelatihan tim, revisi proses bisnis, serta penerapan pengelolaan keamanan dan kepatuhan.

Tata kelola kecerdasan buatan yang sesuai mencakup penunjukan penanggung jawab khusus, penerapan kode etik, dan kolaborasi erat dengan otoritas regulasi. Kerangka ini juga harus mendorong inovasi seraya memastikan penggunaan yang bertanggung jawab dan transparan.

Kisah tiga perusahaan ini menggambarkan bahwa inovasi harus disertai kewaspadaan. Pengembangan kompetensi internal, peningkatan kesadaran terhadap risiko, dan transparansi praktik yang diizinkan menjamin keseimbangan antara eksploitasi potensi kecerdasan buatan dan pengendalian bahaya yang melekat.