वर्तमान संदर्भ में, जहां फ्रांसीसी कंपनियों में कृत्रिम बुद्धिमत्ता को तेजी से और व्यापक रूप से अपनाया जा रहा है, उसके लाभ निर्विवाद हैं: उत्पादकता में सुधार, डिजिटल परिवर्तन की तेज़ी, और कई कार्यों का स्वचालन। फिर भी, इस विकास के साथ महत्वपूर्ण जोखिम जुड़े हैं, जो कभी-कभी अज्ञात या कम आंका जाता है, जो सुरक्षा, गोपनीयता और यहां तक कि संगठनों की स्थिरता को कमजोर कर सकते हैं। आंतरिक सुरक्षा निदेशालय (DGSI) ने हाल ही में एक फ्लैश इंटेरेन्स प्रकाशित किया है, जो फ्रांसीसी कंपनियों द्वारा अनुभव किए गए तीन वास्तविक मामलों के माध्यम से इन कमजोरियों को उजागर करता है, जो उन खतरों को दर्शाते हैं जो तब उत्पन्न होते हैं जब उपयोग किए जाने वाले एआई उपकरणों पर पूर्ण नियंत्रण न हो।

ये उदाहरण तकनीकी और संगठनात्मक चुनौतियों के विभिन्न पहलुओं को प्रदर्शित करते हैं: एक ओर, बाहरी अनियंत्रित उपकरणों के माध्यम से संवेदनशील डेटा का दुरुपयोग, दूसरी ओर, स्वायत्त निर्णय प्रणालियों पर अत्यधिक विश्वास, और अंत में, गहन नकली (deepfake) तकनीकों का उपयोग करते हुए परिष्कृत हमलों में वृद्धि। यह लेख फ्रांसीसी कंपनियों द्वारा एआई के अन्वेषण और उपयोग में सामना की जा रही प्रमुख चुनौतियों की गहराई से पड़ताल करता है, जिसमें नैतिक जोखिम, एल्गोरिदमिक पक्षपात, डेटा सुरक्षा की समस्याएं और सूचना सुरक्षा की आवश्यकताएं शामिल हैं। साथ ही यह भी मूल्यांकन करेगा कि उपयुक्त एआई विनियमन और कठोर शासन कैसे महंगे गलतियों को रोक सकते हैं और राष्ट्रीय आर्थिक संरचनाओं की अखंडता को सुरक्षित रख सकते हैं।

- 1 पीढ़ीगत एआई के अनुचित उपयोग: फ्रांसीसी कंपनियों के लिए एक चिंताजनक उदाहरण

- 2 फ्रांसीसी कंपनियों में रणनीतिक निर्णय लेने के लिए एआई पर अत्यधिक निर्भरता के खतरे

- 3 डीपफेक द्वारा परिष्कृत धोखाधड़ी: फ्रांसीसी कंपनियों के लिए बढ़ती धमकी

- 4 फ्रांसीसी कंपनियों में कृत्रिम बुद्धिमत्ता के उपयोग के नियंत्रण के लिए प्रमुख सिफारिशें

- 5 फ्रांसीसी कंपनियों में कृत्रिम बुद्धिमत्ता के आर्थिक आंकड़े और प्रभाव

- 6 नैतिक जोखिम और एल्गोरिदमिक पक्षपात: फ्रांसीसी कंपनियों के लिए एआई के सामने चुनौतियां

- 7 फ्रांसीसी कंपनियों में डिजिटल परिवर्तन और डेटा संरक्षण की चुनौतियां

- 8 फ्रांसीसी कंपनियों में एआई के सफल एकीकरण के लिए रणनीतिक दृष्टिकोण

पीढ़ीगत एआई के अनुचित उपयोग: फ्रांसीसी कंपनियों के लिए एक चिंताजनक उदाहरण

DGSI द्वारा उजागर पहला मामला एक रणनीतिक कंपनी से संबंधित है जो विदेशी विकसित सार्वजनिक जनरेटिव एआई उपकरण का उपयोग आंतरिक संवेदनशील दस्तावेजों के अनुवाद के लिए कर रही थी। इस उपकरण का उपयोग कुछ सहयोगियों द्वारा बिना उच्चाधिकृत अनुमोदन या पूर्व नियंत्रण के तात्कालिक रूप से अपनाया गया था, जो इसके दैनिक सामग्री प्रबंधन में दक्षता और गति से प्रभावित थे। इस अभ्यास ने जल्द ही अपनी सीमाओं को उजागर किया जब आईटी विभाग ने एक संभावित डेटा लीक को आंतरिक ऑडिट के माध्यम से पहचाना।

मुफ्त या अंतरराष्ट्रीय सेवाओं का उपयोग विशेष खतरा उत्पन्न करता है, क्योंकि डाले गए डेटा का पीछे की पृष्ठभूमि में एआई मॉडल को प्रशिक्षित करने के लिए उपयोग किया जा सकता है, अक्सर उपयोगकर्ता को स्पष्ट रूप से सूचित किए बिना। यह घटना विशेष रूप से संवेदनशील जानकारी की गोपनीयता के लिए बड़ी चुनौती है, विशेष रूप से जब इन कंपनियों के सर्वर फ्रांस या यूरोप के बाहर हों, जिससे ये डेटा विदेशी कानूनों के अधीन हो जाते हैं जो कभी-कभी कम कड़े होते हैं।

इस स्थिति के प्रकाश में, कंपनी ने इस सेवा का उपयोग बंद कर दिया और एक सुरक्षित, राष्ट्रीय मानकों के अनुरूप आंतरिक और सशुल्क समाधान अपनाया। इसके अतिरिक्त, एक विशेष कार्य समूह बनाया गया ताकि एआई उपकरणों के उपयोग हेतु कड़ाई से पालन की जाने वाली नीति विकसित की जा सके। यह पहल यह दर्शाती है कि कंपनियों के लिए उन्नत तकनीकों के उपयोग को संरचित करने की अत्यंत आवश्यकता है ताकि सुरक्षा खामियों से बचा जा सके। दरअसल, बाहरी इंटरफेस या अनियंत्रित प्लगइन्स के साथ संयोजन से हमले के वेक्टर और घुसपैठ के जोखिम बढ़ जाते हैं।

इस पहले उदाहरण को देखते हुए यह स्पष्ट होता है कि सरल और मुफ्त उपकरणों का उपयोग करने की इच्छा गंभीर जोखिम छिपा सकती है। फ्रांसीसी कंपनियों के लिए जो डिजिटल परिवर्तन में शामिल हैं, यह आवश्यक है कि वे एक सक्रिय सूचना सुरक्षा नीति अपनाएं और एआई उपकरणों के मूल्यांकन में डेटा सुरक्षा को प्रारंभिक चरणों से सम्मिलित करें।

फ्रांसीसी कंपनियों में रणनीतिक निर्णय लेने के लिए एआई पर अत्यधिक निर्भरता के खतरे

सेवा एजेंसियों द्वारा उजागर दूसरा मामला एक फ्रांसीसी कंपनी का है जो अंतर्राष्ट्रीय विस्तार के दौर में थी और जिसने अपनी एक महत्वपूर्ण निर्णय प्रक्रिया, ‘द्यू डिलिजेंस’, को विदेशी विकसित एआई प्रणाली पर आउटसोर्स किया था। इस पहल का उद्देश्य अज्ञात बाजारों में संभावित व्यावसायिक साझेदारों के मूल्यांकन में तेजी और दक्षता प्राप्त करना था।

शॉर्ट टर्म में, यह स्वचालन आकर्षक साबित हुआ क्योंकि इसका उपयोग करके विस्तृत और तुरंत रिपोर्ट्स उत्पन्न होती थीं। हालांकि, कार्यभार की मात्रा और विशेषज्ञ मानव संसाधनों की कमी के कारण, टीमें प्रायः प्रदत्त परिणामों को बिना किसी अतिरिक्त विशेषज्ञ सत्यापन के अंध विश्वास के साथ स्वीकार करती हैं। लेकिन ये एल्गोरिदमिक सिस्टम संभाव्य प्रतिक्रियाएँ प्रदान करते हैं, जो सबसे संभावित सांख्यिकीय उत्तर होते हैं, न कि बिना पक्षपात या पूरी तरह संदर्भानुकूल उत्तर।

एल्गोरिदमिक पक्षपात, जो मॉडल की डिजाइन या प्रशिक्षण डेटा के दौरान शामिल हो सकते हैं, परिणामों को गलत दिशा में प्रभावित कर सकते हैं। इसके अलावा, प्रसिद्ध “हैलुसिनेशन” की समस्या – जो गलत, अस्पष्ट या आविष्कृत सूचनाएं उत्पन्न करती है – इन उपकरणों की विश्वसनीयता को खतरे में डालती है। यह घटना पक्षपातपूर्ण विश्लेषणों पर आधारित रणनीतिक निर्णय लेने के जोखिम को बढ़ाती है, जो व्यावसायिक हानि, संविदात्मक विवाद या विश्वासघात की स्थिति पैदा कर सकती है।

यह उदाहरण दिखाता है कि निर्णय कम्पनियों में इंसानी विशेषज्ञता का समावेश आवश्यक है, जैसे कि एआई संदर्भकों को नियुक्त करना जो मशीनों द्वारा उत्पन्न सिफारिशों को पुनः स्वरूपित, सत्यापित और संतुलित कर सकें। मानवीय सतर्कता विविधता के नुकसान और स्वचालित निर्णयों के असंगत संदर्भ के खिलाफ अवश्यंभावी सुरक्षात्मक उपाय है।

यह मामला एक अन्य महत्वपूर्ण तकनीकी चुनौती को भी दर्शाता है: कैसे ऑटोमेशन और डिजिटल परिवर्तन से प्राप्त अनुकूलन को बनाए रखते हुए रणनीतिक नियंत्रण कड़ा रखा जा सकता है? एआई उपयोग में अंतर्निहित जोखिमों के प्रति प्रशिक्षण कार्यक्रम और जागरूकता आवश्यक हैं ताकि प्रतिस्पर्धात्मक वैश्विक बाजार में कंपनियों की चुस्ती और लचीलापन बनी रहे।

डीपफेक द्वारा परिष्कृत धोखाधड़ी: फ्रांसीसी कंपनियों के लिए बढ़ती धमकी

DGSI द्वारा उल्लिखित तीसरा मामला गहन नकली (deepfake) तकनीक के उपयोग से संबंधित एक अत्यंत परिष्कृत धोखाधड़ी प्रयास को प्रकट करता है। एक औद्योगिक साइट के प्रभारी को एक वीडियो कॉल प्राप्त हुआ जिसमें बातचीत करने वाला व्यक्ति समूह के प्रमुख की आवाज़ और स्वरूप की हूबहू नकल करता था और अधिग्रहण परियोजना के अंतर्गत एक वित्तीय ट्रांसफर का अनुरोध कर रहा था। यह छल तब ही पकड़ा गया जब प्रभारी की सतर्कता और अंतर्दृष्टि ने संवाद को जल्दी समाप्त कर दिया और प्रबंधन को सूचित किया।

ऑडियो और वीडियो मैनिपुलेशन तकनीकें अत्यंत विश्वसनीय बन गई हैं। 2023 से 2025 के बीच इंटरनेट पर डीपफेक सामग्री की मात्रा दस गुना से अधिक बढ़ी है, और रोजाना कई मिलियन वीडियो, छवियाँ या रिकॉर्डिंग प्रसारित होती हैं। इस वृद्धि का त्वरित विकास एआई जनरेटिव उपकरणों और आवाज संश्लेषण तकनीकों के लोकप्रिय होने के कारण भी हुआ है।

ये हमले अक्सर किसी कंपनी के सार्वजनिक और निजी डेटा की सावधानीपूर्वक संग्रह और विश्लेषण पर आधारित होते हैं ताकि धोखाधड़ी संदेशों को व्यक्तिगत बनाया जा सके, जिससे उनकी विश्वसनीयता और प्रभावशीलता बढ़ती है। लगभग आधी कंपनियों का कहना है कि वे इस तरह के प्रयासों के निशाने पर आ चुकी हैं, जो फ्रांसीसी परिदृश्य में समस्या की गंभीरता को दर्शाता है। औद्योगिक क्षेत्र, अपने महत्वपूर्ण आर्थिक महत्व के कारण, विशेष रूप से संवेदनशील है।

इसलिए, फ्रांसीसी कंपनियों के लिए यह महत्वपूर्ण है कि वे उपयुक्त सूचना सुरक्षा उपाय लागू करें: कर्मचारियों को डीपफेक की पहचान के लिए प्रशिक्षित करना, वित्तीय अनुरोधों के दौरान सख्त सत्यापन प्रोटोकॉल लागू करना, और जाली सामग्री की पहचान करने वाली तकनीकी समाधानों का उपयोग करना। ये कदम डिजिटल परिवर्तन के साथ पूरी तरह एडजस्ट होने चाहिए ताकि ये नवाचार धोखाधड़ी और गलत सूचना के उपकरण न बनें।

फ्रांसीसी कंपनियों में कृत्रिम बुद्धिमत्ता के उपयोग के नियंत्रण के लिए प्रमुख सिफारिशें

DGSI की रिपोर्टें जोखिमों से बचने के लिए कड़े नियंत्रण की आवश्यकता पर जोर देती हैं, साथ ही एआई के उपयोग और उसके अनुप्रयोगों से संबंधित लाभों को बढ़ावा देती हैं। पहला अनिवार्य कदम एक स्पष्ट आंतरिक नीति निर्धारित करना है, जो एआई उपकरणों के उपयोग और डेटा के प्रकारों को नियंत्रित करती है।

फ्रांसीसी कंपनियों को स्थानीय या यूरोपीय समाधान अपनाने के लिए प्रोत्साहित किया जाता है ताकि डेटा संप्रभुता और कानूनी सुरक्षा के जोखिमों को सीमित किया जा सके। इसके अलावा, कर्मचारियों का निरंतर प्रशिक्षण एक और महत्वपूर्ण स्तंभ है, जो उन्हें जोखिमों को समझने, पहचानने और नियमों के अनुपालन वाली व्यवहारिकता अपनाने में सक्षम बनाता है।

DGSI आंतरिक पारदर्शिता उपायों की भी सिफारिश करता है, जैसे संदिग्ध घटनाओं की रिपोर्टिंग के लिए चैनल स्थापित करना, और एआई-सम्बंधित प्रथाओं की नियमित समीक्षा करना। विशेषकर रणनीतिक या संवेदनशील निर्णयों के लिए मानव जांच की प्रणालीगत समावेशीकरण अनिवार्य है।

अंत में, सार्वजनिक और निजी क्षेत्रों के बीच, जिसमें एआई नियामक प्राधिकरण भी शामिल हैं, सहयोग आवश्यक है ताकि एक स्पष्ट और विकसितशील ढांचा तैयार किया जा सके, जो तकनीकी परिवर्तनों का समर्थन करते हुए फ्रांसीसी कंपनियों के नैतिक और सुरक्षा मूल्य को सुरक्षित रख सके।

- एआई के उपयोग पर एक स्पष्ट आंतरिक नीति निर्धारित करें

- स्थानीय या यूरोपीय समाधान पसंद करें

- कर्मचारियों को नियमित रूप से प्रशिक्षित करें

- घटनाओं की रिपोर्टिंग के लिए एक चैनल स्थापित करें

- महत्वपूर्ण निर्णयों के लिए मानवीय सत्यापन सुनिश्चित करें

- प्रथाओं की पारदर्शिता और नियमित समीक्षा करें

- अनुचित नियामक ढांचे के लिए अधिकारियों के साथ सहयोग करें

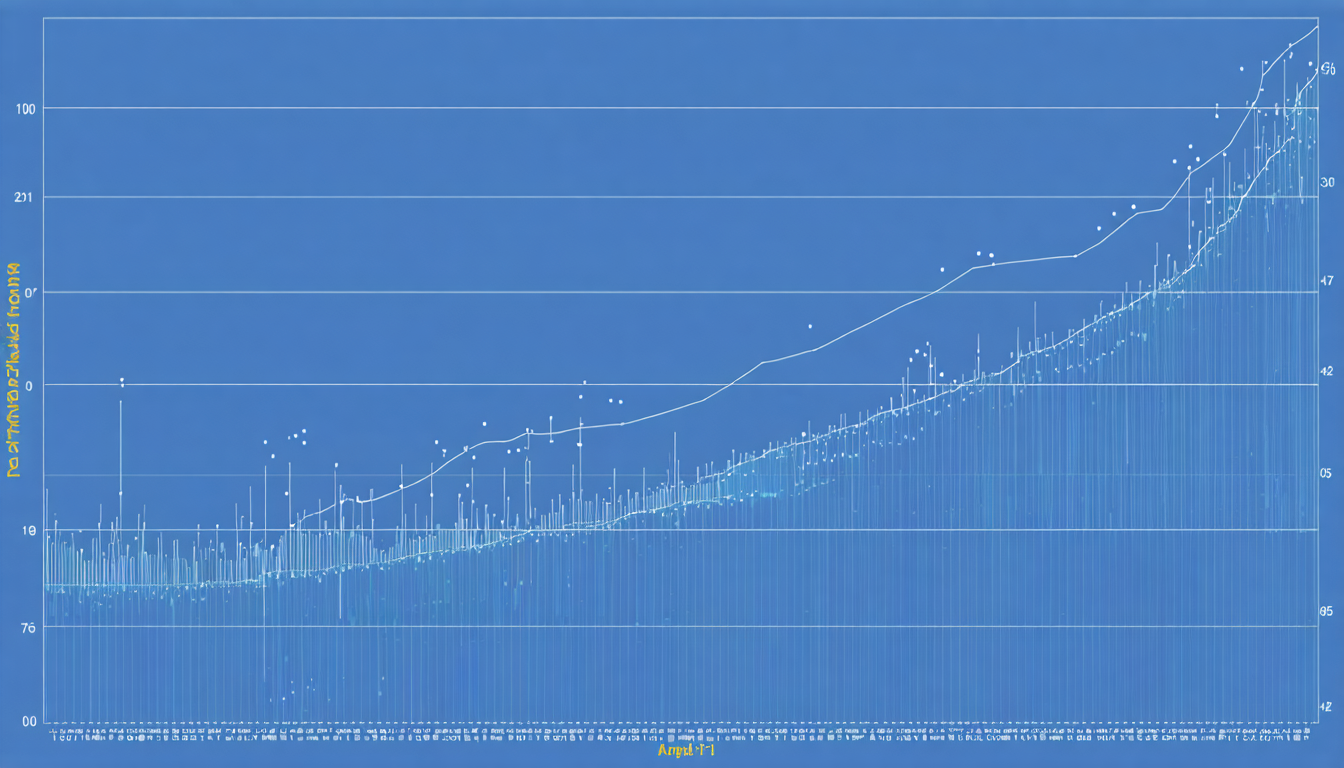

फ्रांसीसी कंपनियों में कृत्रिम बुद्धिमत्ता के आर्थिक आंकड़े और प्रभाव

आंकड़े आर्थिक लाभ और संभावित कमजोरियों के बीच एक मिश्रित तस्वीर प्रस्तुत करते हैं। लगभग 78% वैश्विक कंपनियां पहले ही अपने कम से कम एक कार्य में कृत्रिम बुद्धिमत्ता को शामिल कर चुकी हैं। फ्रांस में यह प्रवृत्ति लगातार बढ़ रही है, खासकर कई क्षेत्रों में डिजिटल परिवर्तन की वजह से।

कई अध्ययनों के अनुसार, एआई से जुड़ी उत्पादकता लाभ 55% तक पहुंच सकती है। औसत वित्तीय रिटर्न अनुमानित है लगभग 3.70 डॉलर प्रति निवेशित डॉलर। ये आर्थिक संभावनाएं नेताओं को आकर्षित करती हैं, लेकिन वे कभी-कभी सूचना सुरक्षा और निजता संरक्षण के अंतर्निहित जोखिमों को छिपा सकती हैं।

यह सारणी कुछ प्रमुख संकेतकों को संक्षेप में प्रस्तुत करती है:

| संकेतक | मूल्य | टिप्पणियाँ |

|---|---|---|

| कंपनियों में एआई अपनाने की दर (फ्रांस) | 70% | 2023 से भारी वृद्धि |

| एआई से संबंध उत्पादकता लाभ | 55% तक | क्षेत्र और उपयोग के अनुसार परिवर्तनशील |

| औसत वित्तीय वापसी | 3.70 $ प्रति निवेशित डॉलर | परंपरागत निवेशों की तुलना में महत्वपूण लाभ |

| जिन कंपनियों की कोई औपचारिक एआई नीति नहीं है | 1/3 | शासन की कमी से जोखिम बढ़ते हैं |

| डीपफेक के द्वारा लक्षित कंपनियां | 46% | इस खतरे का तीव्र प्रसार |

नैतिक जोखिम और एल्गोरिदमिक पक्षपात: फ्रांसीसी कंपनियों के लिए एआई के सामने चुनौतियां

सुरक्षा और डेटा संरक्षण के मामलों से परे, फ्रांसीसी कंपनियां एल्गोरिदमिक पक्षपात के कारण एक मौलिक चुनौती का सामना कर रही हैं। ये पक्षपात तब उत्पन्न होते हैं जब मॉडल को प्रशिक्षित करने वाले डेटा आंशिक रूप से प्रतिनिधि होते हैं या जब निहित पूर्वाग्रह प्रोग्रामों में प्रवेश कर जाते हैं। इससे भेदभाव उत्पन्न हो सकता है, विश्लेषण के परिणामों में विरूपण हो सकता है या स्वचालित निर्णय लेने की प्रक्रिया प्रभावित हो सकती है।

इन पक्षपातों से जुड़े नैतिक जोखिम विशेष रूप से महत्वपूर्ण हैं उन क्षेत्रों के लिए जो संवेदनशील हैं जैसे वित्त, स्वास्थ्य, या मानव संसाधन। उदाहरण के लिए, एक पक्षपातपूर्ण एआई अनुचित रूप से भर्ती निर्णयों को प्रभावित कर सकता है, कुछ ग्राहक प्रोफाइल को नुकसान पहुंचा सकता है, या विवादास्पद व्यावसायिक निर्णयों को बढ़ावा दे सकता है।

इन जोखिमों से निपटने के लिए, कंपनियों को नियमित एल्गोरिदम ऑडिट करना चाहिए, नैतिक अनुपालन परीक्षण करना चाहिए, और विकास टीमों की विविधता बढ़ानी चाहिए ताकि दृष्टिकोण की कमी को कम किया जा सके। जोखिमों के प्रति निर्णय निर्माताओं की जागरूकता और सुधारात्मक तंत्रों का समावेश भी आवश्यक है।

अंत में, यूरोपीय स्तर पर एआई विनियमन अब पक्षपात मूल्यांकन और पारदर्शिता के लिए कड़े मानदंड निर्धारित करता है, जिसके तहत फ्रांसीसी कंपनियों को इन मानकों का पालन करना अनिवार्य है, अन्यथा उन्हें कानूनी दंड और छवि को नुकसान का सामना करना पड़ सकता है।

एल्गोरिदमिक पक्षपात को कम करने के लिए व्यावहारिक उपाय

- उपयोग किए जा रहे मॉडलों पर स्वतंत्र ऑडिट करना

- एल्गोरिदम विकास में बहुविषयक विशेषज्ञों को शामिल करना

- प्रतिनिधि और विविधता वाले डेटा सेट का उपयोग करना

- एल्गोरिदमिक निर्णयों की व्याख्यात्मकता के लिए तंत्र स्थापित करना

- टीमों को एआई से जुड़े नैतिक जोखिमों के प्रति प्रशिक्षित करना

फ्रांसीसी कंपनियों में डिजिटल परिवर्तन और डेटा संरक्षण की चुनौतियां

डिजिटल परिवर्तन, जो एआई के तीव्र उपयोग द्वारा तेज़ हुआ है, डेटा संरक्षण नीतियों को मजबूत करने की मांग करता है। इस संदर्भ में, फ्रांसीसी कंपनियों को न केवल यूरोपीय GDPR मानकों का पालन करना चाहिए, बल्कि उन विशेष आवश्यकताओं को भी ध्यान में रखना चाहिए जो एआई प्रणालियों द्वारा संसाधित डेटा की गोपनीयता और अखंडता से संबंधित हैं।

स्वचालित इंटरफेस के माध्यम से संवेदनशील डेटा का प्रबंधन रिसाव और दुरुपयोग के जोखिम को बढ़ा सकता है। इसलिए, एक कड़ी साइबर सुरक्षा नीति में तकनीकी साधनों के उपयोग के साथ-साथ स्पष्ट भूमिकाओं की परिभाषा और जिम्मेदारी की व्यवस्था समाहित होनी चाहिए।

डेटा की सुरक्षा बाहरी प्रवाहों के नियंत्रण से भी जुड़ी है। फ्रांसीसी कंपनियों को गैर-प्रमाणित या यूरोपीय संघ से बाहर स्थित प्लेटफॉर्म के साथ आदान-प्रदान सीमित करने और अधिक नियंत्रण प्रदान करने वाले संप्रभु समाधान अपनाने के लिए प्रोत्साहित किया जाता है। यह दृष्टिकोण ग्राहकों और भागीदारों के विश्वास को बनाए रखने में मदद करता है, जो दीर्घकालिक व्यावसायिक संबंधों के लिए महत्वपूर्ण है।

फ्रांसीसी कंपनियों में एआई के सफल एकीकरण के लिए रणनीतिक दृष्टिकोण

अंत में, डिजिटल परिवर्तन की सफलता और जोखिमों को कम करने के लिए, फ्रांसीसी कंपनियों को समग्र और एकीकृत रणनीतिक दृष्टिकोण अपनाना चाहिए। इसमें न केवल एआई तकनीकों को शामिल करना, बल्कि टीमों का प्रशिक्षण, व्यावसायिक प्रक्रियाओं का पुनरीक्षण, और सुरक्षा तथा अनुपालन के प्रबंधन का समायोजन शामिल है।

एआई का उपयुक्त शासन अधिकारियों की नियुक्ति, नैतिक चार्टर्स की स्थापना और नियामक प्राधिकरणों के साथ करीबी सहयोग के माध्यम से किया जाता है। यह ढांचा नवाचार को प्रोत्साहित करता है, जबकि जिम्मेदार और पारदर्शी उपयोग सुनिश्चित करता है।

इन तीन कंपनियों की कहानी यह दिखाती है कि नवाचार के साथ सतर्कता आवश्यक है। आंतरिक कौशल विकास, जोखिमों के प्रति जागरूकता और अनुमत प्रथाओं की पारदर्शिता सुनिश्चित करती है कि एआई की संभावनाओं का प्रभावी उपयोग और उससे जुड़ी खतरों का सही प्रबंधन संभव हो।