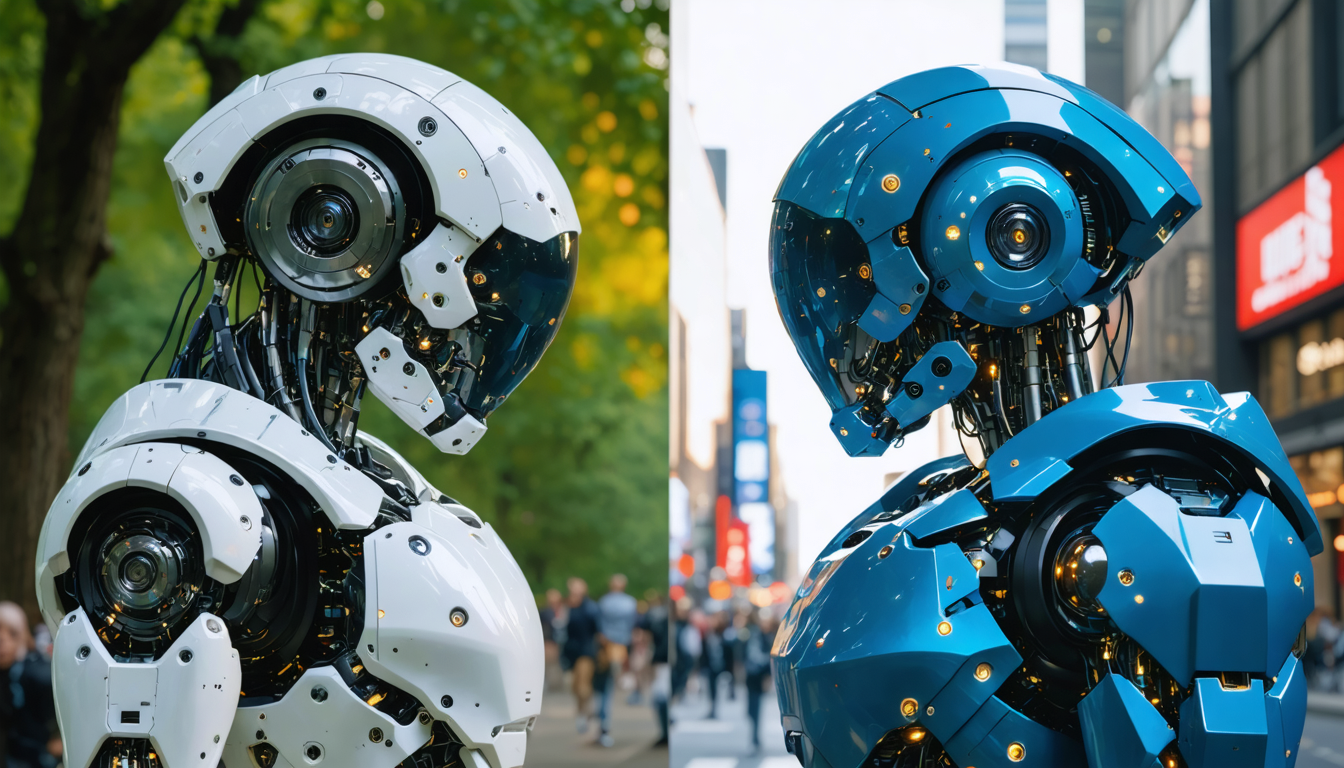

La nuova alleanza tra OpenAI e il Dipartimento della Guerra degli Stati Uniti solleva un dibattito importante all’inizio del 2026: si può accettare che tecnologie di intelligenza artificiale popolari diventino strumenti militari? Mentre Anthropic, un concorrente principale nel campo dell’IA, rifiuta categoricamente di partecipare alla militarizzazione dei suoi modelli, OpenAI dà il suo consenso a una partnership controversa. Questa divergenza strategica provoca un vero e proprio terremoto nella comunità degli utenti, dando vita al movimento “Cancel ChatGPT” che riunisce coloro che denunciano un abbandono etico. Più di una semplice disputa tecnologica, è una frattura profonda sui valori e le responsabilità che suscita questa svolta. Mentre Claude, l’assistente di Anthropic, scala la vetta delle classifiche delle applicazioni, la questione della fiducia verso i colossi dell’IA diventa cruciale, con implicazioni che superano il solo mercato e influenzano l’immagine del marchio e il futuro della regolamentazione.

La militarizzazione delle tecnologie di IA di grande consumo diventa una questione decisiva nelle scelte degli utenti nel 2026. Oltre alle prestazioni o funzionalità, sono le questioni etiche, di trasparenza e finalità che si impongono. Questo ritratto polarizzato tra OpenAI e Anthropic illumina anche problematiche più ampie, in particolare quelle sul controllo delle armi autonome, sulla sorveglianza di massa e sul ruolo delle imprese di IA nei confronti delle amministrazioni governative. Mentre alcuni salutano la volontà di guardie presso OpenAI, altri ritengono che il semplice consenso a un uso militare costituisca una rottura, fonte di una palese disaffezione verso ChatGPT. Questo caso illustra implicitamente il conflitto latente tra innovazione tecnologica, imperativi commerciali ed esigenze morali nell’era digitale.

- 1 Conseguenze dell’accordo OpenAI – Dipartimento della Guerra: movimento “Cancel ChatGPT” e impatto sugli utenti

- 2 Anthropic: deontologia e rifiuto della militarizzazione dell’intelligenza artificiale

- 3 Le guardie di OpenAI: consenso e limiti alla militarizzazione, l’argomentazione ufficiale

- 4 Etica e tecnologia: quando il grande pubblico si appropria delle questioni di militarizzazione dell’IA

- 5 Reazioni e posizionamenti nel settore dell’intelligenza artificiale

- 6 Il futuro: un’era in cui l’etica condiziona duramente le partnership strategiche in IA

- 7 Vie per un’integrazione etica e responsabile dell’IA nei settori strategici

- 8 Domande frequenti sulla controversia OpenAI, Anthropic e la militarizzazione dell’IA

- 8.1 Perché Anthropic ha rifiutato la militarizzazione della sua IA?

- 8.2 Quali garanzie afferma di aver ottenuto OpenAI nella partnership militare?

- 8.3 Qual è l’impatto della partnership OpenAI – Dipartimento della Guerra sul grande pubblico?

- 8.4 Claude di Anthropic ha beneficiato del rifiuto di militarizzazione?

- 8.5 Quali sono le sfide future per la militarizzazione dell’intelligenza artificiale?

Conseguenze dell’accordo OpenAI – Dipartimento della Guerra: movimento “Cancel ChatGPT” e impatto sugli utenti

L’annuncio ufficiale della partnership tra OpenAI e il Dipartimento americano della Guerra ha scatenato un’onda d’urto senza precedenti nella comunità degli utenti di intelligenza artificiale. Immediatamente, l’hashtag “Cancel ChatGPT” è emerso sui social media, esprimendo una contestazione massiccia e rapida. Questa ondata di disinstallazioni e disdette di abbonamenti a ChatGPT Plus sottolinea che l’accettazione o il rifiuto di un servizio non si limita più alla sua efficacia tecnica, ma ora si fonda su un giudizio morale sui valori dell’azienda.

Utenti impegnati, principalmente su X (ex-Twitter) e Reddit, hanno organizzato la difesa delle loro convinzioni condividendo guide dettagliate per esportare i loro dati, cancellare il loro account ChatGPT e migrare verso alternative ritenute più etiche, come l’assistente Claude di Anthropic. Per esempio, un utente ha pubblicato una serie completa di tutorial video su Reddit per facilitare questa transizione, mentre diversi blog specializzati hanno confrontato nel dettaglio la politica di OpenAI con quella di Anthropic, mettendo in evidenza la presa di posizione di quest’ultima contro la militarizzazione.

Non si tratta solo di un semplice effetto moda. Questo fenomeno incarna la prima volta in cui la militarizzazione dell’intelligenza artificiale di consumo diventa un criterio fondamentale nella fedeltà degli utenti. Infatti, alcune comunità di internauti si sono mobilitate non solo per protestare, ma anche per strutturare un discorso critico legato all’impatto dell’IA sulla sicurezza globale, sulla sorveglianza e sui rischi associati alle armi autonome.

Questa contestazione ha preso anche una dimensione economica: Apps Store e Play Store hanno visto Claude, l’IA di Anthropic, salire in vetta ai download, beneficiando direttamente dell’espulsione morale di ChatGPT. Tra l’altro, è significativo che questa crescita sia talvolta accompagnata da rotture tecniche, come sovraccarichi di server dovuti all’improvviso afflusso di nuovi utenti. Si osserva così che l’etica diventa un fattore chiave nel posizionamento e nella competitività delle soluzioni di intelligenza artificiale.

Ecco una sintesi delle principali conseguenze del movimento “Cancel ChatGPT” :

- Moltiplicazione delle disdette degli abbonamenti a pagamento a ChatGPT Plus.

- Creazione e diffusione di risorse educative per abbandonare efficacemente la piattaforma OpenAI.

- Impressionante risalita dell’IA Claude nelle classifiche degli store di applicazioni.

- Rafforzamento del dibattito pubblico sulla responsabilità delle aziende di IA riguardo agli usi militari.

- Accrescimento della polarizzazione tra utenti secondo la loro adesione o rifiuto della militarizzazione.

Esempio di guida per disdire ChatGPT Plus e migrare verso Claude

La guida pubblicata da un gruppo di utenti sottolinea che il processo di disdetta è semplice ma richiede di seguire più fasi chiave: esportare i dati personali, cancellare la cronologia delle conversazioni, disinstallare le applicazioni su vari dispositivi, quindi sottoscrivere un abbonamento a Claude tramite i negozi ufficiali.

Questo documento non si limita a una spiegazione tecnica, ma mette anche in rilievo la natura della scelta etica, “non sostenere più un attore che accetta di fornire un’intelligenza artificiale potenzialmente impiegata su reti militari classificate”.

Anthropic: deontologia e rifiuto della militarizzazione dell’intelligenza artificiale

Anthropic, azienda concorrente di OpenAI e creatrice di Claude, ha adottato una posizione fermamente contraria alla militarizzazione delle sue tecnologie di intelligenza artificiale. Piuttosto che firmare un accordo con il Pentagono, Anthropic ha preferito astenersi, invocando la mancanza di garanzie sufficienti per prevenire la sorveglianza di massa e le armi autonome senza controllo.

In un contesto in cui i finanziamenti governativi possono arrivare fino a centinaia di milioni di dollari, questo rifiuto costituisce una scommessa rischiosa sul lungo termine. Tuttavia, questa decisione si iscrive in una strategia qualitativa volta a proteggere la reputazione, la sicurezza e i valori morali dell’azienda.

Anthropic mette in evidenza il principio di sicurezza come pilastro della sua azione. L’azienda non chiude la porta a qualsiasi collaborazione militare ma pone come condizione sine qua non l’istituzione di guardie chiare, controllate e trasparenti prima di impegni. Questa sfumatura è fondamentale: rappresenta un equilibrio tra rifiuto categorico e apertura a un dialogo su regole etiche.

Secondo una nota interna resa pubblica, la direzione precisa che:

“Consideriamo che la militarizzazione delle IA senza un quadro rigoroso e verificabile presenta rischi troppo elevati per la società. Nessuna potenza dovrebbe possedere armi interamente autonome senza meccanismi di controllo robusti.”

Questa posizione conferisce a Claude un’immagine di strumento etico, garante di un’intelligenza artificiale responsabile e prudente nella sua elaborazione e nel suo dispiegamento.

L’effetto si sente tra gli utenti. Ne sono testimonianza le ricadute nei mercati applicativi dove Claude domina ormai l’App Store e il Play Store, elementi concreti che illustrano l’impatto di una strategia etica sul comportamento dei consumatori.

L’approccio di Anthropic articola diverse dimensioni:

- Insistenza sulla sicurezza e affidabilità dei dispiegamenti.

- Richiesta di trasparenza e controllo sull’utilizzo previsto da parte degli attori militari.

- Accettazione di una collaborazione condizionata, a differenza di una rottura definitiva.

- Posizionamento morale come vantaggio competitivo in un settore da monitorare.

Il costo del rifiuto: sfide strategiche e finanziarie

Rifiutare una partnership così lucrativa con il Dipartimento della Guerra significa anche una perdita importante di finanziamenti considerati utili, in un settore in cui l’investimento rimane una priorità per restare competitivi. Tuttavia, questa scelta illustra un posizionamento in cui i compromessi morali sono prioritari rispetto ai guadagni a breve termine.

Nel 2026, questa divergenza segna una svolta nella dinamica del settore. Essa provoca una ridefinizione dei criteri di valutazione delle aziende di IA, non solo sulle loro prestazioni tecniche, ma anche sulla loro etica operativa.

Le guardie di OpenAI: consenso e limiti alla militarizzazione, l’argomentazione ufficiale

OpenAI assume pienamente il suo accordo con il Dipartimento della Difesa americano. L’azienda afferma di aver negoziato un quadro comportante più guardie di sicurezza rispetto a quanto offerto ad Anthropic. Precisa che questo accordo esclude applicazioni legate alla sorveglianza di massa e a armi completamente autonome.

Il testo ufficiale insiste sul fatto che gli usi militari devono limitarsi a operazioni giudicate “lecite”, senza ambiguità rispetto al rispetto dei diritti umani. OpenAI promette anche di sorvegliare strettamente il rispetto di questi limiti.

Tuttavia, la reazione nella sfera pubblica resta mitigata. L’espressione “a fini leciti” in un contratto resta intrinsecamente soggetta alle evoluzioni del quadro legale e politico, il che suscita una sostanziale diffidenza da parte degli utenti. Questi temono che una clausola giuridica possa evolvere e permettere usi contestabili in futuro.

Ancora di più, la svolta operata da OpenAI, che fino a quel momento aveva difeso insieme ad Anthropic un approccio rigoroso in materia di sicurezza, sorprende una parte della sua comunità. Questo cambiamento alimenta un sentimento di incoerenza etica che si amplifica in un settore già percepito come opaco e complesso.

Ecco i punti principali della posizione di OpenAI riguardo al suo consenso alla militarizzazione:

- Garanzia di un quadro rigido che esclude la sorveglianza di massa.

- Impegno a non sviluppare armi completamente autonome.

- Controlli e audit regolari degli utilizzi all’interno del Dipartimento della Guerra.

- Appello a una collaborazione pragmatica per coniugare innovazione e sicurezza.

- Rischio di interpretazioni variabili di ciò che è “lecito” a lungo termine.

Perché la fiducia degli utenti vacilla

Le critiche rivolte a OpenAI non si limitano a questa singola faccenda, ma si inscrivono in un contesto più ampio di sfiducia: operazioni sui dati di addestramento, consumo energetico importante, implicazioni sociali e professionali complesse. La scelta militare aggiunge un peso supplementare, indebolendo la fiducia nella trasparenza dell’azienda.

Etica e tecnologia: quando il grande pubblico si appropria delle questioni di militarizzazione dell’IA

Questa vicenda ha segnato un capovolgimento senza precedenti nel modo in cui il grande pubblico percepisce le sfide dell’intelligenza artificiale. In passato, le controversie riguardavano spesso dimensioni tecniche astratte: bias algoritmici, riservatezza dei dati o impatto ambientale. Oggi, la questione della militarizzazione coinvolge direttamente la società civile, con un forte impatto emotivo e politico.

Questo cambiamento deriva da una crescente consapevolezza delle potenziali conseguenze di un uso non regolamentato, in particolare in un settore sensibile come la difesa. Gli utenti non vogliono più solo prestazioni o innovazione, cercano un allineamento con i loro valori. Capiscono che le IA non sono semplici strumenti neutrali, ma portano con sé scelte etiche fondamentali.

Questa evoluzione impone agli sviluppatori di intelligenza artificiale di rivedere profondamente la loro strategia commerciale. L’etica diventa un elemento centrale per mantenere una base utente che non esita a punire decisioni contrarie ai suoi principi.

Si nota inoltre una crescente sfida politica intorno alla regolamentazione dell’IA militare. L’opinione pubblica contribuisce ora a influenzare i dibattiti legislativi e internazionali, spingendo verso trasparenza e regole più rigorose per evitare una corsa sfrenata alle tecnologie a uso militare.

Le domande chiave sollevate dalla militarizzazione dell’IA:

- Il ruolo morale delle aziende nella concezione delle tecnologie IA.

- I rischi legati alla perdita di controllo sulle armi autonome.

- La sorveglianza estesa e potenzialmente invasiva resa possibile dall’IA.

- Il consenso informato e l’informazione degli utenti finali.

- La necessità di una regolamentazione internazionale armonizzata.

Reazioni e posizionamenti nel settore dell’intelligenza artificiale

Oltre a OpenAI e Anthropic, l’intero settore tecnologico è sotto il fuoco delle critiche sulla questione della militarizzazione delle intelligenze artificiali. Diversi attori noti hanno dovuto chiarire la loro posizione ed esporre pubblicamente i loro modi di impegno.

Alcuni piccoli attori come Anthropic seducono con la loro prudenza e il loro rifiuto dei contratti militari, privilegiando uno sviluppo etico e responsabile. Al contrario, altre grandi aziende scelgono di collaborare con i governi, sostenendo la necessità di inventare quadri sicuri per tecnologie che intervengono in ambiti di alto valore strategico.

Questa polarizzazione si riflette anche negli investimenti finanziari. Una tabella comparativa dei diversi partenariati militari nel settore illustra le scelte strategiche delle aziende di IA:

| Azienda | Partenariato Militare | Posizione Etica | Importo (M$) |

|---|---|---|---|

| OpenAI | Sì, con il Dipartimento della Guerra USA | Consenso con guardie | 200 |

| Anthropic | No, rifiuto prudenziale | Rifiuto senza accordo | 0 |

| Google DeepMind | Collaborazione limitata, sorveglianza | Posizione mitigata, controllo aumentato | 150 |

| Microsoft | Integrazione IA nelle forze armate USA | Consenso rigido | 180 |

Gli investitori tecnologici, come Aidan Gold, si esprimono poi pubblicamente sul dilemma morale che OpenAI ha vissuto prima della firma dell’accordo. Indicano in particolare l’ironia di un sostegno pubblico temporaneo alla posizione di Anthropic sulla sicurezza prima del brusco cambio di rotta.

Il futuro: un’era in cui l’etica condiziona duramente le partnership strategiche in IA

Il caso OpenAI-Anthropic evidenzia la crescita di una nuova era in cui la militarizzazione dell’IA diventa un vero e proprio test morale. Le aziende non possono più accontentarsi della promessa tecnologica: sono ora giudicate anche sulla loro capacità di allineare le decisioni strategiche con un’etica riconosciuta dai loro utenti.

Gli esempi recenti mostrano che questa esigenza non è un freno ma un’opportunità. Per Anthropic, rifiutare un contratto governativo importante traduce una forza di carattere e una volontà chiara di posizionarsi sulla scena internazionale come un attore responsabile.

Per OpenAI la sfida è più complessa. Il futuro dirà se il consenso a questa partnership militare, con le sue clausole restrittive, riuscirà a convincere la comunità e a consolidare la fiducia. In ogni caso, la battaglia per l’etica è ormai al cuore stesso delle strategie aziendali.

Questa svolta apre anche la strada a un dialogo arricchito tra autorità pubbliche, attori privati e società civile. La pressione per istituire regolamentazioni internazionali sull’IA e sui suoi usi militari si intensifica in parallelo alle reazioni popolari. Il mercato non potrà più ignorare questa dimensione etica senza rischiare di fratturare duramente la sua base di utenti.

L’intelligenza artificiale, lontana dall’essere un semplice strumento, deve ora essere considerata come un insieme il cui ogni sviluppo tecnico coinvolge responsabilità sociali importanti, che devono fare oggetto di un consenso informato e collettivo.

Vie per un’integrazione etica e responsabile dell’IA nei settori strategici

Per garantire un equilibrio tra innovazione tecnologica ed esigenze morali, si possono immaginare diverse vie:

- Stabilire norme internazionali rigide che regolino l’uso delle IA nel campo militare, in particolare in materia di armi autonome e sorveglianza.

- Rafforzare la trasparenza dei contratti e delle finalità d’uso tra aziende e amministrazioni.

- Coinvolgere gli utenti finali nei dibattiti etici, tramite consultazione e informazione attiva.

- Sviluppare sistemi di audit terzi per verificare il rispetto degli impegni presi.

- Favorire partnership tra ricercatori, regolatori e industrie per allineare sviluppo e controllo.

- Adottare una comunicazione chiara per evitare ambiguità e preservare la fiducia.

Ecco una tabella sintetica dei rischi, sfide e soluzioni legati alla militarizzazione delle IA:

| Rischi | Sfide | Soluzioni possibili |

|---|---|---|

| Armi autonome non controllate | Sicurezza globale, stabilità internazionale | Implementazione di trattati, divieti chiari |

| Sorveglianza di massa invasiva | Rispetto dei diritti civili, privacy | Legislazione rigorosa, controllo democratico |

| Perdita di fiducia degli utenti | Accettabilità sociale e commerciale | Trasparenza, dialogo, educazione |

| Uso a fini illeciti | Etica e legalità | Audit indipendenti, sanzioni |

Domande frequenti sulla controversia OpenAI, Anthropic e la militarizzazione dell’IA

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Perché Anthropic ha rifiutato la militarizzazione della sua IA?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Anthropic si è opposta alla militarizzazione della sua IA da parte del Pentagono a causa di garanzie insufficienti sulla prevenzione della sorveglianza di massa e sul controllo delle armi autonome. L’azienda privilegia un impegno solo sotto rigide guardie per assicurare la sicurezza e l’affidabilità.”}},{“@type”:”Question”,”name”:”Quali garanzie afferma di aver ottenuto OpenAI nella partnership militare?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”OpenAI afferma che il suo accordo esclude gli usi legati alla sorveglianza di massa e alle armi interamente autonome, e prevede un controllo rigoroso nonché un quadro legale che limita gli usi militari a fini leciti.”}},{“@type”:”Question”,”name”:”Qual è l’impatto della partnership OpenAI – Dipartimento della Guerra sul grande pubblico?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”La partnership ha provocato un movimento di contestazione chiamato ‘Cancel ChatGPT’ in cui utenti hanno abbandonato la piattaforma per alternative giudicate più etiche, riportando al centro del dibattito la questione morale legata all’IA e al suo uso militare.”}},{“@type”:”Question”,”name”:”Claude di Anthropic ha beneficiato del rifiuto di militarizzazione?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Sì, Claude ha realizzato una forte progressione nelle classifiche delle applicazioni, in particolare sull’App Store, grazie alla sua immagine di IA più etica, dimostrando l’importanza del fattore etico nelle scelte degli utenti.”}},{“@type”:”Question”,”name”:”Quali sono le sfide future per la militarizzazione dell’intelligenza artificiale?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Le sfide future riguardano l’istituzione di norme internazionali, la trasparenza delle partnership, la partecipazione degli utenti ai dibattiti etici e lo sviluppo di sistemi di audit per prevenire derive e preservare la fiducia.”}}]}Perché Anthropic ha rifiutato la militarizzazione della sua IA?

Anthropic si è opposta alla militarizzazione della sua IA da parte del Pentagono a causa di garanzie insufficienti sulla prevenzione della sorveglianza di massa e sul controllo delle armi autonome. L’azienda privilegia un impegno solo sotto rigide guardie per assicurare la sicurezza e l’affidabilità.

Quali garanzie afferma di aver ottenuto OpenAI nella partnership militare?

OpenAI afferma che il suo accordo esclude gli usi legati alla sorveglianza di massa e alle armi interamente autonome, e prevede un controllo rigoroso nonché un quadro legale che limita gli usi militari a fini leciti.

Qual è l’impatto della partnership OpenAI – Dipartimento della Guerra sul grande pubblico?

La partnership ha provocato un movimento di contestazione chiamato ‘Cancel ChatGPT’ in cui utenti hanno abbandonato la piattaforma per alternative giudicate più etiche, riportando al centro del dibattito la questione morale legata all’IA e al suo uso militare.

Claude di Anthropic ha beneficiato del rifiuto di militarizzazione?

Sì, Claude ha realizzato una forte progressione nelle classifiche delle applicazioni, in particolare sull’App Store, grazie alla sua immagine di IA più etica, dimostrando l’importanza del fattore etico nelle scelte degli utenti.

Quali sono le sfide future per la militarizzazione dell’intelligenza artificiale?

Le sfide future riguardano l’istituzione di norme internazionali, la trasparenza delle partnership, la partecipazione degli utenti ai dibattiti etici e lo sviluppo di sistemi di audit per prevenire derive e preservare la fiducia.