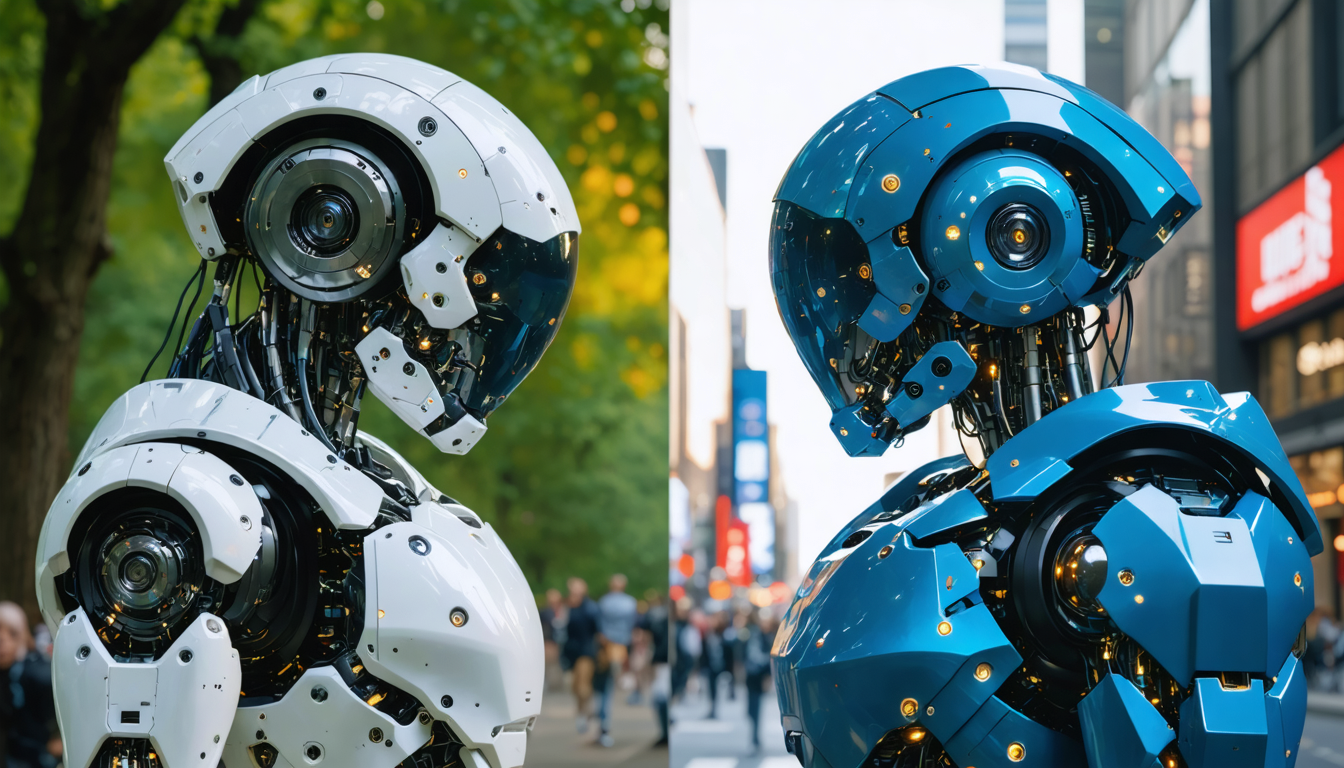

Nowy sojusz pomiędzy OpenAI a Departamentem Wojny Stanów Zjednoczonych wywołuje poważną debatę na początku 2026 roku: czy można zaakceptować, aby popularne technologie sztucznej inteligencji stały się narzędziami wojskowymi? Podczas gdy Anthropic, poważny konkurent w dziedzinie SI, stanowczo odmawia udziału w militaryzacji swoich modeli, OpenAI wyraża zgodę na kontrowersyjne partnerstwo. Ta strategiczna różnica wywołuje prawdziwe trzęsienie ziemi w społeczności użytkowników, dając początek ruchowi „Cancel ChatGPT”, który łączy tych, którzy krytykują etyczne porzucenie. To więcej niż zwykły spór technologiczny – to głęboka przepaść w kwestiach wartości i odpowiedzialności wywołana przez ten zwrot. Podczas gdy Claude, asystent Anthropic, awansuje na czoło rankingu aplikacji, kwestia zaufania do gigantów SI staje się kluczowa, z konsekwencjami wykraczającymi poza sam rynek i wpływającymi na wizerunek marki oraz przyszłość regulacji.

Militaryzacja technologii SI dostępnych dla szerokiego odbiorcy staje się decydującą kwestią wyborów użytkowników w 2026 roku. Poza wydajnością czy funkcjonalnościami, dominują pytania etyczne, dotyczące przejrzystości i celów. Ten spolaryzowany obraz między OpenAI a Anthropic oświetla także szersze problemy, w szczególności kontrolę nad autonomiczną bronią, nadzór masowy oraz rolę firm SI wobec instytucji rządowych. Podczas gdy niektórzy chwalą wolę wprowadzenia zabezpieczeń w OpenAI, inni uważają, że sama zgoda na wojskowe zastosowanie stanowi złamanie zasad i prowadzi do wyraźnego odwrócenia się od ChatGPT. Ten przypadek ilustruje ukryty konflikt między innowacją technologiczną, imperatywami handlowymi a wymaganiami moralnymi w erze cyfrowej.

- 1 Konsekwencje porozumienia OpenAI – Departament Wojny: ruch „Cancel ChatGPT” i wpływ na użytkowników

- 2 Anthropic: deontologia i odmowa militaryzacji sztucznej inteligencji

- 3 Zabezpieczenia w OpenAI: zgoda i granice militaryzacji, oficjalne argumenty

- 4 Etyka i technologia: gdy społeczeństwo angażuje się w kwestie militaryzacji SI

- 5 Reakcje i stanowiska w sektorze sztucznej inteligencji

- 6 Przyszłość: era, w której etyka trwało warunkuje strategiczne partnerstwa w SI

- 7 Drogi do etycznej i odpowiedzialnej integracji SI w sektorach strategicznych

- 8 Często zadawane pytania dotyczące kontrowersji OpenAI, Anthropic i militaryzacji SI

- 8.1 Dlaczego Anthropic odmówiło militaryzacji swojej SI?

- 8.2 Jakie gwarancje OpenAI twierdzi, że uzyskało w ramach wojskowego partnerstwa?

- 8.3 Jaki jest wpływ partnerstwa OpenAI – Departament Wojny na społeczeństwo?

- 8.4 Czy Claude od Anthropic skorzystał na odmowie militaryzacji?

- 8.5 Jakie są przyszłe wyzwania związane z militaryzacją sztucznej inteligencji?

Konsekwencje porozumienia OpenAI – Departament Wojny: ruch „Cancel ChatGPT” i wpływ na użytkowników

Oficjalne ogłoszenie partnerstwa między OpenAI a amerykańskim Departamentem Wojny wywołało falę szoku bez precedensu w społeczności użytkowników sztucznej inteligencji. Natychmiast pojawił się hashtag “Cancel ChatGPT” w mediach społecznościowych, wyrażając masowy i szybki sprzeciw. Ta fala odinstalowań i rezygnacji z abonamentu ChatGPT Plus podkreśla, że akceptacja lub odrzucenie usługi nie ogranicza się już do skuteczności technicznej, lecz opiera się na moralnej ocenie wartości firmy.

Zangażowani internauci, głównie na X (dawniej Twitter) i Reddicie, zorganizowali obronę swoich przekonań, dzieląc się szczegółowymi przewodnikami, jak wyeksportować swoje dane, usunąć konto ChatGPT i migrować do etyczniej ocenianych alternatyw, takich jak asystent Claude od Anthropic. Na przykład jeden użytkownik opublikował kompletną serię tutoriali wideo na Reddicie, aby ułatwić tę zmianę, a kilka specjalistycznych blogów szczegółowo porównało politykę OpenAI z polityką Anthropic, podkreślając stanowisko tej drugiej wobec militaryzacji.

To nie tylko chwilowa moda. Zjawisko to stanowi pierwszy raz, gdy militaryzacja sztucznej inteligencji powszechnego użytku staje się podstawowym kryterium lojalności użytkowników. W rzeczywistości niektóre społeczności internetowe zmobilizowały się nie tylko do protestu, ale także do budowania krytycznego dyskursu dotyczącego wpływu SI na bezpieczeństwo globalne, nadzór i ryzyka związane z autonomiczną bronią.

Sprzeciw ten nabrał również wymiaru ekonomicznego: App Store i Play Store odnotowały awans Claude, SI od Anthropic, na czoło list pobrań, korzystając bezpośrednio na moralnym odsunięciu ChatGPT. Co więcej, ten wzrost czasami towarzyszy przerwom technicznym, takim jak przeciążenia serwerów spowodowane nagłym napływem nowych użytkowników. Można więc zauważyć, że etyka staje się kluczowym czynnikiem w pozycjonowaniu i konkurencyjności rozwiązań sztucznej inteligencji.

Oto podsumowanie głównych konsekwencji ruchu “Cancel ChatGPT”:

- Wzrost liczby rezygnacji z płatnych subskrypcji ChatGPT Plus.

- Tworzenie i rozpowszechnianie materiałów edukacyjnych pomagających skutecznie opuścić platformę OpenAI.

- Spektakularny wzrost popularności SI Claude w rankingach sklepów z aplikacjami.

- Wzmocnienie debaty publicznej na temat odpowiedzialności firm SI względem zastosowań wojskowych.

- Wzmocnienie polaryzacji użytkowników w zależności od ich poparcia lub odrzucenia militaryzacji.

Przykład przewodnika dotyczącego rezygnacji z ChatGPT Plus i migracji do Claude

Przewodnik opublikowany przez grupę użytkowników podkreśla, że proces rezygnacji jest prosty, ale wymaga wykonania kilku kluczowych kroków: eksport osobistych danych, usunięcie historii rozmów, odinstalowanie aplikacji na różnych urządzeniach, a następnie wykupienie subskrypcji Claude w oficjalnych sklepach.

Dokument ten nie ogranicza się do wyjaśnień technicznych, ale podkreśla także etyczny charakter wyboru: „przestać wspierać podmiot, który zgadza się dostarczać sztuczną inteligencję potencjalnie wykorzystywaną w tajnych sieciach wojskowych”.

Anthropic: deontologia i odmowa militaryzacji sztucznej inteligencji

Anthropic, konkurencyjna firma wobec OpenAI i twórca Claude, przyjęła stanowisko zdecydowanie sprzeczne z militaryzacją swoich technologii sztucznej inteligencji. Zamiast podpisywać umowę z Pentagonem, Anthropic wolał się powstrzymać, powołując się na brak wystarczających gwarancji zapobiegania masowemu nadzorowi i niekontrolowanym broniom autonomicznym.

W kontekście, gdzie rządowe finansowanie może sięgać setek milionów dolarów, ta odmowa stanowi ryzykowne postawienie na długi termin. Jednak decyzja ta wpisuje się w strategię jakościową mającą na celu ochronę reputacji, bezpieczeństwa i wartości moralnych firmy.

Anthropic stawia na zasadę bezpieczeństwa jako kamień węgielny swojego podejścia. Firma nie zamyka drzwi na jakąkolwiek współpracę wojskową, ale stawia jako warunek sine qua non ustanowienie jasnych, kontrolowanych i przejrzystych zabezpieczeń przed zaangażowaniem się. Ta niuans jest fundamentalna: stanowi równowagę między stanowczą odmową a otwartością na dialog w sprawie reguł etycznych.

Według opublikowanej notatki wewnętrznej, kierownictwo podkreśla, że:

„Uważamy, że militaryzacja SI bez rygorystycznych i weryfikowalnych ram niesie zbyt duże ryzyko dla społeczeństwa. Żadne mocarstwo nie powinno dysponować w pełni autonomiczną bronią bez solidnych mechanizmów kontroli.”

To stanowisko nadaje Claude wizerunek etycznego narzędzia, gwaranta odpowiedzialnej i ostrożnej sztucznej inteligencji w procesie tworzenia i wdrażania.

Efekt jest odczuwalny wśród użytkowników. Świadczą o tym efekty na rynkach aplikacji, gdzie Claude dominuje obecnie w App Store i Play Store, co stanowi konkretne odzwierciedlenie wpływu strategii etycznej na zachowania konsumenckie.

Podejście Anthropic łączy kilka wymiarów:

- Nacisk na bezpieczeństwo i ochronę wdrażanych rozwiązań.

- Żądanie przejrzystości i kontroli nad przewidywanym użyciem przez podmioty wojskowe.

- Akceptacja warunkowej współpracy, w odróżnieniu od definitywnego zerwania.

- Pozycjonowanie moralne jako przewaga konkurencyjna w sektorze wymagającym nadzoru.

Koszt odmowy: strategiczne i finansowe wyzwania

Odmowa tak lukratywnego partnerstwa z Departamentem Wojny oznacza również znaczącą utratę finansowania uznanego za istotne, w sektorze, gdzie inwestycje pozostają priorytetem dla utrzymania konkurencyjności. Mimo to ten wybór ukazuje postawę, w której kompromisy moralne mają pierwszeństwo nad krótkoterminowymi zyskami.

W 2026 roku ten rozłam wyznacza punkt zwrotny w dynamice sektora. Wywołuje redefinicję kryteriów oceny firm SI, nie tylko pod kątem ich wydajności technicznej, ale także operacyjnej etyki.

Zabezpieczenia w OpenAI: zgoda i granice militaryzacji, oficjalne argumenty

OpenAI w pełni popiera swoje porozumienie z Departamentem Obrony USA. Firma twierdzi, że wynegocjowała ramy obejmujące więcej zabezpieczeń niż te, które zaproponowano Anthropic. Precyzuje, że umowa wyklucza zastosowania związane z masowym nadzorem oraz całkowicie autonomiczną bronią.

Oficjalny tekst podkreśla, że użycia wojskowe muszą ograniczać się do operacji uznanych za „legalne”, bez wątpliwości co do poszanowania praw człowieka. OpenAI zapewnia także o ścisłym monitorowaniu przestrzegania tych granic.

Jednak reakcje w przestrzeni publicznej pozostają mieszane. Zwrot “w celach legalnych” w kontrakcie pozostaje wewnętrznie zależny od zmian ram prawnych i politycznych, co wywołuje znaczną nieufność użytkowników. Obawiają się oni, że klauzula prawna może ewoluować i pozwolić na kontrowersyjne zastosowania w przyszłości.

Co więcej, zwrot OpenAI, która wcześniej broniła wraz z Anthropic rygorystycznego podejścia do bezpieczeństwa, szokuje część jej społeczności. Ten zwrot podsyca poczucie nieetycznej niespójności, które narasta w sektorze już postrzeganym jako nieprzejrzysty i skomplikowany.

Oto główne punkty stanowiska OpenAI dotyczącego zgody na militaryzację:

- Zapewnienie rygorystycznych ram wykluczających masowy nadzór.

- Zobowiązanie do nierozwoju w pełni autonomicznej broni.

- Regularne kontrole i audyty użyć w Departamencie Wojny.

- Wezwanie do pragmatycznej współpracy łączącej innowacje i bezpieczeństwo.

- Ryzyko zmiennej interpretacji, co jest „legalne” w dłuższej perspektywie.

Dlaczego zaufanie użytkowników chwieję się

Krytyka skierowana w stronę OpenAI nie ogranicza się do tej jednej sprawy, lecz wpisuje się w szerszy kontekst nieufności: wykorzystanie wojen danych treningowych, wysoka konsumpcja energii, skomplikowane implikacje społeczne i zawodowe. Decyzja o wojskowym zastosowaniu dodaje kolejny ciężar, osłabiając zaufanie do przejrzystości firmy.

Etyka i technologia: gdy społeczeństwo angażuje się w kwestie militaryzacji SI

Ta sprawa oznacza bezprecedensową zmianę w sposobie, w jaki społeczeństwo postrzega wyzwania sztucznej inteligencji. W przeszłości kontrowersje dotyczyły często abstrakcyjnych wymiarów technicznych: uprzedzeń algorytmicznych, prywatności danych czy wpływu na środowisko. Dziś kwestia militaryzacji angażuje społeczeństwo obywatelskie bezpośrednio, z silnym aspektem emocjonalnym i politycznym.

Ta zmiana wynika z rosnącej świadomości potencjalnych konsekwencji nieuregulowanego użycia, zwłaszcza w tak wrażliwym obszarze jak obrona. Użytkownicy nie chcą już tylko wydajności czy innowacji, lecz poszukują zgodności z własnymi wartościami. Rozumieją, że SI nie jest jedynie neutralnym narzędziem, lecz niesie ze sobą fundamentalne wybory etyczne.

Ta ewolucja zmusza twórców sztucznej inteligencji do głębokiego przemyślenia swojej strategii biznesowej. Etyka staje się kluczowym elementem zatrzymywania bazy użytkowników, którzy nie wahają się karać decyzje sprzeczne z ich zasadami.

Warto też zauważyć rosnące znaczenie polityczne regulacji SI w kontekście wojskowym. Opinia publiczna zaczyna ważyć w debatach legislacyjnych i międzynarodowych, zachęcając do przejrzystości oraz wyraźniejszych reguł, aby uniknąć niekontrolowanej wyścigu zbrojeń technologii wojskowych.

Kluczowe pytania podniesione przez militaryzację SI:

- Moralna rola firm w projektowaniu technologii SI.

- Ryzyka utraty kontroli nad autonomiczną bronią.

- Rozległy i potencjalnie inwazyjny nadzór umożliwiony przez SI.

- Świadoma zgoda i informowanie końcowych użytkowników.

- Potrzeba międzynarodowej, zharmonizowanej regulacji.

Reakcje i stanowiska w sektorze sztucznej inteligencji

Poza OpenAI i Anthropic, cały sektor technologiczny znalazł się pod ostrzałem krytyki dotyczącej kwestii militaryzacji sztucznej inteligencji. Kilka znanych podmiotów musiało wyjaśnić swoje stanowisko i publicznie przedstawić warunki zaangażowania.

Niektórzy mniejsi gracze, tacy jak Anthropic, zdobywają popularność swoją ostrożnością i odmową podpisywania kontraktów wojskowych, preferując etyczny i odpowiedzialny rozwój. Z kolei większe korporacje decydują się współpracować z rządami, argumentując konieczność stworzenia bezpiecznych ram dla technologii, które mają zastosowanie w strategicznie istotnych obszarach.

Polaryzacja odzwierciedla się również w inwestycjach finansowych. Porównawcza tabela różnych wojskowych partnerstw sektorowych ilustruje strategiczne wybory firm SI:

| Firma | Partnerstwo wojskowe | Stanowisko etyczne | Kwota (M$) |

|---|---|---|---|

| OpenAI | Tak, z Departamentem Wojny USA | Zgoda z zabezpieczeniami | 200 |

| Anthropic | Nie, odmowa z ostrożności | Odrzucenie bez porozumienia | 0 |

| Google DeepMind | Ograniczona współpraca, nadzór | Stanowisko umiarkowane, zwiększona kontrola | 150 |

| Microsoft | Integracja SI z siłami zbrojnymi USA | Ścisła zgoda | 180 |

Inwestorzy technologiczni, tacy jak Aidan Gold, również publicznie wypowiadają się o moralnym dylemacie, z jakim borykało się OpenAI przed podpisaniem umowy. Zwracają w szczególności uwagę na ironię tymczasowego publicznego wsparcia stanowiska Anthropic w sprawie bezpieczeństwa przed nagłą zmianą kursu.

Przyszłość: era, w której etyka trwało warunkuje strategiczne partnerstwa w SI

Sprawa OpenAI-Anthropic podkreśla wzrost znaczenia nowej ery, gdzie militaryzacja SI staje się prawdziwym testem moralnym. Firmy nie mogą już ograniczać się do technologicznych obietnic: są teraz oceniane także pod kątem zdolności do zgodnego z etyką podejmowania decyzji strategicznych zaakceptowanych przez ich użytkowników.

Ostatnie przykłady pokazują, że to wymaganie nie jest hamulcem, lecz szansą. Dla Anthropic odmowa dużego kontraktu rządowego świadczy o sile charakteru i jasnym pragnieniu zajęcia pozycji odpowiedzialnego aktora na międzynarodowej scenie.

Dla OpenAI wyzwanie jest bardziej złożone. Przyszłość pokaże, czy zgoda na to wojskowe partnerstwo, z jego restrykcyjnymi klauzulami, przekona społeczność i utrzyma zaufanie. W każdym razie walka o etykę jest teraz w samym centrum strategii firm.

Ten zwrot otwiera również drogę do rozwiniętego dialogu pomiędzy władzami publicznymi, podmiotami prywatnymi i społeczeństwem obywatelskim. Presja na wprowadzenie międzynarodowych regulacji dotyczących SI i jej wojskowych zastosowań nasila się równolegle z reakcjami społecznymi. Rynek nie będzie mógł zignorować tego wymiaru etycznego bez ryzyka trwałego podzielenia bazy użytkowników.

Sztuczna inteligencja, daleka od bycia zwykłym narzędziem, musi być teraz postrzegana jako całość, w której każda techniczna ewolucja pociąga za sobą poważne społeczne obowiązki, wymagające świadomej i wspólnej zgody.

Drogi do etycznej i odpowiedzialnej integracji SI w sektorach strategicznych

Aby zapewnić równowagę między innowacją technologiczną a wymaganiami moralnymi, można rozważyć kilka kierunków:

- Ustanowienie międzynarodowych, rygorystycznych norm regulujących użycie SI w dziedzinie wojskowości, w szczególności dotyczących autonomicznej broni i nadzoru.

- Wzmocnienie przejrzystości kontraktów i celów wykorzystywania pomiędzy firmami a administracjami.

- Zaangażowanie użytkowników końcowych w etyczne debaty poprzez konsultacje i aktywną informację.

- Rozwijanie niezależnych systemów audytu umożliwiających weryfikację przestrzegania zobowiązań.

- Sprzyjanie partnerstwom między naukowcami, regulatorami a przemysłem dla zrównoważonego rozwoju i nadzoru.

- Przyjęcie jasnej komunikacji, aby odrzucić niejasności i chronić zaufanie.

Oto syntetyczna tabela ryzyk, wyzwań i możliwych rozwiązań związanych z militaryzacją SI:

| Ryzyka | Wyzwania | Możliwe rozwiązania |

|---|---|---|

| Niekontrolowane autonomiczne bronie | Bezpieczeństwo globalne, stabilność międzynarodowa | Wprowadzanie traktatów, jasne zakazy |

| Inwazyjny masowy nadzór | Poszanowanie praw obywatelskich, prywatność | Rygorystyczne prawo, demokratyczna kontrola |

| Utrata zaufania użytkowników | Akceptacja społeczna i handlowa | Przejrzystość, dialog, edukacja |

| Użycie w nielegalnych celach | Etyka i legalność | Niezależne audyty, sankcje |

Często zadawane pytania dotyczące kontrowersji OpenAI, Anthropic i militaryzacji SI

{„@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{„@type”:”Question”,”name”:”Dlaczego Anthropic odmówiło militaryzacji swojej SI?”,”acceptedAnswer”:{„@type”:”Answer”,”text”:”Anthropic sprzeciwiło się militaryzacji swojej SI przez Pentagon z powodu niewystarczających gwarancji zapobiegania masowemu nadzorowi i kontroli nad autonomiczną bronią. Firma preferuje zaangażowanie wyłącznie pod warunkiem ścisłych zabezpieczeń zapewniających bezpieczeństwo i ochronę.”}},{„@type”:”Question”,”name”:”Jakie gwarancje OpenAI twierdzi, że uzyskało w ramach wojskowego partnerstwa?”,”acceptedAnswer”:{„@type”:”Answer”,”text”:”OpenAI twierdzi, że jej umowa wyklucza zastosowania związane z masowym nadzorem i bronią w pełni autonomiczną, oraz przewiduje ścisłą kontrolę i ramy prawne ograniczające użycie wojskowe do celów legalnych.”}},{„@type”:”Question”,”name”:”Jaki jest wpływ partnerstwa OpenAI – Departament Wojny na społeczeństwo?”,”acceptedAnswer”:{„@type”:”Answer”,”text”:”Partnerstwo wywołało ruch protestacyjny nazwany 'Cancel ChatGPT’, w ramach którego użytkownicy opuścili platformę na rzecz etycznie ocenianych alternatyw, stawiając w centrum debaty moralne aspekty związane z SI i jej wojskowym zastosowaniem.”}},{„@type”:”Question”,”name”:”Czy Claude od Anthropic skorzystał na odmowie militaryzacji?”,”acceptedAnswer”:{„@type”:”Answer”,”text”:”Tak, Claude odnotował silny wzrost w rankingach aplikacji, szczególnie w App Store, dzięki wizerunkowi SI bardziej etycznej, co pokazuje wagę czynnika etycznego w wyborach użytkowników.”}},{„@type”:”Question”,”name”:”Jakie są przyszłe wyzwania związane z militaryzacją sztucznej inteligencji?”,”acceptedAnswer”:{„@type”:”Answer”,”text”:”Przyszłe wyzwania obejmują ustanowienie międzynarodowych norm, przejrzystość partnerstw, uczestnictwo użytkowników w debatach etycznych oraz rozwój systemów audytu zapobiegających nadużyciom i chroniących zaufanie.”}}]}Dlaczego Anthropic odmówiło militaryzacji swojej SI?

Anthropic sprzeciwiło się militaryzacji swojej SI przez Pentagon z powodu niewystarczających gwarancji zapobiegania masowemu nadzorowi i kontroli nad autonomiczną bronią. Firma preferuje zaangażowanie wyłącznie pod warunkiem ścisłych zabezpieczeń zapewniających bezpieczeństwo i ochronę.

Jakie gwarancje OpenAI twierdzi, że uzyskało w ramach wojskowego partnerstwa?

OpenAI twierdzi, że jej umowa wyklucza zastosowania związane z masowym nadzorem i bronią w pełni autonomiczną, oraz przewiduje ścisłą kontrolę i ramy prawne ograniczające użycie wojskowe do celów legalnych.

Jaki jest wpływ partnerstwa OpenAI – Departament Wojny na społeczeństwo?

Partnerstwo wywołało ruch protestacyjny nazwany 'Cancel ChatGPT’, w ramach którego użytkownicy opuścili platformę na rzecz etycznie ocenianych alternatyw, stawiając w centrum debaty moralne aspekty związane z SI i jej wojskowym zastosowaniem.

Czy Claude od Anthropic skorzystał na odmowie militaryzacji?

Tak, Claude odnotował silny wzrost w rankingach aplikacji, szczególnie w App Store, dzięki wizerunkowi SI bardziej etycznej, co pokazuje wagę czynnika etycznego w wyborach użytkowników.

Jakie są przyszłe wyzwania związane z militaryzacją sztucznej inteligencji?

Przyszłe wyzwania obejmują ustanowienie międzynarodowych norm, przejrzystość partnerstw, uczestnictwo użytkowników w debatach etycznych oraz rozwój systemów audytu zapobiegających nadużyciom i chroniących zaufanie.