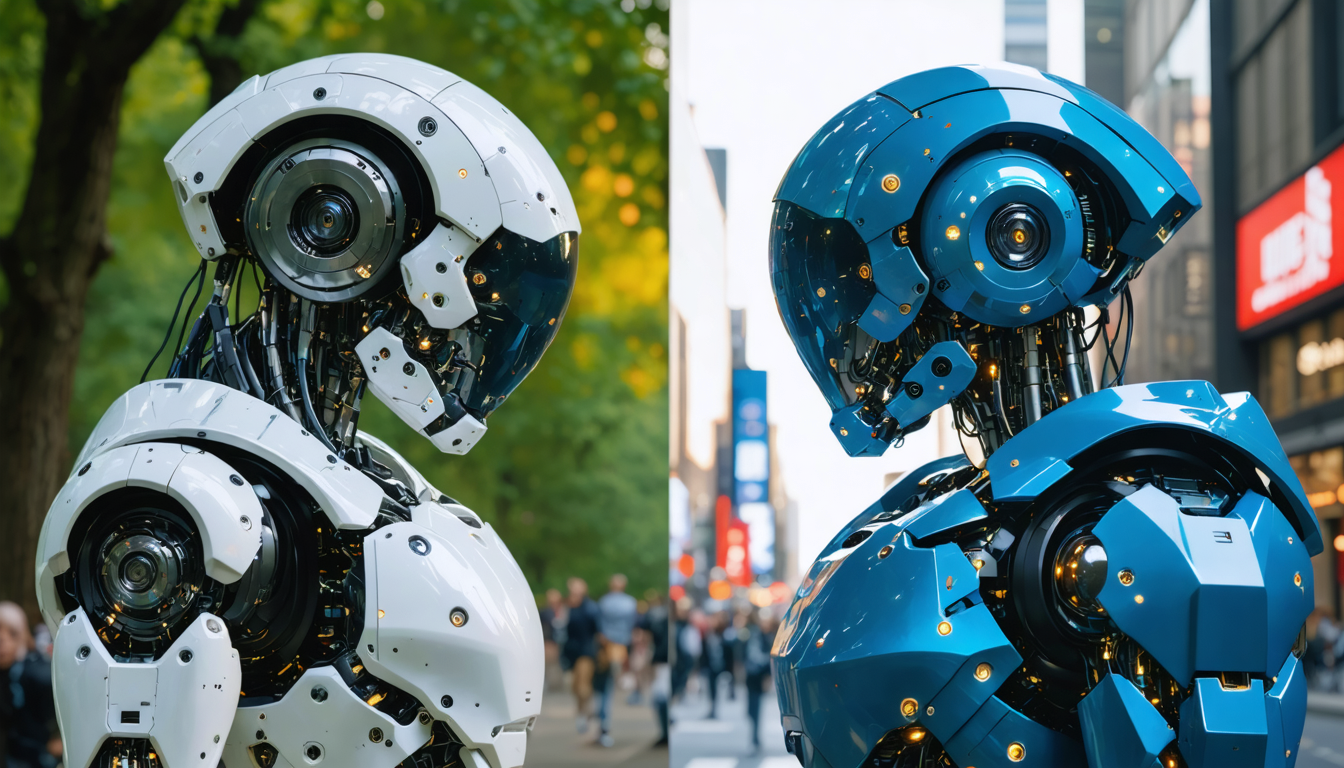

Aliansi baru antara OpenAI dan Departemen Pertahanan Amerika Serikat memicu perdebatan besar di awal tahun 2026 ini: apakah kita dapat menerima bahwa teknologi kecerdasan buatan populer menjadi alat militer? Sementara Anthropic, pesaing utama dalam bidang AI, secara tegas menolak berpartisipasi dalam militerisasi model-modelnya, OpenAI menyetujui kemitraan yang kontroversial ini. Perbedaan strategi ini menimbulkan gempa besar di komunitas pengguna, melahirkan gerakan “Cancel ChatGPT” yang mengumpulkan mereka yang mengecam pengabaian etika. Lebih dari sekadar perselisihan teknologi, ini adalah perpecahan mendalam mengenai nilai dan tanggung jawab yang ditimbulkan oleh babak baru ini. Ketika Claude, asisten Anthropic, naik ke puncak peringkat aplikasi, pertanyaan tentang kepercayaan terhadap raksasa AI menjadi krusial, dengan implikasi yang melampaui pasar semata dan memengaruhi citra merek serta masa depan regulasi.

Militerisasi teknologi AI konsumen menjadi isu penting dalam pilihan pengguna di tahun 2026. Di luar performa atau fitur, yang menjadi sorotan adalah pertanyaan etika, transparansi, dan tujuan akhir. Potret yang terpolarisasi antara OpenAI dan Anthropic ini juga menyoroti masalah yang lebih luas, khususnya kontrol terhadap senjata otonom, pengawasan massal, dan peran perusahaan AI terhadap badan pemerintahan. Sementara beberapa menyambut niat OpenAI untuk menerapkan pembatasan, yang lain menganggap persetujuan penggunaan militer adalah sebuah perpecahan yang menimbulkan penurunan kepercayaan nyata terhadap ChatGPT. Kasus ini menggambarkan konflik laten antara inovasi teknologi, imperatif bisnis, dan tuntutan moral di era digital.

- 1 Konsekuensi dari Perjanjian OpenAI – Departemen Pertahanan: Gerakan “Cancel ChatGPT” dan Dampaknya pada Pengguna

- 2 Anthropic: Kode Etik dan Penolakan Militerisasi Kecerdasan Buatan

- 3 Pembatasan di OpenAI: Persetujuan dan Batasan Militerisasi, Argumen Resmi

- 4 Etika dan Teknologi: Ketika Publik Umum Mengambil Alih Isu Militerisasi AI

- 5 Reaksi dan Sikap dalam Sektor Kecerdasan Buatan

- 6 Masa Depan: Era di Mana Etika Menjadi Penentu Permanen Kemitraan Strategis di AI

- 7 Langkah untuk Integrasi Etis dan Bertanggung Jawab AI dalam Sektor Strategis

- 8 Pertanyaan Umum tentang Kontroversi OpenAI, Anthropic, dan Militerisasi AI

- 8.1 Mengapa Anthropic menolak militerisasi AI mereka?

- 8.2 Jaminan apa yang diklaim OpenAI telah diperoleh dalam kemitraan militer?

- 8.3 Apa dampak kemitraan OpenAI – Departemen Pertahanan terhadap publik umum?

- 8.4 Apakah Claude dari Anthropic mendapat manfaat dari penolakan militerisasi?

- 8.5 Apa tantangan masa depan terkait militerisasi kecerdasan buatan?

Konsekuensi dari Perjanjian OpenAI – Departemen Pertahanan: Gerakan “Cancel ChatGPT” dan Dampaknya pada Pengguna

Kabar resmi kemitraan antara OpenAI dan Departemen Pertahanan Amerika memicu gelombang kejut luar biasa di komunitas pengguna kecerdasan buatan. Segera, tagar “Cancel ChatGPT” muncul di media sosial, menandakan penolakan besar-besaran dan cepat. Gelombang penghapusan dan pembatalan langganan ChatGPT Plus ini menegaskan bahwa penerimaan atau penolakan layanan kini tidak hanya didasarkan pada efektivitas teknis semata, tetapi juga pada penilaian moral terhadap nilai perusahaan.

Pengguna internet yang terlibat, terutama di X (dulu Twitter) dan Reddit, mengorganisir pembelaan keyakinan mereka dengan membagikan panduan rinci untuk mengekspor data, menghapus akun ChatGPT, dan bermigrasi ke alternatif yang dianggap lebih etis, seperti asisten Claude dari Anthropic. Misalnya, seorang pengguna mempublikasikan serangkaian tutorial video lengkap di Reddit untuk memudahkan transisi ini, sementara beberapa blog khusus membandingkan secara rinci kebijakan OpenAI dengan Anthropic, menyoroti sikap terakhir terhadap militerisasi.

Ini bukan sekadar tren sesaat. Fenomena ini merupakan kali pertama militerisasi kecerdasan buatan konsumen menjadi kriteria utama dalam loyalitas pengguna. Bahkan, beberapa komunitas internet bergerak tidak hanya untuk memprotes, tetapi juga untuk merumuskan wacana kritis terkait dampak AI terhadap keamanan global, pengawasan, dan risiko senjata otonom.

Penolakan ini juga memiliki dimensi ekonomi: Apps Store dan Play Store menyaksikan Claude, AI dari Anthropic, naik ke puncak unduhan, secara langsung mendapat keuntungan dari pengusiran moral terhadap ChatGPT. Bahkan, peningkatan ini terkadang disertai gangguan teknis, seperti kelebihan beban server akibat lonjakan pengguna baru secara tiba-tiba. Hal ini menunjukkan bahwa etika menjadi faktor kunci dalam penempatan dan daya saing solusi kecerdasan buatan.

Berikut adalah ringkasan dari konsekuensi utama gerakan “Cancel ChatGPT” :

- Lonjakan pembatalan langganan berbayar ChatGPT Plus.

- Pembuatan dan penyebaran sumber belajar untuk meninggalkan platform OpenAI secara efektif.

- Peningkatan spektakuler AI Claude dalam peringkat store aplikasi.

- Peningkatan perdebatan publik mengenai tanggung jawab perusahaan AI terhadap penggunaan militer.

- Perkuatan polarisasi pengguna sesuai dukungan atau penolakan terhadap militerisasi.

Contoh panduan untuk membatalkan ChatGPT Plus dan bermigrasi ke Claude

Panduan yang diterbitkan oleh sekelompok pengguna menekankan bahwa proses pembatalan sederhana tetapi membutuhkan beberapa tahapan kunci: mengekspor data pribadi, menghapus riwayat percakapan, menghapus aplikasi dari berbagai perangkat, lalu berlangganan Claude melalui toko resmi.

Dokumen ini tidak hanya sebatas penjelasan teknis tetapi juga menonjolkan sifat pilihan etis, “tidak lagi mendukung pihak yang menerima menyediakan kecerdasan buatan yang berpotensi digunakan dalam jaringan militer yang bersifat rahasia”.

Anthropic: Kode Etik dan Penolakan Militerisasi Kecerdasan Buatan

Anthropic, pesaing OpenAI dan pencipta Claude, mengambil sikap tegas menolak militerisasi teknologi kecerdasan buatannya. Alih-alih menandatangani perjanjian dengan Pentagon, Anthropic memilih untuk abstain, dengan alasan kurangnya jaminan yang memadai untuk mencegah pengawasan massal dan senjata otonom tanpa kontrol.

Dalam konteks pendanaan pemerintah yang bisa mencapai ratusan juta dolar, penolakan ini merupakan taruhan berisiko dalam jangka panjang. Namun, keputusan ini merupakan bagian dari strategi kualitas yang bertujuan melindungi reputasi, keamanan, dan nilai moral perusahaan.

Anthropic menekankan prinsip keselamatan sebagai landasan dari pendekatannya. Perusahaan tidak menutup kemungkinan kolaborasi militer sama sekali, tetapi memperjelas bahwa syarat mutlak adalah pengenalan pembatasan yang jelas, terkendali, dan transparan sebelum terlibat. Nuansa ini sangat penting: itu merupakan keseimbangan antara penolakan mutlak dan keterbukaan dialog mengenai aturan etis.

Berdasarkan catatan internal yang dipublikasikan, manajemen menjelaskan bahwa:

“Kami menganggap bahwa militerisasi AI tanpa kerangka kerja yang ketat dan dapat diverifikasi menimbulkan risiko terlalu besar bagi masyarakat. Tidak ada kekuatan yang seharusnya memiliki senjata sepenuhnya otonom tanpa mekanisme kontrol yang kuat.”

Sikap ini memberikan Claude citra sebagai alat etis, yang menjamin kecerdasan buatan yang bertanggung jawab dan berhati-hati dalam penciptaan dan penerapannya.

Dampak ini terasa di kalangan pengguna. Terbukti dari hasil di pasar aplikasi di mana Claude kini mendominasi App Store dan Play Store, sebagai bukti nyata dampak strategi etis terhadap perilaku konsumen.

Pendekatan Anthropic mencakup beberapa dimensi:

- Penekanan pada keselamatan dan keamanan dalam penerapan teknologi.

- Permintaan transparansi dan kontrol terhadap penggunaan yang dimaksudkan oleh aktor militer.

- Penerimaan kolaborasi bersyarat, berbeda dengan pemutusan hubungan secara permanen.

- Posisi moral sebagai keunggulan kompetitif di sektor yang harus diawasi ketat.

Biaya Penolakan: Isu Strategis dan Keuangan

Menolak kemitraan yang begitu menguntungkan dengan Departemen Pertahanan juga berarti kehilangan dana besar yang dianggap diperlukan, di sektor di mana investasi tetap prioritas untuk tetap kompetitif. Namun, pilihan ini mencerminkan posisi di mana kompromi moral diutamakan dibanding keuntungan jangka pendek.

Pada 2026, perbedaan ini menandai titik balik dalam dinamika sektor. Hal ini menimbulkan redefinisi kriteria evaluasi perusahaan AI, tidak hanya pada performa teknis tetapi juga pada etika operasional.

Pembatasan di OpenAI: Persetujuan dan Batasan Militerisasi, Argumen Resmi

OpenAI sepenuhnya mengakui kesepakatannya dengan Departemen Pertahanan Amerika Serikat. Perusahaan menyatakan telah menegosiasikan kerangka dengan lebih banyak pembatasan daripada yang ditawarkan kepada Anthropic. Mereka menegaskan bahwa perjanjian ini mengecualikan aplikasi yang terkait dengan pengawasan massal dan senjata otonom sepenuhnya.

Teks resmi menekankan bahwa penggunaan militer harus dibatasi pada operasi yang dianggap “sah”, tanpa ambiguitas mengenai penghormatan terhadap hak asasi manusia. OpenAI juga berjanji untuk mengawasi ketat kepatuhan terhadap batasan ini.

Namun, reaksi publik tetap bercampur. Ungkapan “untuk tujuan sah” dalam kontrak secara inheren bergantung pada perubahan kerangka hukum dan politik, yang memicu kecurigaan besar dari pengguna. Mereka khawatir klausul hukum dapat berubah dan memungkinkan penggunaan yang dipertanyakan di masa depan.

Lebih jauh, perubahan yang dilakukan oleh OpenAI, yang sebelumnya bersama Anthropic mendukung pendekatan ketat dalam hal keamanan, mengejutkan sebagian komunitasnya. Pergantian ini menimbulkan perasaan inkonsistensi etis yang semakin kuat di sektor yang sudah dianggap tertutup dan kompleks.

Berikut poin utama posisi OpenAI terkait persetujuannya pada militerisasi:

- Jaminan kerangka ketat yang mengecualikan pengawasan massal.

- Komitmen untuk tidak mengembangkan senjata sepenuhnya otonom.

- Pengawasan dan audit rutin atas penggunaan di Departemen Pertahanan.

- Ajakan untuk kolaborasi pragmatis guna menggabungkan inovasi dan keamanan.

- Risiko interpretasi yang bervariasi tentang apa yang “sah” dalam jangka panjang.

Mengapa Kepercayaan Pengguna Menggoyah

Kritik terhadap OpenAI tidak hanya terbatas pada masalah ini saja, tetapi berakar dalam konteks ketidakpercayaan yang lebih luas: operasi luar negeri pada data pelatihan, konsumsi energi besar, implikasi sosial dan profesional yang kompleks. Pilihan militer ini menambah beban, melemahkan kepercayaan terhadap transparansi perusahaan.

Etika dan Teknologi: Ketika Publik Umum Mengambil Alih Isu Militerisasi AI

Kasus ini menandai perubahan yang belum pernah terjadi sebelumnya dalam cara publik umum memandang isu kecerdasan buatan. Dahulu, kontroversi sering berkisar pada dimensi teknis abstrak: bias algoritma, privasi data, atau dampak lingkungan. Kini, pertanyaan militerisasi secara langsung melibatkan masyarakat sipil, dengan dampak emosional dan politik yang kuat.

Perubahan ini merupakan hasil dari kesadaran yang meningkat tentang konsekuensi potensial penggunaan yang tidak terkontrol, terutama dalam sektor sensitif seperti pertahanan. Pengguna tidak lagi hanya menginginkan performa atau inovasi, tetapi mencari keselarasan dengan nilai-nilai mereka. Mereka menyadari AI bukanlah alat netral sederhana, melainkan mengandung pilihan etis fundamental di dalamnya.

Evolusi ini memaksa para pengembang kecerdasan buatan untuk secara mendalam mengevaluasi kembali strategi bisnis mereka. Etika menjadi elemen sentral untuk mempertahankan basis pengguna yang kini tidak ragu memberi sanksi pada keputusan yang bertentangan dengan prinsip mereka.

Selain itu, terdapat isu politik yang berkembang terkait regulasi AI militer. Opini publik kini berperan dalam mempengaruhi debat legislatif dan internasional, mendorong transparansi dan aturan yang lebih ketat untuk menghindari perlombaan teknologi untuk penggunaan militer yang tak terkendali.

Pertanyaan Kunci yang Diangkat oleh Militerisasi AI :

- Peran moral perusahaan dalam merancang teknologi AI.

- Risiko kehilangan kontrol atas senjata otonom.

- Pengawasan yang meluas dan berpotensi mengganggu yang dimungkinkan oleh AI.

- Persetujuan yang terinformasi dan pemberitahuan kepada pengguna akhir.

- Kebutuhan regulasi internasional yang harmonis.

Reaksi dan Sikap dalam Sektor Kecerdasan Buatan

Di luar OpenAI dan Anthropic, seluruh sektor teknologi berada di bawah sorotan kritik terkait militerisasi kecerdasan buatan. Beberapa pemain ternama harus mengklarifikasi sikap mereka dan secara terbuka mengungkapkan mekanisme keterlibatan mereka.

Beberapa pemain kecil seperti Anthropic menarik perhatian dengan kehati-hatian dan penolakan mereka terhadap kontrak militer, memilih pengembangan yang etis dan bertanggung jawab. Sebaliknya, perusahaan besar lainnya memilih berkolaborasi dengan pemerintah, berargumen perlunya menciptakan kerangka kerja aman untuk teknologi yang berperan di bidang bernilai strategis tinggi.

Polarisasi ini juga tercermin dalam investasi finansial. Tabel komparatif berbagai kemitraan militer di sektor ini menggambarkan pilihan strategis perusahaan AI:

| Perusahaan | Kemitraan Militer | Sikap Etis | Jumlah (Juta $) |

|---|---|---|---|

| OpenAI | Ya, dengan Departemen Pertahanan AS | Persetujuan dengan pembatasan | 200 |

| Anthropic | Tidak, penolakan hati-hati | Tolak tanpa kesepakatan | 0 |

| Google DeepMind | Kolaborasi terbatas, pengawasan | Sikap campuran, kontrol diperketat | 150 |

| Microsoft | Integrasi AI ke militer AS | Persetujuan ketat | 180 |

Investor teknologi, seperti Aidan Gold, juga berkomentar secara publik mengenai dilema moral yang dialami OpenAI sebelum penandatanganan perjanjian tersebut. Mereka menyoroti ironi dukungan publik sementara terhadap posisi Anthropic dalam keamanan sebelum perubahan arah secara drastis.

Masa Depan: Era di Mana Etika Menjadi Penentu Permanen Kemitraan Strategis di AI

Kasus OpenAI-Anthropic menyoroti munculnya era baru dimana militerisasi AI menjadi ujian moral yang sesungguhnya. Perusahaan tidak lagi hanya dapat mengandalkan janji teknologi: kini mereka dinilai juga atas kemampuan menyelaraskan keputusan strategis dengan etika yang diakui oleh pengguna mereka.

Contoh terbaru menunjukkan bahwa tuntutan ini bukanlah hambatan tetapi peluang. Bagi Anthropic, menolak kontrak pemerintah besar mencerminkan kekuatan karakter dan niat jelas untuk memposisikan diri di panggung internasional sebagai aktor yang bertanggung jawab.

Bagi OpenAI, tantangan lebih kompleks. Waktu akan menunjukkan apakah persetujuan terhadap kemitraan militer ini, dengan klausul terbatasnya, dapat meyakinkan komunitas dan mempertahankan kepercayaan. Yang pasti, perjuangan untuk etika kini berada di jantung strategi perusahaan.

Titik balik ini juga membuka jalan untuk dialog yang diperkaya antara otoritas publik, pelaku swasta, dan masyarakat sipil. Tekanan untuk menetapkan regulasi internasional tentang AI dan penggunaannya dalam militer semakin intensif bersamaan dengan reaksi populer. Pasar tidak lagi dapat mengabaikan dimensi etika ini tanpa risiko memecah basis penggunanya secara permanen.

Kecerdasan buatan, jauh dari sekadar alat biasa, harus kini dipandang sebagai keseluruhan dimana setiap evolusi teknis membawa tanggung jawab sosial besar, yang memerlukan persetujuan yang terinformasi dan kolektif.

Langkah untuk Integrasi Etis dan Bertanggung Jawab AI dalam Sektor Strategis

Untuk menjamin keseimbangan antara inovasi teknologi dan tuntutan moral, beberapa langkah dapat dipertimbangkan :

- Menetapkan standar internasional yang ketat untuk mengatur penggunaan AI di bidang militer, khususnya mengenai senjata otonom dan pengawasan.

- Memperkuat transparansi kontrak dan tujuan penggunaan antara perusahaan dan pemerintah.

- Melibatkan pengguna akhir dalam debat etis melalui konsultasi dan informasi aktif.

- Mengembangkan sistem audit independen untuk memastikan pemenuhan komitmen.

- Mendorong kemitraan antara peneliti, regulator, dan industri untuk menyelaraskan pengembangan dan kontrol.

- Mengadopsi komunikasi yang jelas untuk menolak ambiguitas dan menjaga kepercayaan.

Berikut ini tabel ringkasan risiko, tantangan, dan solusi terkait militerisasi AI :

| Risiko | Tantangan | Solusi yang Mungkin |

|---|---|---|

| Senjata otonom tanpa kontrol | Keamanan global, stabilitas internasional | Penerapan perjanjian, larangan tegas |

| Pengawasan massal yang mengganggu | Perlindungan hak sipil, privasi | Legislasi ketat, kendali demokratis |

| Hilangnya kepercayaan pengguna | Aksesibilitas sosial dan komersial | Transparansi, dialog, edukasi |

| Pemanfaatan untuk tujuan ilegal | Etika dan legalitas | Audit independen, sanksi |

Pertanyaan Umum tentang Kontroversi OpenAI, Anthropic, dan Militerisasi AI

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Mengapa Anthropic menolak militerisasi AI mereka?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Anthropic menentang militerisasi AI mereka oleh Pentagon karena jaminan yang tidak memadai untuk pencegahan pengawasan massal dan kontrol senjata otonom. Perusahaan memilih komitmen hanya dengan pembatasan ketat untuk memastikan keselamatan dan keamanan.”}},{“@type”:”Question”,”name”:”Jaminan apa yang diklaim OpenAI telah diperoleh dalam kemitraan militer?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”OpenAI mengklaim bahwa perjanjian mereka mengecualikan penggunaan terkait pengawasan massal dan senjata otonom sepenuhnya, serta menyediakan kontrol ketat dan kerangka hukum yang membatasi penggunaan militer untuk tujuan sah.”}},{“@type”:”Question”,”name”:”Apa dampak kemitraan OpenAI – Departemen Pertahanan terhadap publik umum?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Kemitraan ini memicu gerakan protes bernama ‘Cancel ChatGPT’ di mana pengguna meninggalkan platform untuk alternatif yang dianggap lebih etis, membawa ulang debat moral terkait AI dan penggunaannya dalam militer.”}},{“@type”:”Question”,”name”:”Apakah Claude dari Anthropic mendapat manfaat dari penolakan militerisasi?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Ya, Claude mengalami kenaikan signifikan dalam peringkat aplikasi, terutama di App Store, berkat citranya sebagai AI yang lebih etis, yang menyoroti pentingnya faktor etika dalam pilihan pengguna.”}},{“@type”:”Question”,”name”:”Apa tantangan masa depan terkait militerisasi kecerdasan buatan?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Tantangan masa depan meliputi penetapan standar internasional, transparansi kemitraan, partisipasi pengguna dalam debat etis, dan pengembangan sistem audit untuk mencegah penyalahgunaan dan mempertahankan kepercayaan.”}}]}Mengapa Anthropic menolak militerisasi AI mereka?

Anthropic menentang militerisasi AI mereka oleh Pentagon karena jaminan yang tidak memadai untuk pencegahan pengawasan massal dan kontrol senjata otonom. Perusahaan memilih komitmen hanya dengan pembatasan ketat untuk memastikan keselamatan dan keamanan.

Jaminan apa yang diklaim OpenAI telah diperoleh dalam kemitraan militer?

OpenAI mengklaim bahwa perjanjian mereka mengecualikan penggunaan terkait pengawasan massal dan senjata otonom sepenuhnya, serta menyediakan kontrol ketat dan kerangka hukum yang membatasi penggunaan militer untuk tujuan sah.

Apa dampak kemitraan OpenAI – Departemen Pertahanan terhadap publik umum?

Kemitraan ini memicu gerakan protes bernama ‘Cancel ChatGPT’ di mana pengguna meninggalkan platform untuk alternatif yang dianggap lebih etis, membawa ulang debat moral terkait AI dan penggunaannya dalam militer.

Apakah Claude dari Anthropic mendapat manfaat dari penolakan militerisasi?

Ya, Claude mengalami kenaikan signifikan dalam peringkat aplikasi, terutama di App Store, berkat citranya sebagai AI yang lebih etis, yang menyoroti pentingnya faktor etika dalam pilihan pengguna.

Apa tantangan masa depan terkait militerisasi kecerdasan buatan?

Tantangan masa depan meliputi penetapan standar internasional, transparansi kemitraan, partisipasi pengguna dalam debat etis, dan pengembangan sistem audit untuk mencegah penyalahgunaan dan mempertahankan kepercayaan.