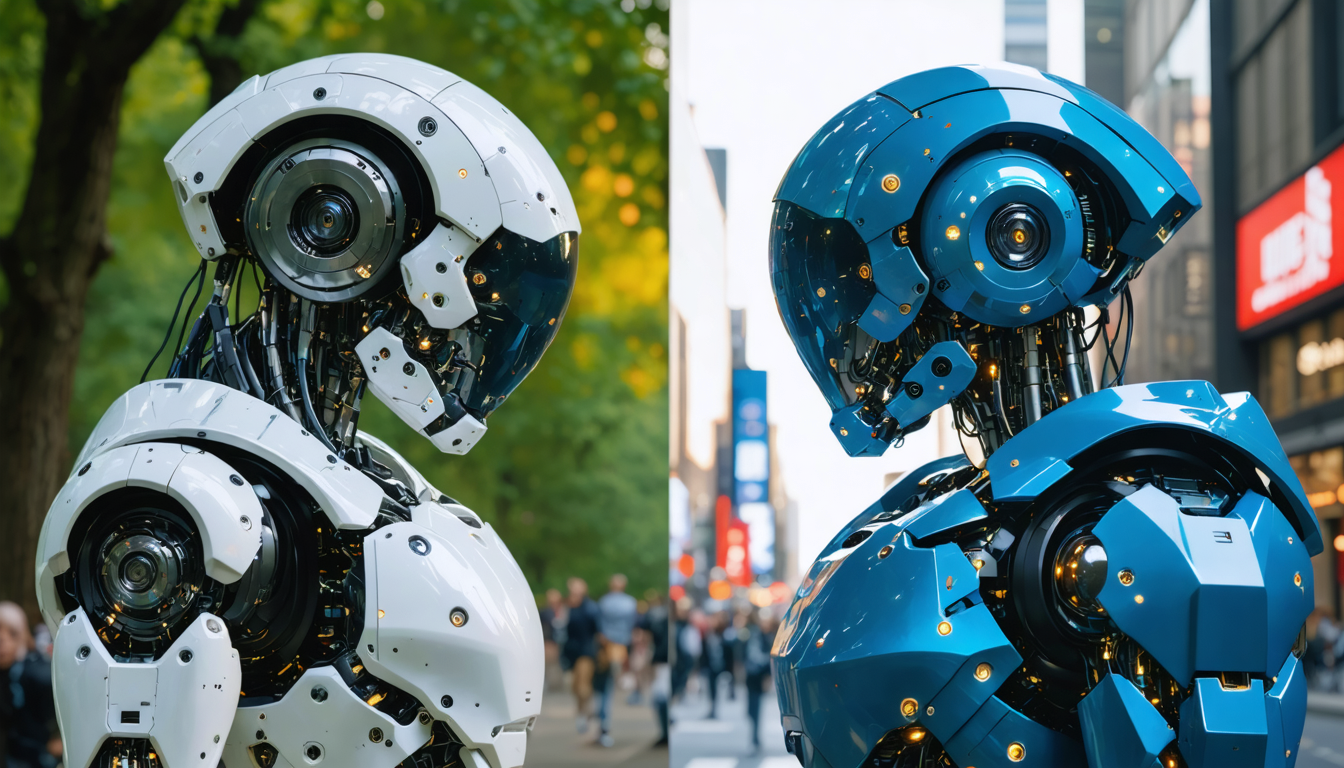

A nova aliança entre a OpenAI e o Departamento de Guerra dos Estados Unidos levanta um grande debate no início de 2026: será aceitável que tecnologias populares de inteligência artificial se tornem ferramentas militares? Enquanto a Anthropic, um concorrente importante no campo da IA, recusa categoricamente participar da militarização de seus modelos, a OpenAI dá seu consentimento a uma parceria controversa. Essa divergência estratégica provoca um verdadeiro abalo na comunidade de usuários, dando origem ao movimento “Cancel ChatGPT”, que reúne aqueles que denunciam um abandono ético. Mais do que uma simples disputa tecnológica, trata-se de uma ruptura profunda sobre valores e responsabilidades suscitada por essa mudança. Enquanto Claude, o assistente da Anthropic, sobe ao topo dos rankings de aplicativos, a questão da confiança nos gigantes da IA torna-se crucial, com implicações que vão além do mercado e afetam a imagem da marca e o futuro da regulamentação.

A militarização das tecnologias de IA de uso popular torna-se uma questão decisiva nas escolhas dos usuários em 2026. Além de desempenho ou funcionalidades, são as questões éticas, de transparência e de finalidades que se impõem. Este retrato polarizado entre OpenAI e Anthropic também ilumina problemáticas mais amplas, especialmente sobre o controle de armas autônomas, vigilância em massa e o papel das empresas de IA perante as administrações governamentais. Enquanto alguns saudam a vontade de estabelecer salvaguardas na OpenAI, outros consideram que o simples consentimento a um uso militar constitui uma ruptura, fonte de uma evidente perda de entusiasmo em relação ao ChatGPT. Este caso ilustra implicitamente o conflito latente entre inovação tecnológica, imperativos comerciais e exigências morais na era digital.

- 1 Consequências do acordo OpenAI – Departamento de Guerra: movimento “Cancel ChatGPT” e impacto sobre os usuários

- 2 Anthropic: ética e recusa da militarização da inteligência artificial

- 3 As salvaguardas na OpenAI: consentimento e limites à militarização, o argumento oficial

- 4 Ética e tecnologia: quando o grande público se apropria das questões de militarização da IA

- 5 Reações e posicionamentos no setor da inteligência artificial

- 6 O futuro: uma era em que a ética condiciona duradouramente as parcerias estratégicas em IA

- 7 Pistas para uma integração ética e responsável da IA em setores estratégicos

- 8 Perguntas frequentes sobre a controvérsia OpenAI, Anthropic e a militarização da IA

- 8.1 Por que a Anthropic recusou a militarização de sua IA?

- 8.2 Quais garantias a OpenAI afirma ter obtido na parceria militar?

- 8.3 Qual é o impacto da parceria OpenAI – Departamento de Guerra no público geral?

- 8.4 Claude da Anthropic se beneficiou da recusa da militarização?

- 8.5 Quais são os futuros desafios para a militarização da inteligência artificial?

Consequências do acordo OpenAI – Departamento de Guerra: movimento “Cancel ChatGPT” e impacto sobre os usuários

O anúncio oficial da parceria entre OpenAI e o Departamento de Guerra americano desencadeou uma onda de choque sem precedentes na comunidade de usuários de inteligência artificial. Imediatamente, a hashtag “Cancel ChatGPT” surgiu nas redes sociais, traduzindo uma contestação massiva e rápida. Essa onda de desinstalações e cancelamentos de assinaturas do ChatGPT Plus destaca que a aceitação ou rejeição de um serviço não se limita mais à sua eficácia técnica, mas agora está ancorada em um julgamento moral sobre os valores da empresa.

Usuários engajados, principalmente no X (ex-Twitter) e Reddit, organizaram a defesa de suas convicções compartilhando guias detalhados para exportar seus dados, excluir sua conta do ChatGPT e migrar para alternativas consideradas mais éticas, como o assistente Claude da Anthropic. Por exemplo, um usuário publicou uma série completa de tutoriais em vídeo no Reddit para facilitar essa transição, enquanto vários blogs especializados compararam em detalhes as políticas da OpenAI e da Anthropic, destacando a posição desta última em relação à militarização.

Não se trata apenas de uma moda passageira. Esse fenômeno representa a primeira vez em que a militarização da inteligência artificial de uso popular se torna um critério fundamental na fidelidade dos usuários. De fato, algumas comunidades de internautas mobilizaram-se não apenas para protestar, mas também para estruturar um discurso crítico relacionado ao impacto da IA na segurança global, vigilância e riscos ligados às armas autônomas.

Essa contestação também assumiu uma dimensão econômica: a App Store e a Play Store viram Claude, a IA da Anthropic, subir para o topo das downloads, beneficiando-se diretamente da exclusão moral do ChatGPT. Aliás, é significativo que essa ascensão às vezes se acompanhe de rupturas técnicas, como sobrecarga de servidores devido ao súbito afluxo de novos usuários. Observa-se assim que a ética torna-se um fator chave no posicionamento e competitividade das soluções de inteligência artificial.

Aqui está um resumo das principais consequências do movimento “Cancel ChatGPT” :

- Multiplicação dos cancelamentos de assinaturas pagas do ChatGPT Plus.

- Criação e divulgação de recursos pedagógicos para deixar a plataforma OpenAI de forma eficaz.

- Ascensão espetacular da IA Claude nos rankings das lojas de aplicativos.

- Reforço do debate público sobre a responsabilidade das empresas de IA em relação aos usos militares.

- Reforço da polarização entre usuários conforme sua adesão ou rejeição à militarização.

Exemplo de um guia para cancelar o ChatGPT Plus e migrar para o Claude

O guia publicado por um grupo de usuários destaca que o processo de cancelamento é simples, mas exige seguir várias etapas chave: exportar os dados pessoais, excluir o histórico de conversas, desinstalar os aplicativos em vários dispositivos e então assinar o Claude pelas lojas oficiais.

Este documento não se limita a uma explicação técnica, mas também destaca a natureza da escolha ética, “não mais apoiar um ator que aceita fornecer uma inteligência artificial potencialmente implantada em redes militares classificadas”.

Anthropic: ética e recusa da militarização da inteligência artificial

A Anthropic, empresa concorrente da OpenAI e criadora do Claude, adotou uma posição firmemente contrária à militarização de suas tecnologias de inteligência artificial. Em vez de assinar um acordo com o Pentágono, a Anthropic preferiu abster-se, alegando falta de garantias suficientes para prevenir a vigilância em massa e armas autônomas sem controle.

Em um contexto em que os financiamentos governamentais podem representar até centenas de milhões de dólares, essa recusa constitui uma aposta arriscada a longo prazo. Contudo, essa decisão se insere em uma estratégia qualitativa visando proteger a reputação, segurança e valores morais da empresa.

A Anthropic destaca o princípio da segurança como pedra angular de sua abordagem. A empresa não fecha a porta para toda colaboração militar, mas coloca como condição sine qua non a instauração de salvaguardas claras, controladas e transparentes antes de se engajar. Essa nuance é fundamental: constitui um equilíbrio entre recusa categórica e abertura a um diálogo sobre regras éticas.

Segundo uma nota interna tornada pública, a direção esclarece que:

“Consideramos que a militarização das IA sem um quadro estrito e verificável apresenta riscos muito altos para a sociedade. Nenhuma potência deveria dispor de armas totalmente autônomas sem mecanismos robustos de controle.”

Esse posicionamento confere ao Claude a imagem de uma ferramenta ética, garantidora de uma inteligência artificial responsável e prudente em sua elaboração e implantação.

O efeito é sentido entre os usuários. Atestam isso os impactos nos mercados de aplicativos onde Claude domina agora a App Store e a Play Store, elementos concretos que ilustram o impacto de uma estratégia ética no comportamento dos consumidores.

A abordagem da Anthropic articula várias dimensões:

- Ênfase na segurança e proteção dos desdobramentos.

- Pedido de transparência e controle sobre a utilização prevista pelos atores militares.

- Aceitação de uma colaboração condicional, ao contrário de uma ruptura definitiva.

- Posicionamento moral como vantagem competitiva em um setor a ser monitorado.

O custo da recusa: desafios estratégicos e financeiros

Recusar uma parceria tão lucrativa com o Departamento de Guerra também significa uma perda importante de financiamento considerado útil, em um setor onde o investimento continua prioridade para se manter competitivo. No entanto, essa escolha ilustra um posicionamento em que compromissos morais são privilegiados em relação aos ganhos de curto prazo.

Em 2026, essa divergência marca uma virada na dinâmica do setor. Ela provoca uma redefinição dos critérios de avaliação das empresas de IA, não apenas em suas performances técnicas, mas também em sua ética operacional.

As salvaguardas na OpenAI: consentimento e limites à militarização, o argumento oficial

A OpenAI assume totalmente seu acordo com o Ministério da Defesa americano. A empresa afirma ter negociado um quadro contendo mais salvaguardas do que as propostas à Anthropic. Esclarece que esse acordo exclui aplicações relacionadas à vigilância em massa e armas totalmente autônomas.

O texto oficial enfatiza que os usos militares devem se limitar a operações consideradas “lícitas”, sem ambiguidade quanto ao respeito aos direitos humanos. A OpenAI também promete monitorar de perto o cumprimento desses limites.

No entanto, a reação no espaço público permanece mista. A expressão “para fins lícitos” em um contrato é intrinsecamente submetida às evoluções do quadro legal e político, o que gera uma desconfiança importante por parte dos usuários. Estes temem que uma cláusula jurídica possa evoluir e permitir usos contestáveis no futuro.

Ainda mais, a virada operada pela OpenAI, que até então defendia com a Anthropic uma abordagem estrita em matéria de segurança, choca parte da sua comunidade. Essa reviravolta alimenta um sentimento de incoerência ética que se amplifica em um setor já tido como opaco e complexo.

Aqui estão os pontos principais da posição da OpenAI quanto ao seu consentimento à militarização:

- Garantia de um quadro estrito que exclui a vigilância em massa.

- Compromisso de não desenvolver armas totalmente autônomas.

- Controle e auditorias regulares sobre as utilizações dentro do Departamento de Guerra.

- Apelo a uma colaboração pragmática para aliar inovação e segurança.

- Risco de interpretação variável do que é “lícito” a longo prazo.

Por que a confiança dos usuários vacila

As críticas dirigidas à OpenAI não se limitam a este único caso, mas se inscrevem em um contexto mais amplo de desconfiança: uso das bases de treinamento, alto consumo energético, implicações sociais e profissionais complexas. O viés militar adiciona um peso extra, fragilizando a confiança na transparência da empresa.

Ética e tecnologia: quando o grande público se apropria das questões de militarização da IA

Esse caso marcou uma virada inédita na forma como o grande público percebe os desafios da inteligência artificial. No passado, as controvérsias geralmente diziam respeito a dimensões técnicas abstratas: vieses algorítmicos, confidencialidade dos dados ou impacto ambiental. Hoje, a questão da militarização envolve a sociedade civil de forma direta, com forte impacto emocional e político.

Essa mudança resulta de uma consciência maior sobre as consequências potenciais de um uso não regulado, especialmente em um setor sensível como a defesa. Os usuários não buscam mais apenas desempenho ou inovação, mas um alinhamento com seus valores. Eles percebem que as IAs não são meras ferramentas neutras, mas carregam escolhas éticas fundamentais.

Essa evolução impõe aos desenvolvedores de inteligência artificial que reavaliem profundamente sua estratégia comercial. A ética torna-se um elemento central para reter uma base de usuários que não hesita mais em punir decisões contrárias aos seus princípios.

Note-se também uma questão política crescente em torno da regulamentação da IA militar. A opinião pública agora contribui para pesar nos debates legislativos e internacionais, incitando à transparência e a regras mais estritas para evitar uma corrida desenfreada às tecnologias de uso militar.

As questões-chave levantadas pela militarização da IA:

- O papel moral das empresas na concepção das tecnologias de IA.

- Os riscos ligados à perda de controle sobre armas autônomas.

- A vigilância ampliada e potencialmente intrusiva permitida pela IA.

- O consentimento informado e a informação dos usuários finais.

- A necessidade de uma regulamentação internacional harmonizada.

Reações e posicionamentos no setor da inteligência artificial

Além da OpenAI e da Anthropic, todo o setor tecnológico está sob fogo das críticas sobre a questão da militarização das inteligências artificiais. Vários atores renomados tiveram que esclarecer sua posição e expor publicamente seus termos de engajamento.

Alguns pequenos atores, como a Anthropic, seduzem pela prudência e pela recusa de contratos militares, privilegiando um desenvolvimento ético e responsável. Em contrapartida, outras grandes empresas optam por colaborar com governos, argumentando a necessidade de criar quadros seguros para tecnologias que atuam em domínios de alto valor estratégico.

Essa polarização reflete-se também no investimento financeiro. Uma tabela comparativa dos diferentes contratos militares no setor ilustra as escolhas estratégicas das empresas de IA:

| Empresa | Parceria Militar | Posição Ética | Montante (M$) |

|---|---|---|---|

| OpenAI | Sim, com o Departamento de Guerra dos EUA | Consentimento com salvaguardas | 200 |

| Anthropic | Não, recusa prudencial | Rejeição sem acordo | 0 |

| Google DeepMind | Colaboração limitada, vigilância | Posição mitigada, controle reforçado | 150 |

| Microsoft | Integração de IA nas forças armadas dos EUA | Consentimento estrito | 180 |

Investidores tecnológicos, como Aidan Gold, também se expressam publicamente sobre o dilema moral vivido pela OpenAI antes da assinatura do acordo. Destacam especialmente a ironia de um apoio público temporário à posição da Anthropic sobre segurança antes da súbita mudança de direção.

O futuro: uma era em que a ética condiciona duradouramente as parcerias estratégicas em IA

O caso OpenAI-Anthropic destaca a ascensão de uma nova era em que a militarização da IA se torna um verdadeiro teste moral. As empresas não podem mais se contentar com a promessa tecnológica: são agora julgadas também pela capacidade de alinhar suas decisões estratégicas com uma ética reconhecida por seus usuários.

Exemplos recentes mostram que essa exigência não é um obstáculo, mas uma oportunidade. Para a Anthropic, recusar um contrato governamental importante traduz uma força de caráter e uma vontade clara de se posicionar no cenário internacional como um ator responsável.

Para a OpenAI, o desafio é mais complexo. O futuro dirá se o consentimento a essa parceria militar, com suas cláusulas restritivas, conseguirá convencer a comunidade e preservar a confiança. Em todo caso, a luta pela ética está agora no coração das estratégias empresariais.

Essa virada também abre caminho para um diálogo enriquecido entre autoridades públicas, atores privados e sociedade civil. A pressão para implementar regulamentações internacionais sobre IA e seus usos militares se intensifica paralelamente às reações populares. O mercado não poderá mais ignorar essa dimensão ética sem arriscar romper duradouramente sua base de usuários.

A inteligência artificial, longe de ser uma simples ferramenta, deve agora ser vista como um conjunto cujas evoluções técnicas envolvem responsabilidades sociais importantes, que devem ser objeto de consentimento esclarecido e coletivo.

Pistas para uma integração ética e responsável da IA em setores estratégicos

Para garantir um equilíbrio entre inovação tecnológica e exigências morais, podem ser consideradas várias pistas:

- Estabelecer normas internacionais estritas que regulem o uso das IAs no âmbito militar, especialmente no que se refere a armas autônomas e vigilância.

- Reforçar a transparência nos contratos e finalidades de uso entre empresas e administrações.

- Incluir os usuários finais nos debates éticos, por meio de consultas e informação ativa.

- Desenvolver sistemas de auditoria independentes que verifiquem o cumprimento dos compromissos assumidos.

- Fomentar parcerias entre pesquisadores, reguladores e indústrias para alinhar desenvolvimento e controle.

- Adotar uma comunicação clara para evitar ambiguidades e preservar a confiança.

Aqui está uma tabela sintética dos riscos, desafios e soluções ligados à militarização das IAs :

| Riscos | Desafios | Soluções possíveis |

|---|---|---|

| Armas autônomas não controladas | Segurança global, estabilidade internacional | Implementação de tratados, proibições claras |

| Vigilância em massa intrusiva | Respeito aos direitos civis, privacidade | Legislação rigorosa, controle democrático |

| Perda da confiança dos usuários | Aceitabilidade social e comercial | Transparência, diálogo, educação |

| Uso para fins ilegais | Ética e legalidade | Auditorias independentes, sanções |

Perguntas frequentes sobre a controvérsia OpenAI, Anthropic e a militarização da IA

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Por que a Anthropic recusou a militarização de sua IA?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”A Anthropic se opôs à militarização de sua IA pelo Pentágono devido a garantias insuficientes para prevenir a vigilância em massa e o controle de armas autônomas. A empresa privilegia um compromisso apenas sob salvaguardas estritas para assegurar segurança e proteção.”}},{“@type”:”Question”,”name”:”Quais garantias a OpenAI afirma ter obtido na parceria militar?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”A OpenAI afirma que seu acordo exclui usos relacionados à vigilância em massa e armas totalmente autônomas, prevendo um controle rígido e um quadro legal que limita os usos militares a fins lícitos.”}},{“@type”:”Question”,”name”:”Qual é o impacto da parceria OpenAI – Departamento de Guerra no público geral?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”A parceria provocou um movimento de contestação chamado ‘Cancel ChatGPT’, onde usuários deixaram a plataforma por alternativas consideradas mais éticas, colocando no centro dos debates a questão moral ligada à IA e seu uso militar.”}},{“@type”:”Question”,”name”:”Claude da Anthropic se beneficiou da recusa da militarização?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Sim, Claude teve um forte progresso nos rankings de aplicativos, especialmente na App Store, graças à sua imagem de IA mais ética, o que ilustra a importância do fator ético nas escolhas dos usuários.”}},{“@type”:”Question”,”name”:”Quais são os futuros desafios para a militarização da inteligência artificial?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Os futuros desafios incluem o estabelecimento de normas internacionais, transparência nas parcerias, participação dos usuários nos debates éticos e o desenvolvimento de sistemas de auditoria para prevenir abusos e preservar a confiança.”}}]}Por que a Anthropic recusou a militarização de sua IA?

A Anthropic se opôs à militarização de sua IA pelo Pentágono devido a garantias insuficientes para prevenir a vigilância em massa e o controle de armas autônomas. A empresa privilegia um compromisso apenas sob salvaguardas estritas para assegurar segurança e proteção.

Quais garantias a OpenAI afirma ter obtido na parceria militar?

A OpenAI afirma que seu acordo exclui usos relacionados à vigilância em massa e armas totalmente autônomas, prevendo um controle rígido e um quadro legal que limita os usos militares a fins lícitos.

Qual é o impacto da parceria OpenAI – Departamento de Guerra no público geral?

A parceria provocou um movimento de contestação chamado ‘Cancel ChatGPT’, onde usuários deixaram a plataforma por alternativas consideradas mais éticas, colocando no centro dos debates a questão moral ligada à IA e seu uso militar.

Claude da Anthropic se beneficiou da recusa da militarização?

Sim, Claude teve um forte progresso nos rankings de aplicativos, especialmente na App Store, graças à sua imagem de IA mais ética, o que ilustra a importância do fator ético nas escolhas dos usuários.

Quais são os futuros desafios para a militarização da inteligência artificial?

Os futuros desafios incluem o estabelecimento de normas internacionais, transparência nas parcerias, participação dos usuários nos debates éticos e o desenvolvimento de sistemas de auditoria para prevenir abusos e preservar a confiança.