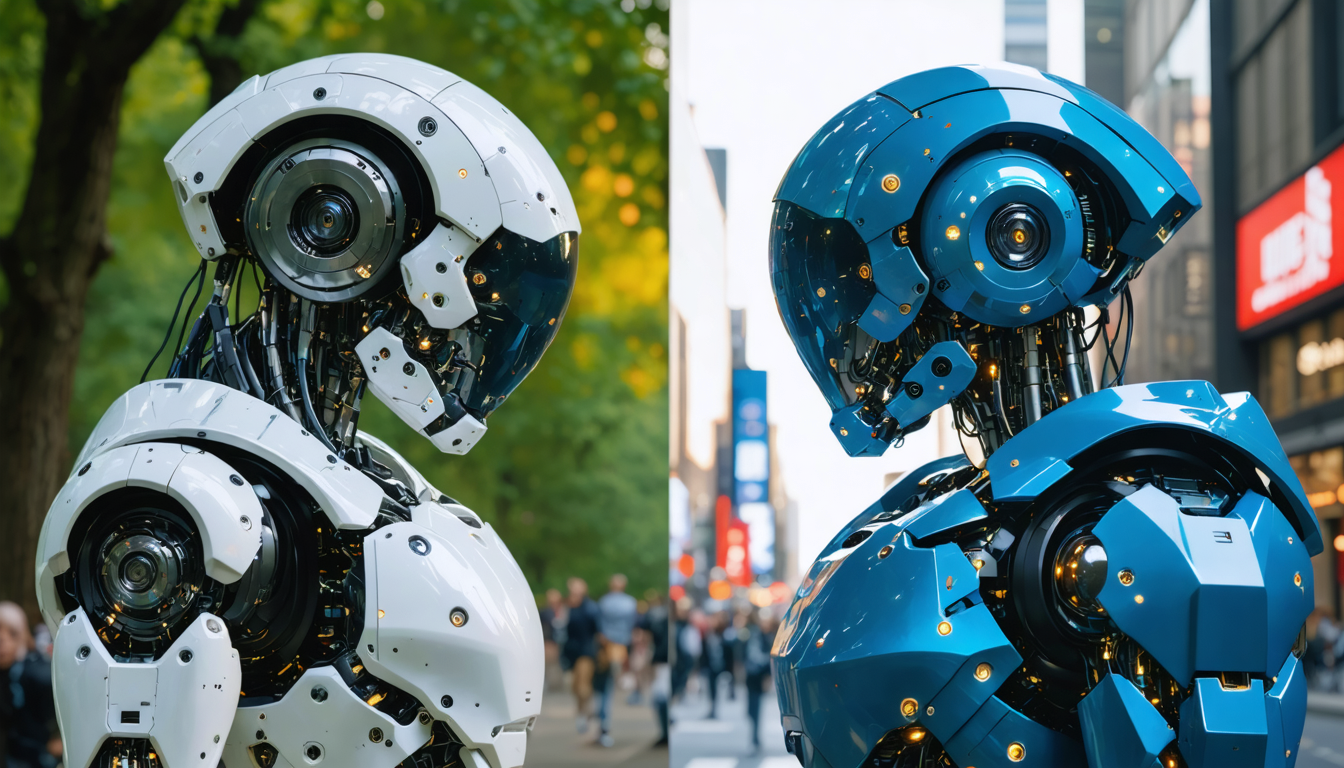

La nueva alianza entre OpenAI y el Departamento de Guerra de los Estados Unidos genera un debate importante a principios de 2026: ¿es aceptable que tecnologías populares de inteligencia artificial se conviertan en herramientas militares? Mientras que Anthropic, un competidor importante en el ámbito de la IA, rechaza categóricamente participar en la militarización de sus modelos, OpenAI da su consentimiento a una asociación controvertida. Esta divergencia estratégica provoca un verdadero terremoto en la comunidad de usuarios, dando origen al movimiento «Cancel ChatGPT» que reúne a quienes denuncian un abandono ético. Más que una simple disputa tecnológica, es una fractura profunda sobre los valores y responsabilidades que suscita este giro. Mientras Claude, el asistente de Anthropic, asciende a la cabeza del ranking de aplicaciones, la cuestión de la confianza en los gigantes de la IA se vuelve crucial, con implicaciones que van más allá del mercado y afectan la imagen de marca y el futuro de la regulación.

La militarización de las tecnologías de IA de uso general se convierte en un desafío decisivo en las elecciones de los usuarios en 2026. Más allá del rendimiento o las funcionalidades, son las cuestiones éticas, la transparencia y los fines lo que se impone. Este retrato polarizado entre OpenAI y Anthropic también ilumina problemáticas más amplias, especialmente las relacionadas con el control de armas autónomas, la vigilancia masiva y el papel de las empresas de IA frente a las administraciones gubernamentales. Mientras que algunos saludan la voluntad de establecer salvaguardas en OpenAI, otros consideran que el simple consentimiento a un uso militar constituye una ruptura, fuente de una evidente desafección hacia ChatGPT. Este caso ilustra implícitamente el conflicto latente entre innovación tecnológica, imperativos comerciales y exigencias morales en la era digital.

- 1 Consecuencias del acuerdo OpenAI – Departamento de Guerra: movimiento «Cancel ChatGPT» e impacto en los usuarios

- 2 Anthropic: deontología y rechazo a la militarización de la inteligencia artificial

- 3 Las salvaguardas en OpenAI: consentimiento y límites a la militarización, el argumento oficial

- 4 Ética y tecnología: cuando el gran público se apropia de las cuestiones de militarización de la IA

- 5 Reacciones y posicionamientos en el sector de la inteligencia artificial

- 6 El futuro: una era donde la ética condiciona duraderamente las asociaciones estratégicas en IA

- 7 Vías para una integración ética y responsable de la IA en sectores estratégicos

- 8 Preguntas frecuentes sobre la controversia OpenAI, Anthropic y la militarización de la IA

- 8.1 ¿Por qué Anthropic rechazó la militarización de su IA?

- 8.2 ¿Qué garantías afirma haber obtenido OpenAI en la asociación militar?

- 8.3 ¿Cuál es el impacto de la asociación OpenAI – Departamento de Guerra en el gran público?

- 8.4 ¿Claude de Anthropic se benefició del rechazo a la militarización?

- 8.5 ¿Cuáles son los retos futuros para la militarización de la inteligencia artificial?

Consecuencias del acuerdo OpenAI – Departamento de Guerra: movimiento «Cancel ChatGPT» e impacto en los usuarios

El anuncio oficial de la asociación entre OpenAI y el Departamento estadounidense de Guerra ha desatado una ola de choque sin precedentes en la comunidad de usuarios de inteligencia artificial. Inmediatamente, el hashtag “Cancel ChatGPT” emergió en las redes sociales, traduciendo una contestación masiva y rápida. Esta ola de desinstalaciones y cancelaciones de suscripciones a ChatGPT Plus subraya que la aceptación o el rechazo de un servicio ya no se limita a su eficacia técnica, sino que ahora se ancla en un juicio moral sobre los valores de la empresa.

Usuarios comprometidos, principalmente en X (ex-Twitter) y Reddit, han organizado la defensa de sus convicciones compartiendo guías detalladas para exportar sus datos, borrar su cuenta de ChatGPT y migrar hacia alternativas consideradas más éticas, como el asistente Claude de Anthropic. Por ejemplo, un usuario ha publicado una serie completa de tutoriales en video en Reddit para facilitar esta transición, mientras que varios blogs especializados han comparado en detalle la política de OpenAI con la de Anthropic, destacando la postura de esta última frente a la militarización.

No se trata solo de una moda pasajera. Este fenómeno encarna la primera vez que la militarización de la inteligencia artificial de uso general se convierte en un criterio fundamental en la fidelidad de los usuarios. De hecho, ciertas comunidades de internautas se han movilizado no solo para protestar, sino también para estructurar un discurso crítico relacionado con el impacto de la IA en la seguridad global, la vigilancia y los riesgos asociados a las armas autónomas.

Esta contestación también ha tomado una dimensión económica: Apps Store y Play Store han visto a Claude, la IA de Anthropic, ascender a la cima de las descargas, aprovechando directamente la expulsión moral de ChatGPT. Además, es significativo que este ascenso a veces se acompañe de fallos técnicos, como sobrecargas de servidores debido al súbito flujo de nuevos usuarios. Se observa así que la ética se convierte en un factor clave en el posicionamiento y la competitividad de las soluciones de inteligencia artificial.

A continuación, un resumen de las principales consecuencias del movimiento “Cancel ChatGPT” :

- Multiplicación de cancelaciones de suscripciones pagas a ChatGPT Plus.

- Creación y difusión de recursos pedagógicos para abandonar la plataforma OpenAI eficazmente.

- Subida espectacular de la IA Claude en los rankings de tiendas de aplicaciones.

- Reforzamiento del debate público sobre la responsabilidad de las empresas de IA frente a los usos militares.

- Refuerzo de la polarización entre usuarios según su adhesión o rechazo a la militarización.

Ejemplo de una guía para cancelar ChatGPT Plus y migrar a Claude

La guía publicada por un grupo de usuarios destaca que el proceso de cancelación es simple pero requiere seguir varios pasos clave: exportar los datos personales, borrar el historial de conversaciones, desinstalar las aplicaciones en varios dispositivos y luego suscribirse a Claude a través de las tiendas oficiales.

Este documento no se limita a una explicación técnica, sino que también subraya la naturaleza de la elección ética, «no apoyar más a un actor que acepta proporcionar una inteligencia artificial potencialmente desplegada en redes militares clasificadas».

Anthropic: deontología y rechazo a la militarización de la inteligencia artificial

Anthropic, empresa competidora de OpenAI y creadora de Claude, ha adoptado una posición firmemente opuesta a la militarización de sus tecnologías de inteligencia artificial. En lugar de firmar un acuerdo con el Pentágono, Anthropic prefirió abstenerse, invocando la falta de garantías suficientes para prevenir la vigilancia masiva y las armas autónomas sin control.

En un contexto donde los financiamientos gubernamentales pueden representar hasta cientos de millones de dólares, este rechazo constituye una apuesta arriesgada a largo plazo. Sin embargo, esta decisión forma parte de una estrategia cualitativa destinada a proteger la reputación, la seguridad y los valores morales de la empresa.

Anthropic pone en valor el principio de seguridad como piedra angular de su enfoque. La empresa no cierra la puerta a toda colaboración militar, pero establece como condición sine qua non el establecimiento de salvaguardas claras, controladas y transparentes antes de comprometerse. Esta distinción es fundamental: representa un equilibrio entre el rechazo categórico y la apertura a un diálogo sobre reglas éticas.

Según una nota interna hecha pública, la dirección precisa que:

«Consideramos que la militarización de las IA sin un marco estricto y verificable presenta riesgos demasiado altos para la sociedad. Ninguna potencia debería disponer de armas totalmente autónomas sin mecanismos de control robustos.»

Esta postura confiere a Claude una imagen de herramienta ética, garante de una inteligencia artificial responsable y prudente en su elaboración y despliegue.

El efecto se siente entre los usuarios. Lo atestiguan los resultados en los mercados de aplicaciones donde Claude domina ahora la App Store y el Play Store, elementos concretos que ilustran el impacto de una estrategia ética en el comportamiento de los consumidores.

El enfoque de Anthropic articula varias dimensiones:

- Insistencia en la seguridad de los despliegues.

- Demanda de transparencia y control sobre el uso previsto por actores militares.

- Aceptación de una colaboración condicional, a diferencia de una ruptura definitiva.

- Posicionamiento moral como ventaja competitiva en un sector a vigilar.

El costo del rechazo: retos estratégicos y financieros

Rechazar una asociación tan lucrativa con el Departamento de Guerra también significa una pérdida importante de financiación considerada útil, en un sector donde la inversión sigue siendo una prioridad para mantenerse competitivo. Sin embargo, esta elección ilustra una postura donde los compromisos morales se priorizan sobre las ganancias a corto plazo.

En 2026, esta divergencia marca un punto de inflexión en la dinámica del sector. Provoca una redefinición de los criterios de evaluación de las empresas de IA, no solo en sus prestaciones técnicas, sino también en su ética operativa.

Las salvaguardas en OpenAI: consentimiento y límites a la militarización, el argumento oficial

OpenAI asume plenamente su acuerdo con el Ministerio de Defensa estadounidense. La empresa afirma haber negociado un marco que incluye más salvaguardas que las propuestas a Anthropic. Precisa que este acuerdo excluye las aplicaciones relacionadas con la vigilancia masiva y las armas totalmente autónomas.

El texto oficial insiste en que los usos militares deben limitarse a operaciones consideradas «legítimas», sin ambigüedad respecto al respeto de los derechos humanos. OpenAI también promete supervisar estrechamente el cumplimiento de estos límites.

Sin embargo, la reacción en la esfera pública sigue siendo mixta. La expresión “para fines legítimos” en un contrato está intrínsecamente sujeta a la evolución del marco legal y político, lo que genera una desconfianza importante por parte de los usuarios. Estos temen que una cláusula jurídica pueda evolucionar y permitir usos controvertidos en el futuro.

Aún más, el giro operado por OpenAI, que hasta entonces defendía junto a Anthropic un enfoque estricto en materia de seguridad, choca a parte de su comunidad. Este cambio alimenta un sentimiento de incoherencia ética que se amplifica en un sector ya percibido como opaco y complejo.

A continuación, los puntos claves de la posición de OpenAI respecto a su consentimiento a la militarización:

- Garantía de un marco estricto que excluye la vigilancia masiva.

- Compromiso de no desarrollar armas totalmente autónomas.

- Control y auditorías regulares de los usos dentro del Departamento de Guerra.

- Llamado a una colaboración pragmática para unir innovación y seguridad.

- Riesgo de interpretación variable de lo que es «legítimo» a largo plazo.

Por qué la confianza de los usuarios vacila

Las críticas dirigidas a OpenAI no se limitan a este solo asunto, sino que se inscriben en un contexto más amplio de desconfianza: operaciones en el exterior basadas en datos de entrenamiento, importante consumo energético, implicaciones sociales y profesionales complejas. La apuesta militar añade un peso adicional, debilitando la confianza en la transparencia de la empresa.

Ética y tecnología: cuando el gran público se apropia de las cuestiones de militarización de la IA

Este caso marcó un cambio sin precedentes en la manera en que el gran público percibe los desafíos de la inteligencia artificial. En el pasado, las controversias solían referirse a dimensiones técnicas abstractas: sesgos algorítmicos, confidencialidad de datos o impacto medioambiental. Hoy, la cuestión de la militarización involucra a la sociedad civil de modo directo, con un fuerte impacto emocional y político.

Este cambio resulta de una mayor conciencia sobre las consecuencias potenciales de un uso no regulado, especialmente en un sector sensible como el de la defensa. Los usuarios ya no quieren solo rendimiento o innovación, buscan un alineamiento con sus valores. Miden que las IAs no son meras herramientas neutras, sino que contienen elecciones éticas fundamentales.

Esta evolución obliga a los desarrolladores de inteligencia artificial a reevaluar profundamente su estrategia comercial. La ética se convierte en un elemento central para retener una base de usuarios que ya no duda en sancionar decisiones contrarias a sus principios.

Por otro lado, cabe destacar un desafío político creciente en torno a la regulación de la IA militar. La opinión pública contribuye ahora a influir en los debates legislativos e internacionales, impulsando la transparencia y reglas más estrictas para evitar una carrera desenfrenada hacia tecnologías con uso militar.

Las preguntas clave planteadas por la militarización de la IA :

- El papel moral de las empresas en el diseño de tecnologías de IA.

- Los riesgos vinculados a la pérdida de control sobre armas autónomas.

- La vigilancia extensa y potencialmente intrusiva permitida por la IA.

- El consentimiento informado y la información a los usuarios finales.

- La necesidad de una regulación internacional armonizada.

Reacciones y posicionamientos en el sector de la inteligencia artificial

Más allá de OpenAI y Anthropic, todo el sector tecnológico está bajo el fuego de las críticas en torno a la cuestión de la militarización de las inteligencias artificiales. Varios actores de renombre han tenido que aclarar su posición y exponer públicamente sus modalidades de compromiso.

Algunos actores pequeños como Anthropic atraen por su prudencia y rechazo a los contratos militares, privilegiando un desarrollo ético y responsable. En cambio, otras grandes empresas optan por colaborar con los gobiernos, argumentando la necesidad de inventar marcos seguros para tecnologías que intervienen en áreas de alto valor estratégico.

Esta polarización también se refleja en la inversión financiera. Un cuadro comparativo de las diferentes asociaciones militares del sector ilustra las opciones estratégicas de las empresas de IA:

| Empresa | Asociación Militar | Posición Ética | Monto (M$) |

|---|---|---|---|

| OpenAI | Sí, con el Departamento de Guerra de EE.UU. | Consentimiento con salvaguardas | 200 |

| Anthropic | No, rechazo prudente | Rechazo sin acuerdo | 0 |

| Google DeepMind | Colaboración limitada, vigilancia | Posición intermedia, control reforzado | 150 |

| Microsoft | Integración de IA en fuerzas armadas EE.UU. | Consentimiento estricto | 180 |

Los inversores tecnológicos, como Aidan Gold, también se expresan públicamente sobre el dilema moral que vivió OpenAI antes de la firma del acuerdo. Señalan especialmente la ironía de un apoyo público temporal a la posición de Anthropic sobre seguridad antes del brusco cambio de rumbo.

El futuro: una era donde la ética condiciona duraderamente las asociaciones estratégicas en IA

El caso OpenAI-Anthropic resalta el auge de una nueva era donde la militarización de la IA se convierte en una prueba moral auténtica. Las empresas ya no pueden limitarse a la promesa tecnológica: ahora son juzgadas también en su capacidad para alinear sus decisiones estratégicas con una ética reconocida por sus usuarios.

Los ejemplos recientes muestran que esta exigencia no es un freno, sino una oportunidad. Para Anthropic, rechazar un contrato gubernamental importante refleja una fortaleza de carácter y una voluntad clara de posicionarse en la escena internacional como un actor responsable.

Para OpenAI, el desafío es más complejo. El futuro dirá si el consentimiento a esta asociación militar, con sus cláusulas restrictivas, logrará convencer a la comunidad y preservar la confianza. En todo caso, la batalla por la ética está ahora en el corazón mismo de las estrategias empresariales.

Este giro también abre la vía a un diálogo enriquecido entre autoridades públicas, actores privados y sociedad civil. La presión para implementar regulaciones internacionales sobre la IA y sus usos militares se intensifica en paralelo a las reacciones populares. El mercado ya no podrá ignorar esta dimensión ética sin arriesgar fracturar duraderamente su base de usuarios.

La inteligencia artificial, lejos de ser una herramienta simple, debe ahora considerarse como un conjunto en el que cada evolución técnica implica responsabilidades sociales mayores, que deben ser objeto de un consentimiento informado y colectivo.

Vías para una integración ética y responsable de la IA en sectores estratégicos

Para garantizar un equilibrio entre innovación tecnológica y exigencias morales, se pueden considerar varias vías:

- Establecer normas internacionales estrictas que regulen el uso de IA en el ámbito militar, especialmente en materia de armas autónomas y vigilancia.

- Reforzar la transparencia en los contratos y fines de uso entre empresas y administraciones.

- Incluir a los usuarios finales en los debates éticos, mediante consultas e información activa.

- Desarrollar sistemas de auditoría terceros que permitan verificar el respeto a los compromisos asumidos.

- Favorecer asociaciones entre investigadores, reguladores e industrias para alinear desarrollo y control.

- Adoptar una comunicación clara para evitar ambigüedades y preservar la confianza.

A continuación, un cuadro sintético de los riesgos, retos y soluciones vinculados a la militarización de las IA:

| Riesgos | Retos | Posibles soluciones |

|---|---|---|

| Armas autónomas fuera de control | Seguridad global, estabilidad internacional | Implementación de tratados, prohibiciones claras |

| Vigilancia masiva intrusiva | Respeto a derechos civiles, privacidad | Legislación rigurosa, control democrático |

| Pérdida de confianza de los usuarios | Aceptabilidad social y comercial | Transparencia, diálogo, educación |

| Uso para fines ilegales | Ética y legalidad | Auditorías independientes, sanciones |

Preguntas frecuentes sobre la controversia OpenAI, Anthropic y la militarización de la IA

{«@context»:»https://schema.org»,»@type»:»FAQPage»,»mainEntity»:[{«@type»:»Question»,»name»:»¿Por qué Anthropic rechazó la militarización de su IA?»,»acceptedAnswer»:{«@type»:»Answer»,»text»:»Anthropic se opuso a la militarización de su IA por parte del Pentágono debido a garantías insuficientes para prevenir la vigilancia masiva y el control de armas autónomas. La empresa privilegia un compromiso sólo bajo salvaguardas estrictas para asegurar la seguridad y protección.»}},{«@type»:»Question»,»name»:»¿Qué garantías afirma haber obtenido OpenAI en la asociación militar?»,»acceptedAnswer»:{«@type»:»Answer»,»text»:»OpenAI afirma que su acuerdo excluye los usos relacionados con vigilancia masiva y armas totalmente autónomas, y prevé un control estricto así como un marco legal que limita los usos militares a fines legítimos.»}},{«@type»:»Question»,»name»:»¿Cuál es el impacto de la asociación OpenAI – Departamento de Guerra en el gran público?»,»acceptedAnswer»:{«@type»:»Answer»,»text»:»La asociación provocó un movimiento de contestación denominado ‘Cancel ChatGPT’, donde usuarios abandonaron la plataforma por alternativas consideradas más éticas, poniendo en el centro del debate la cuestión moral relacionada con la IA y su uso militar.»}},{«@type»:»Question»,»name»:»¿Claude de Anthropic se benefició del rechazo a la militarización?»,»acceptedAnswer»:{«@type»:»Answer»,»text»:»Sí, Claude alcanzó un fuerte progreso en los rankings de aplicaciones, especialmente en la App Store, gracias a su imagen de IA más ética, lo cual muestra la importancia del factor ético en las elecciones de los usuarios.»}},{«@type»:»Question»,»name»:»¿Cuáles son los retos futuros para la militarización de la inteligencia artificial?»,»acceptedAnswer»:{«@type»:»Answer»,»text»:»Los retos futuros incluyen establecer normativas internacionales, transparencia en las asociaciones, participación de usuarios en debates éticos y desarrollo de sistemas de auditoría para prevenir abusos y mantener la confianza.»}}]}¿Por qué Anthropic rechazó la militarización de su IA?

Anthropic se opuso a la militarización de su IA por parte del Pentágono debido a garantías insuficientes para prevenir la vigilancia masiva y el control de armas autónomas. La empresa privilegia un compromiso sólo bajo salvaguardas estrictas para asegurar la seguridad y protección.

¿Qué garantías afirma haber obtenido OpenAI en la asociación militar?

OpenAI afirma que su acuerdo excluye los usos relacionados con vigilancia masiva y armas totalmente autónomas, y prevé un control estricto así como un marco legal que limita los usos militares a fines legítimos.

¿Cuál es el impacto de la asociación OpenAI – Departamento de Guerra en el gran público?

La asociación provocó un movimiento de contestación denominado ‘Cancel ChatGPT’, donde usuarios abandonaron la plataforma por alternativas consideradas más éticas, poniendo en el centro del debate la cuestión moral relacionada con la IA y su uso militar.

¿Claude de Anthropic se benefició del rechazo a la militarización?

Sí, Claude alcanzó un fuerte progreso en los rankings de aplicaciones, especialmente en la App Store, gracias a su imagen de IA más ética, lo cual muestra la importancia del factor ético en las elecciones de los usuarios.

¿Cuáles son los retos futuros para la militarización de la inteligencia artificial?

Los retos futuros incluyen establecer normativas internacionales, transparencia en las asociaciones, participación de usuarios en debates éticos y desarrollo de sistemas de auditoría para prevenir abusos y mantener la confianza.